Оценка стресса полегания кукурузы на основе мультиспектральных данных с БПЛА с использованием методов машинного и глубокого обучения

Полегание кукурузы является распространенной проблемой, способной существенно снизить урожайность и качество зерна. Дистанционное зондирование с помощью беспилотных летательных аппаратов (БПЛА) представляет собой практический способ оперативного получения информации о полегании на полевом уровне, включая площадь, степень развития и распределение повреждений.

Аннотация

Однако существующие исследования в основном используют методы машинного обучения (МО) для качественного анализа полегания кукурузы (разделения на полегшие и неполегшие растения) или оценки процента полегших растений, в то время как работ, применяющих глубокое обучение (ГО) для количественной оценки параметров полегания (тип, степень и направление), значительно меньше.

Данное исследование направлено на внедрение современных алгоритмов ГО в задачу классификации полегания кукурузы с использованием мультиспектральных изображений с БПЛА и изучение преимуществ ГО по сравнению с традиционными методами МО. В рамках исследования был собран мультиспектральный набор данных с БПЛА, содержащий изображения неполегшей кукурузы и растений с различными типами, степенями и направлениями полегания.

Из мультиспектральных данных были рассчитаны 22 вегетационных индекса (ВИ), после чего выполнены пространственная агрегация и обрезка изображений. Для классификации параметров полегания кукурузы были обучены пять классификаторов МО и три модели ГО, с последующим сравнением их производительности.

Результаты показали, что модель Random Forest (RF) превзошла остальные четыре алгоритма МО, достигнув общей точности (OA) 89,29% и коэффициента Каппа 0,8852. Однако эффективность моделей ГО в классификации полегания кукурузы оказалась значительно выше. В частности, модель Swin-T показала лучшие результаты по сравнению с ResNet-50 и ConvNeXt-T, достигнув OA 96,02% и коэффициента Каппа 0,9574.

Это преимущество можно объяснить способностью Swin-T более эффективно извлекать из мультиспектральных данных детальную информацию, точно характеризующую особенности полегших растений.

Проведенное исследование демонстрирует, что комбинация методов глубокого обучения с мультиспектральными данными БПЛА позволяет получить более полную информацию о типе, степени и направлении полегания кукурузы, что имеет crucialное значение для организации спасательных операций после стихийных бедствий и урегулирования страховых случаев в сельском хозяйстве.

1. Введение

Кукуруза широко культивируется по всему миру. Благодаря достижениям в генетике, посадке и методах управления, мировое производство кукурузы стабильно увеличивалось на протяжении последних десятилетий, что сделало ее культурой с самым высоким урожаем. В 2022 году общий объем производства в мире составил 1,16 миллиарда тонн, при этом доля США составила 30,0%, а Китая — 23,8% [1]. Несмотря на это, глобальное возделывание и производство кукурузы по-прежнему сталкиваются со многими проблемами. Биотические и/или абиотические стрессы, которые могут возникать на протяжении всего цикла роста кукурузы, являются основными факторами, вызывающими снижение урожайности и ухудшение качества. В частности, цикл роста кукурузы осеннего урожая, высаженной в северном Китае, длится с июня по октябрь, в течение которого часто случаются экстремальные погодные явления. Возникающая в результате катастрофа полегания представляет серьезную угрозу для производства кукурузы. Полегание кукурузы — это состояние, при котором стебли растений кукурузы изгибаются и падают по разным причинам, таким как сильный ветер, проливные дожди или плохое состояние почвы [2,3,4,5]. Своевременное, быстрое и всестороннее получение информации о полегании имеет ключевое значение для оценки ущерба и страховых случаев.

Традиционное наземное обследование требует больших трудозатрат, занимает много времени и подвержено субъективным ошибкам, что делает его непрактичным для обследования больших площадей. По мере быстрого развития технологий сельскохозяйственного дистанционного зондирования, оптические и радиолокационные данные или изображения, полученные со спутниковых и БПЛА-платформ, предоставили значительную помощь заинтересованным сторонам в получении последовательной информации о состоянии полегших посевов [6]. Sentinel-1/2, GaoFen-1/3 и RADARSAT-2 являются основными источниками спутниковых данных для извлечения информации о полегании сельскохозяйственных культур в больших масштабах [7,8,9,10,11,12]. Однако спутниковое дистанционное зондирование имеет некоторые ограничения в отношении пространственно-временного разрешения и доступности качественных изображений из-за inherent периодов повторного пролета и зависимости от метеорологических условий. Этот факт приводит к тому, что спутниковое дистанционное зондирование не обладает возможностью тонкой характеристики пространственно-временной неоднородности информации о полегании. За последнее десятилетие дистанционное зондирование с использованием БПЛА показало большой потенциал для захвата высокодетальных динамических изменений биофизических свойств полегшей кукурузы на уровне поля [13,14]. По сравнению со спутниковым дистанционным зондированием, БПЛА-зондирование предлагает большую гибкость в захвате высокодетальных данных для конкретных моментов времени и территорий [15]. RGB [16,17], мультиспектральные [18,19], гиперспектральные [20], тепловые [21] и LiDAR [22] — это пять распространенных датчиков, совместимых с БПЛА. В дополнение, Wang et al. [23] также исследовали применение SAR для мониторинга кукурузы. Среди них относительно недорогие RGB и мультиспектральные датчики широко используются для мониторинга полегания сельскохозяйственных культур. В частности, различные вегетационные индексы (VI) могут быть извлечены из мультиспектральных изображений, полученных с БПЛА, и эти VI затем могут быть использованы для оценки параметров полегания кукурузы на основе различных спектральных отражательных свойств, связанных с разными состояниями полегания.

Традиционные методы анализа данных дистанционного зондирования в основном опираются на опыт и специфические физические модели, которые могут быть менее эффективны и сложны при обработке больших объемов сложных данных [24]. С глубокой интеграцией искусственного интеллекта и точного земледелия, машинное обучение (ML) и глубокое обучение (DL) играют все более важную роль в интерпретации данных дистанционного зондирования [25,26,27]. В настоящее время многие ученые используют различные методы ML для анализа БПЛА-снимков дистанционного зондирования с целью оценки ущерба от полегания кукурузы. Например, Wang et al. [16] применили объектно-ориентированный подход классификации с использованием классификатора случайного леса в сочетании с изменениями на исходных изображениях, цифровых моделях поверхности и текстурных признаках для обнаружения степени тяжести полегания кукурузы. Shu et al. [17] установили пять моделей оценки на основе ML для оценки степени тяжести полегания кукурузы путем анализа разновременных цифровых изображений, полученных с БПЛА. Глубокое обучение, недавно популярная технология глубоких искусственных нейронных сетей, может выводить признаки на различных масштабах и уровнях из изображений дистанционного зондирования через многослойное обучение, эффективно захватывая потенциальные связи между признаками и целевыми переменными [28]. Таким образом, оно способствует высокой производительности в задачах обработки и классификации изображений. Например, Yang et al. [29] проанализировали характерные изменения трех уровней (отсутствие, умеренное и сильное) степени тяжести полегания кукурузы на БПЛА RGB и мультиспектральных изображениях с использованием трех алгоритмов DL (ResNet-50, VGG-16 и Inception-V3). Их результаты показали, что комбинация алгоритма ResNet-50 с мультиспектральными изображениями дала наивысшую точность классификации 96,32% и коэффициент Каппа 0,9551, эффективно устанавливая корреляцию между наблюдениями БПЛА-зондирования и степенью тяжести полегания кукурузы.

Однако при оценке ущерба от полегания кукурузы с использованием БПЛА-снимков дистанционного зондирования все еще присутствуют некоторые проблемы. Во-первых, большинство исследований проводят только качественный анализ типов полегания кукурузы (например, полегшие и неполегшие) или оценивают процент полегших растений [30,31], в то время как few исследований сосредоточены на количественном анализе параметров полегания кукурузы. Во-вторых, текущие исследования в основном используют данные БПЛА-зондирования и методы ML для оценки ущерба от полегания кукурузы [16,17,31]. В-третьих, применение DL для обнаружения полегания кукурузы все еще ограничено по сравнению с традиционными подходами ML, и лишь несколько исследований исследуют его потенциал [29], особенно с учетом достижений в DL, таких как модели на основе трансформеров. Наконец, насколько нам известно, few исследований тщательно сравнивали производительность классификации ML и DL в оценке ущерба от полегания кукурузы. Данная работа направлена на внедрение передовых алгоритмов DL в задачу классификации полегания кукурузы на основе БПЛА-мультиспектральных изображений и изучение преимуществ DL по сравнению с традиционными методами ML.

2. Материалы и методы

Рисунок 1 иллюстрирует рабочий процесс данной работы, включая сбор мультиспектральных изображений с БПЛА, обработку данных и сравнительный анализ между методами ML и DL. Основные моменты и вклад этого исследования суммированы следующим образом:

Рисунок 1. Рабочий процесс данного исследования.

(i) Мы создали набор мультиспектральных данных с БПЛА для кукурузы при различных параметрах полегания, включая разные типы, степени тяжести и направления полегания.

(ii) Мы применили пространственную агрегацию и обрезку изображений с семью различными размерами скользящего окна ко всем VI, создав несколько наборов данных для изучения оптимальных методов предварительной обработки данных.

(iii) На основе вышеуказанных наборов данных мы обучили пять моделей ML и три модели DL и провели всесторонний сравнительный анализ их классификационной производительности.

(iv) Мы восполнили недостаток количественного анализа для различных параметров полегания кукурузы, предоставив более точный метод для оценки ущерба от полегания.

2.1. Район исследований и сбор данных

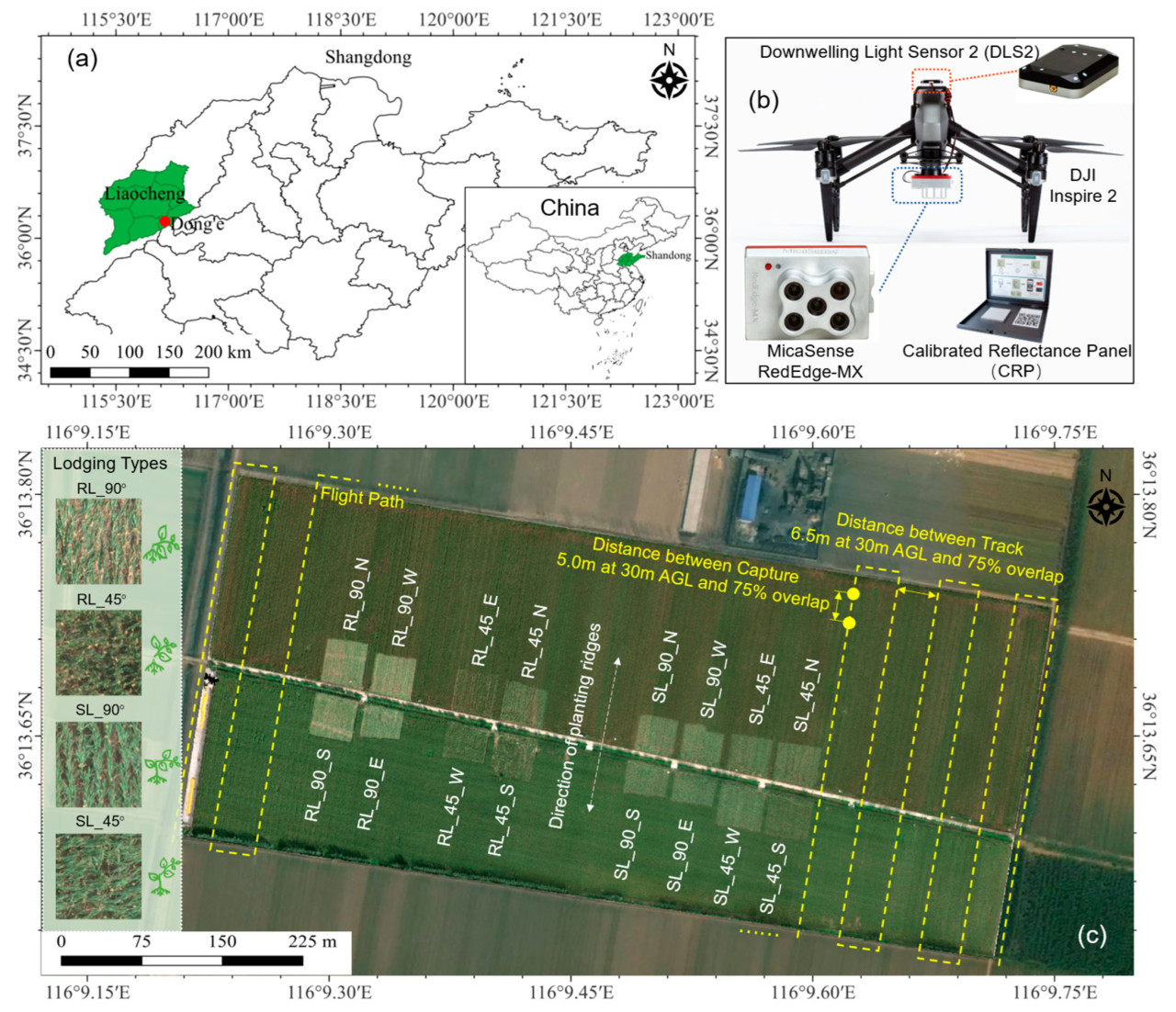

Это экспериментальное поле расположено в уезде Дунъэ, город Ляочэн, провинция Шаньдун, Китай, с географическими координатами 36°39′23″ с.ш. и 116°12′20″ в.д. (Рисунок 2a). Экспериментальный участок представляет собой прямоугольную область длиной 750 м и шириной 350 м, общей площадью приблизительно 26 гектаров. Дорога, проходящая через экспериментальное поле, служит границей между северной и южной экспериментальными зонами. С 10 по 11 июня 2023 года сорта кукурузы «MY73» и «Lenong87» были высеяны в северной и южной зонах соответственно, с плотностью посева около 67 500/га. Время сбора урожая для обеих зон — 3–4 октября 2023 года. С 26 по 28 сентября 2023 года мы наняли специалистов для искусственного полегания растений кукурузы в соответствии с нашей экспериментальной схемой, как показано на Рисунке 2c. Мы установили четыре типа полегания на основе точки наклона и угла наклона: полегание стебля 45°, полегание стебля 90°, полегание корня 45° и полегание корня 90°. Кроме того, каждый тип полегания был дополнительно классифицирован на основе стороны света, в которой он произошел: север, юг, восток или запад. В результате получилось 16 категорий полегания вместе с одной категорией, представляющей прямостоячую кукурузу, указывающей на отсутствие полегания. Для удобства выражения, принимая полегание корня 45° в качестве примера, мы определяем его как RL_45, а его четыре направления как RL_45_N, RL_45_S, RL_45_E, RL_45_W. Категория без полегания определяется как NonL.

Рисунок 2. Обзор района исследований. (a) Местоположение района исследований; (b) Используемые БПЛА и датчики; (c) Маршрут полета БПЛА и стадии полегания.

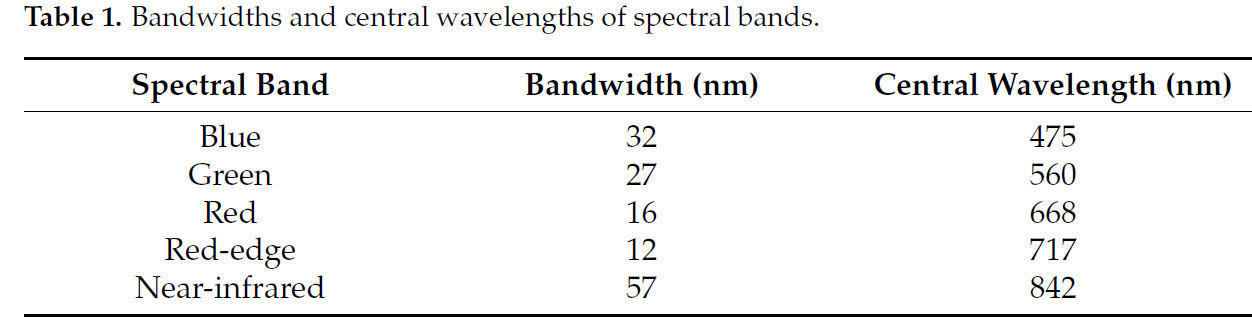

Как показано на Рисунке 2b, мы собирали мультиспектральные изображения с БПЛА с использованием DJI Inspire 2 (DJI Technology Co., Ltd., Шэньчжэнь, Китай), оснащенного камерой RedEdge-MX (MicaSence, Сиэтл, WA, США) 29 сентября 2023 года, в условиях солнечной погоды. Камера RedEdge-MX весит 231,9 г и имеет размеры 8,7 см × 5,9 см × 4,54 см, с разрешением 1280 × 960 пикселей. Камера имеет пять спектральных каналов: синий, зеленый, красный, красный краевой и ближний инфракрасный, как показано в Таблице 1. DJI Inspire 2 имеет собственный вес приблизительно 3,44 кг и грузоподъемность 0,23 кг. Чтобы обеспечить постоянные условия освещения для кукурузы и минимизировать тени, мы собирали данные между 10:00 утра и 2:00 дня. Высота полета поддерживалась на уровне 30 м над землей, а разрешение изображения камеры составляло 1280 × 960 пикселей. Чтобы обеспечить изображения с 75% продольным и боковым перекрытием, мы тщательно спланировали маршрут полета с использованием DJI GS Pro (DJI Technology Co., Ltd., Шэньчжэнь, Китай). RedEdge-MX работал в режиме таймера, захватывая одно изображение (все каналы) в секунду. Покрывая всю экспериментальную область, каждый спектральный канал захватил 12 140 мультиспектральных изображений, всего около 60 000 фотографий, сохраненных на бортовой SD-карте в формате TIFF. Датчик нисходящего света 2 (DLS2) был размещен на верхней части DJI Inspire 2 для определения направления и интенсивности солнечного света в реальном времени. До и после полета мы делали снимки калибровочной радиометрической панели (CRP), которые будут использоваться для калибровки мультиспектральных изображений на этапе пост-обработки.

Таблица 1. Ширина каналов и центральные длины волн спектральных каналов.

2.2. Предобработка набора данных

Во время пост-обработки данных мы использовали программное обеспечение PIX4Dfields (Версия: 2.51) для склейки множественных перекрывающихся мультиспектральных изображений, захваченных мультиспектральной камерой дрона. Размер сгенерированного ортомозаичного изображения составляет 36 770 × 20 850 пикселей, а соответствующее разрешение на местности (GSD) составляет приблизительно 2,208 см/пиксель. Мы сохранили мультиспектральную ортофотоплан как файл <.tif> и использовали программное обеспечение ENVI (Версия:5.6) для очерчивания областей интереса (ROI). Обрезанные ROI были сохранены в файлы <.dat>. Каждая ROI представляет определенный параметр полегания, который ограничен комбинацией типа, степени тяжести и направления полегания.

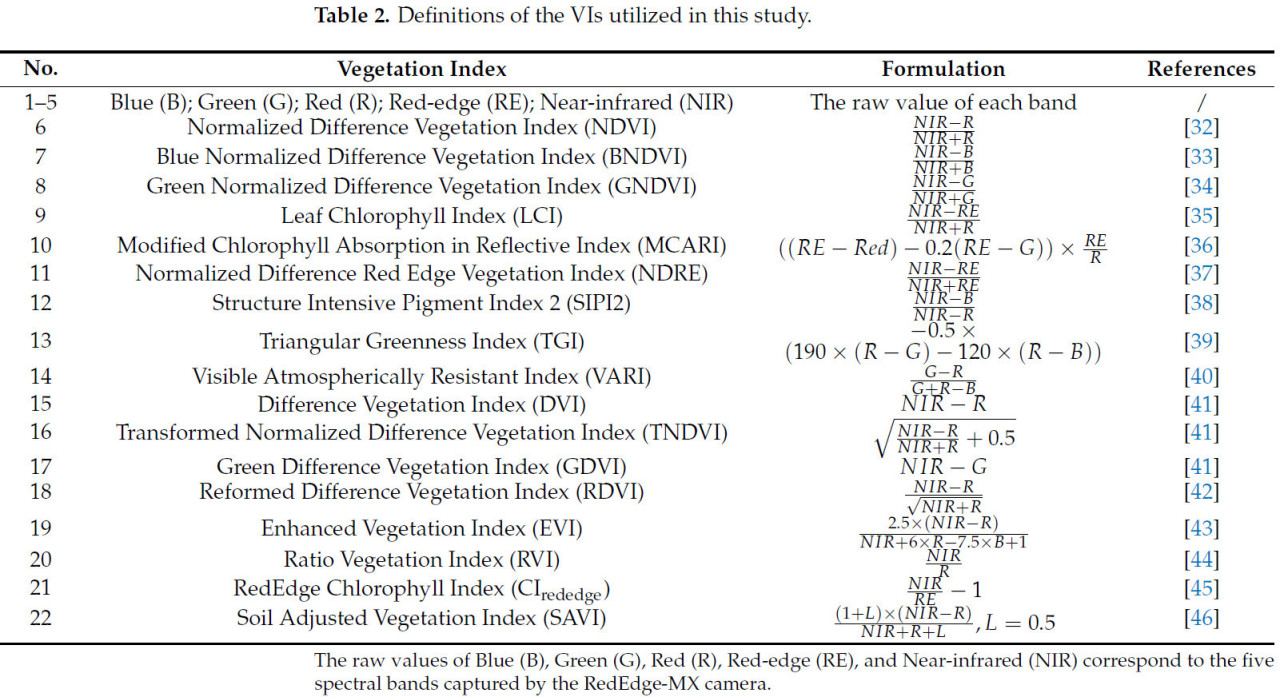

Вегетационные индексы являются линейными или нелинейными комбинациями отражения от разных спектральных каналов, служа важными индикаторами здоровья и состояния роста растительности. Они могут быть использованы для количественной оценки биофизических характеристик кукурузы. Как перечислено в Таблице 2, мы извлекли 17 вегетационных индексов из пяти исходных мультиспектральных каналов. Следовательно, 22 VI используются в качестве входных признаков для модели классификации параметров полегания кукурузы. Разница в спектральном отражении кукурузы при 17 параметрах полегания для 22 VI представлена на Рисунке 3. Как показано на Рисунке 3a, спектральное отражение кукурузы при разных параметрах полегания показывает стабильную тенденцию изменения в пяти исходных каналах, с более низким значением в синем и красном каналах и более высоким значением в канале NIR. Другой вывод заключается в том, что спектральное отражение увеличивалось с увеличением степени тяжести полегания (RL_90 > SL_90 > RL_45 > SL_45 > NonL). Основная причина заключается в том, что листья полога вносят наибольший вклад в спектральное отражение до полегания. В contrast, после полегания доля обнаженных стеблей резко возрастает из-за структурных и морфологических изменений полога. Дополнительно, по мере увеличения степени тяжести полегания, обнаженные стебли становились более prominent, с более высоким спектральным отражением, чем листья. В отличие от отдельного канала, VI интегрирует более детальную информацию из нескольких каналов (Рисунок 3b–d). Из-за разных методов расчета, спектральное отражение VI не показывает стабильной закономерности со степенями тяжести полегания. Однако они все же проявляют различное спектральное отражение при различных параметрах полегания, что означает, что эти VI могут предоставить ценную информацию для классификации и анализа полегания. На Рисунке 3e спектральное отражение CIrededge и RVI при различных параметрах полегания значительно различалось, указывая на то, что эти два VI могут быть ключевыми признаками для различения параметров полегания кукурузы.

Рисунок 3. Разница в спектральном отражении кукурузы при 17 параметрах полегания для 22 VI. (a) Спектральное отражение для каналов от Blue до NIR; (b) Спектральное отражение для BNDVI до GDVI; (c) Спектральное отражение для GNDVI до RDVI; (d) Спектральное отражение для SAVI до VARI; (e) Общая тенденция спектрального отражения для 22 VI.

Таблица 2. Определения VI, использованных в данном исследовании.

2.3. Методы

Это исследование изучает возможности традиционных алгоритмов ML и передовых моделей DL в классификации полегания кукурузы и сравнивает различия в их производительности. Пять широко используемых алгоритмов ML, включая метод опорных векторов (SVM), случайный лес (RF), метод k-ближайших соседей (KNN), линейный дискриминантный анализ (LDA) и искусственную нейронную сеть (ANN), были обучены с оптимальным поднабором признаков, отобранным алгоритмом Boruta. Что касается моделей DL, три глубоких нейронных сети, а именно ResNet-50, Swin-T и ConvNeXt-T, были воспроизведены с нашими наборами данных.

2.3.1. Пять моделей машинного обучения

SVM максимизирует зазор между классами, находя оптимальную разделяющую границу, повышая точность классификации в высокоразмерных данных. RF повышает точность и устойчивость модели путем построения множества деревьев решений и агрегирования их результатов. KNN присваивает метки на основе ближайших соседей, обеспечивая простоту и надежную производительность в сценариях с нелинейными границами решений. LDA максимизирует разделение классов, используя линейные комбинации признаков. ANN имитирует биологические нейронные сети, используя связанные узлы для выполнения сложных нелинейных отображений, что особенно эффективно при обработке сложных шаблонов данных и больших наборов данных. Выбор признаков является важной предпосылкой для алгоритмов классификации ML. Алгоритм Boruta — это метод-обертка, производный от RF, который может эффективно идентифицировать все значимые переменные для классификации [47]. Алгоритм сначала вносит степень случайности для генерации теневых признаков и объединяет их с реальными признаками для построения новой матрицы признаков. Затем он использует новую матрицу признаков для обучения модели важности признаков, вычисляет оценку важности для каждого признака и определяет максимальный Z-показатель теневых признаков (Z-max). Наконец, признаки, набравшие баллы выше Z-max, отмечаются алгоритмом как важные, а те, у которых баллы значительно ниже, отмечаются как неважные. Этот процесс повторяется до тех пор, пока каждый признак не будет окончательно отнесен к категории «важный» или «неважный».

2.3.2. Три модели глубокого обучения

(a) Resnet-50

ResNet-50 является экземпляром ResNet, базовая архитектура которого — это остаточный блок [48]. Остаточный блок ResNet-50 состоит из трех сверточных слоев, каждый из которых следует за пакетной нормализацией (BN) и активацией ReLU. Вход в остаточный блок добавляется к выходу через shortcut connection. Эта структура эффективно alleviates проблемы, такие как исчезающий градиент, взрыв градиента и деградация сети во время обучения глубокой сети. Результат алгоритма может быть определен как Уравнение (1).

где x и y представляют вход и выход остаточного блока; W1, W2 и W3 — весовые матрицы первых трех сверточных слоев; σ обозначает функцию активации ReLU; «+» представляет shortcut connection. Модель ResNet-50 состоит из семи стадий. Первые пять стадий включают различные комбинации сверточных слоев, слоев BN, функций активации ReLU и слоев макс-пулинга. Эти стадии предназначены для извлечения и обработки сложных признаков из входных данных. Шестая стадия использует глобальный усредненный пулинг для сжатия пространственных размеров карт признаков и агрегирования информации по всей пространственной области. Финальная стадия использует полносвязный слой для обработки этих агрегированных признаков и генерации выходных данных классификации. Инновационный механизм остаточных связей ResNet-50 значительно улучшает обучение и оптимизацию глубоких нейронных сетей, демонстрируя высокую производительность и устойчивость в компьютерном зрении.

(b) Swin-T

Swin Transformer Tiny (Swin-T) — это уменьшенная версия Swin Transformer [49]. Он делит входное изображение на фиксированные по размеру и неперекрывающиеся окна и выполняет вычисления самовнимания внутри каждого окна. Этот дизайн снижает вычислительную сложность, позволяя модели захватывать детальные признаки в локальных областях. Чтобы дополнительно захватывать глобальные признаки across окон, Swin-T вводит механизм сдвига окон. Дополнительно, Swin-T принимает много scale структуру, подобную сверточным нейронным сетям, захватывая малые локальные признаки на неглубоких слоях и большие глобальные признаки на более глубоких слоях, постепенно расширяя рецептивное поле. Этот дизайн делает Swin-T идеальным выбором для различных приложений компьютерного зрения.

(c) ConvNeXt-T

ConvNeXt-T — это самая маленькая архитектура в серии ConvNeXt [50]. Этот дизайн интегрирует сильные стороны традиционных сверточных нейронных сетей с современными элементами дизайна, такими как более широкие сверточные ядра, локальная нормализация отклика (LRN) и иерархическое извлечение признаков. Более широкие сверточные ядра предлагают большее рецептивное поле, усиливая способность извлечения признаков, одновременно уменьшая глубину сети. LRN повышает способность модели извлекать локальные признаки, увеличивая чувствительность к тонким признакам. Иерархическое извлечение признаков позволяет лучше захватывать много scale информацию изображения, тем самым улучшая способность обобщения модели. Эти характеристики позволяют ConvNeXt-T сохранять преимущества сверточных нейронных сетей, одновременно включая последние достижения в исследованиях DL, что приводит к выдающейся производительности across различных визуальных задач.

2.3.3. Пост-обработка данных

Спектральная информация на уровне пикселя несколько избыточна для классификации параметров полегания кукурузы. Хотя кукуруза доминирует на наших сантиметровых мультиспектральных изображениях, также присутствуют голая почва и сорняки. Мы использовали пространственную агрегацию для усреднения значений пикселей в локальной области каждой ROI на каждом изображении VI, чтобы подавить спектральный шум. В частности, мы применили семь размеров скользящего окна (WS) (100 × 100, 125 × 125, 150 × 150, 175 × 175, 200 × 200, 225 × 225, 250 × 250) для пространственной агрегации и сгенерировали соответственно семь наборов данных. Затем пять моделей классификации ML были обучены с использованием этих семи наборов данных, и были сравнены эффекты разных методов обработки данных на производительность модели. Аналогично, размер входного изображения (IS) напрямую определяет детали изображения, таким образом влияя на производительность модели DL. Мы использовали упомянутые выше семь размеров скользящего окна для обрезки изображения каждой ROI на каждом изображении VI и сгенерировали семь наборов данных для обучения трех моделей DL.

2.3.4. Обучение модели

Перед обучением модели ML мы сначала стандартизировали данные. Одновременно мы выполнили обширную настройку параметров для SVM (линейное ядро), RF (400 деревьев решений), KNN (1 сосед), LDA (снижение размерности до 10 измерений) и ANN (150 скрытых слоев, максимальное количество итераций 1500) для оптимизации их производительности.

Для трех моделей DL (ResNet-50, Swin-T и ConvNeXt-T) мы единообразно использовали функцию потерь перекрестной энтропии и оптимизатор Adam, устанавливая размер пакета 64, скорость обучения 0,0001 и 100 эпох обучения, чтобы обеспечить сопоставимость результатов обучения. Чтобы улучшить производительность модели и скорость обучения, мы воспроизвели эти модели на основе PyTorch и провели transfer learning, используя официальные предварительно обученные веса. Мы применяли методы аугментации данных (горизонтальное отражение и случайная обрезка) для увеличения разнообразия данных. Дополнительно, входные данные были стандартизированы перед обучением. Процесс обучения для всех моделей глубокого обучения (ResNet-50, Swin-T и ConvNeXt-T) использовал стратегию ранней остановки. В частности, обучение останавливалось, если потери на валидации не улучшались в течение 50 последовательных эпох. Кроме того, слои dropout и L2-регуляризация применялись для повышения способности обобщения моделей.

Аппаратная конфигурация для этого исследования включает процессор 12-го поколения Intel® Core™ i9-12900K с 16 ядрами, GPU NVIDIA GeForce RTX 3090 Ti с 24 ГБ памяти и 128 ГБ DDR5 5200 системной памяти. Операционная система — Ubuntu 22.04 LTS, с использованием Python 3.10.10, PyTorch 2.1.2 и CUDA 12.1.

2.3.5. Показатели оценки

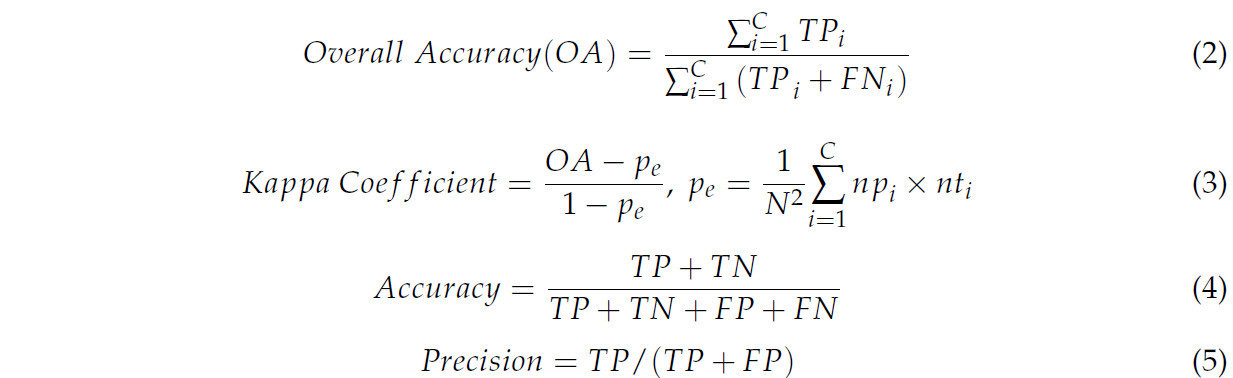

В данном исследовании общая точность (OA) (уравнение (2)) и коэффициент Каппа (уравнение (3)) используются для оценки и сравнения общей эффективности всех моделей на тестовом наборе. Кроме того, для дальнейшей оценки эффективности классификации всех моделей для каждого класса размещения мы использовали точность (уравнение (4)), точность (уравнение (5)), полноту (уравнение (6)) и оценку F1 (уравнение (7)).

где C — количество классов размещения; TP — истинно положительный; TN — истинно отрицательный; FP — ложноположительный; FN — ложноотрицательный; np i обозначает количество предсказанных образцов для класса i; nt i обозначает количество фактических образцов для класса i.

3. Результаты

3.1. Анализ коэффициента корреляции и значимости

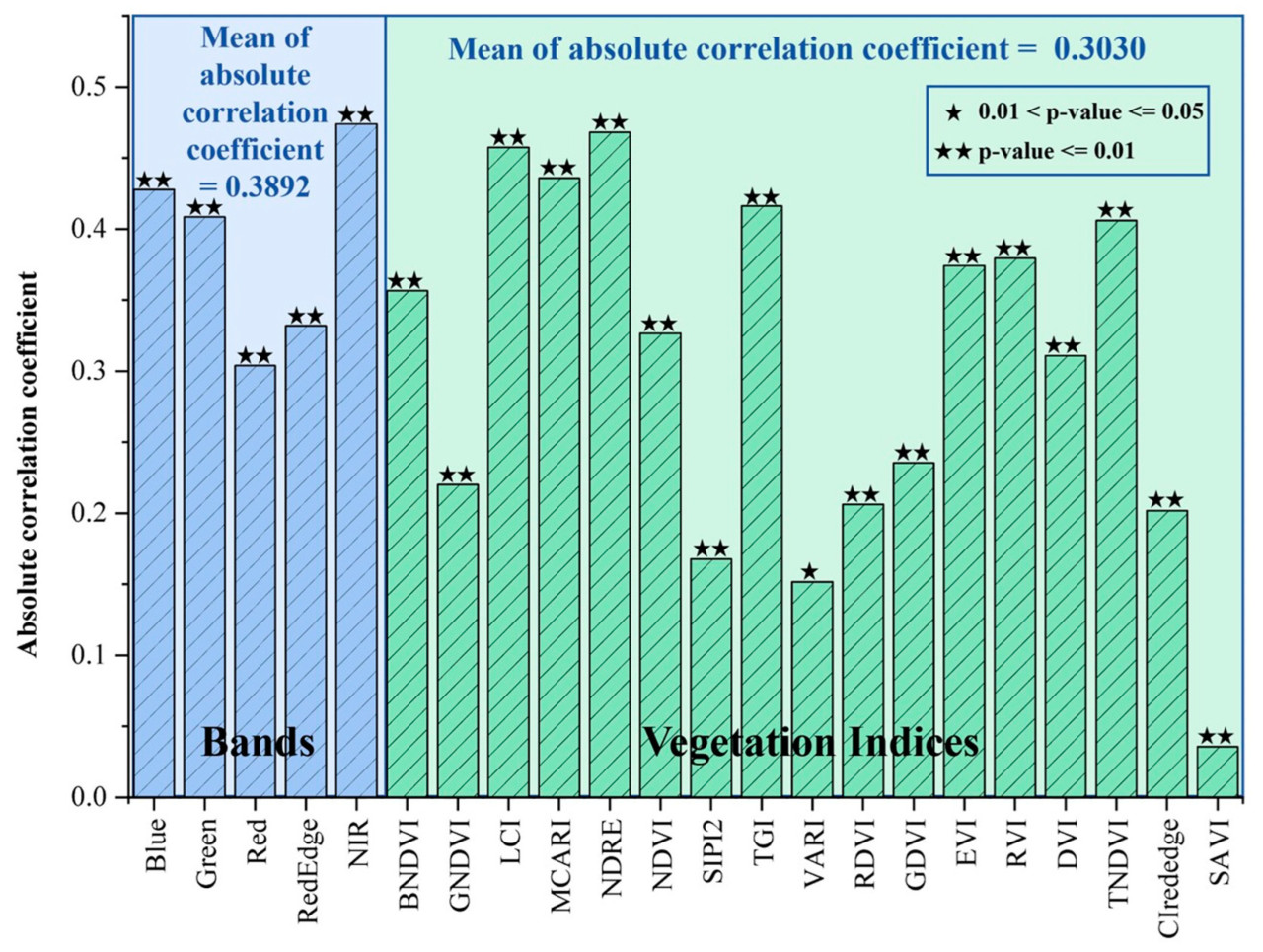

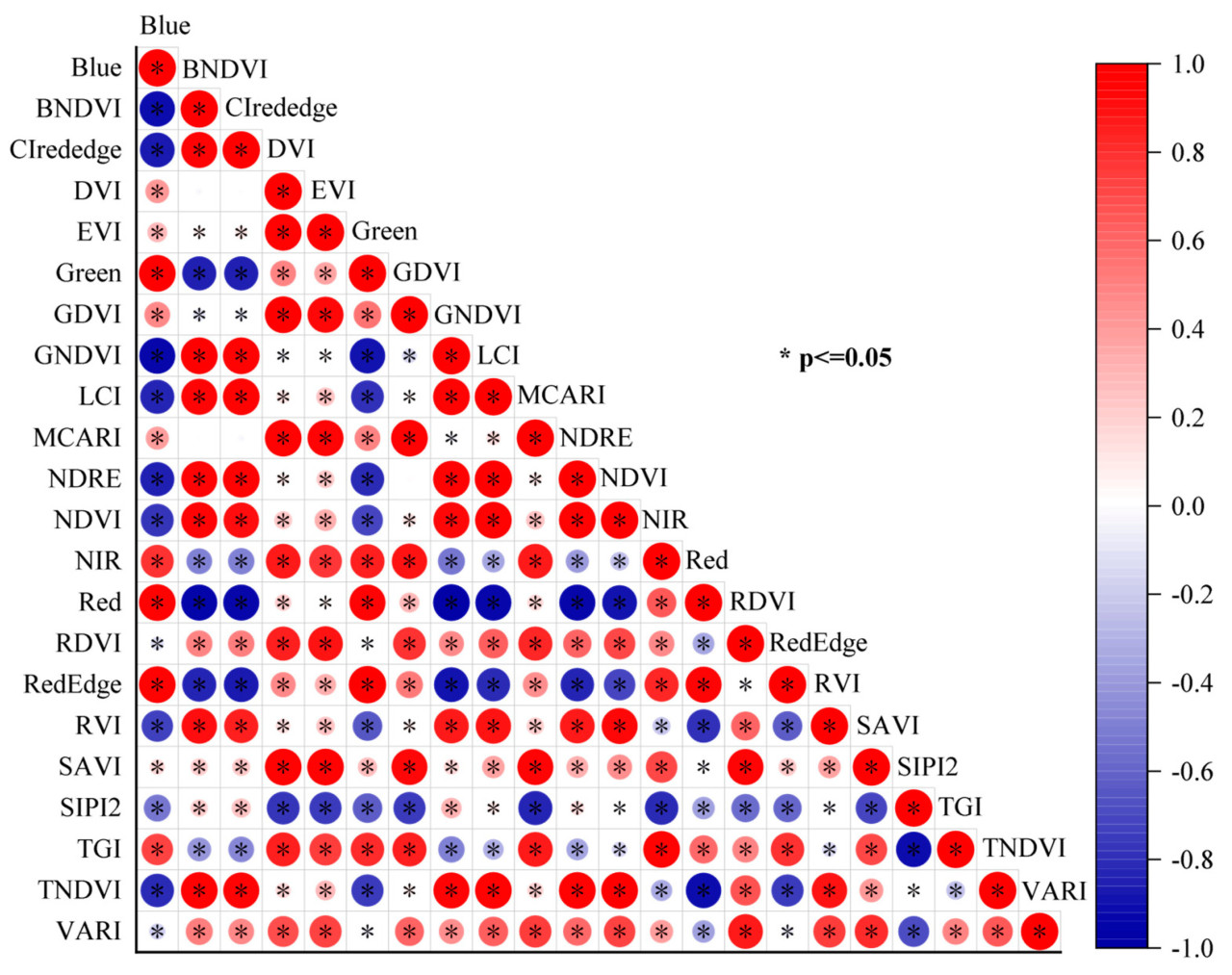

Мы проанализировали коэффициент корреляции и значимость 22 VI с параметрами полегания кукурузы. Как показано на Рисунке 4, что касается абсолютного коэффициента корреляции, NIR, LCI и NDRE являются тремя лучшими VI, в то время как SAVI, VARI и SIPI2 являются тремя худшими VI. Средний абсолютный коэффициент корреляции пяти исходных каналов (0,3892) на 0,0862 выше, чем у производных вегетационных индексов (0,3030). Между тем, вариация коэффициентов корреляции среди пяти исходных спектральных каналов меньше, чем среди 17 производных вегетационных индексов. Это указывает на то, что пять исходных каналов более эффективны и стабильны в описании характеристик полегания, чем производные вегетационные индексы. Дополнительно, 21 VI (кроме VARI) значительно коррелировал с параметрами полегания (тип, степень тяжести и направление) на уровне 0,01. Примечательно, что хотя некоторые VI (например, SAVI) имеют более низкий коэффициент корреляции с целевыми переменными, их уровень значимости все еще высок (p-value ≤ 0,01). Это указывает на то, что эти VI все же вносят вклад в построение модели, особенно в сочетании с другими VI. Наконец, мы также проанализировали корреляцию и значимость среди 22 VI. Рисунок 5 показывает значительные положительные или отрицательные корреляции среди нескольких VI, указывая, что эти VI могут иметь общую (например, BNDVI и Clrededge) или дополнительную (например, TGI и SIPI2) информацию в отражении параметров полегания кукурузы. Эти взаимосвязи помогают модели более точно оценивать полегание кукурузы с различных точек зрения.

Рисунок 4. Коэффициент корреляции между каждым VI и параметрами полегания кукурузы.

Рисунок 5. Анализ коэффициента корреляции и значимости среди 22 VI.

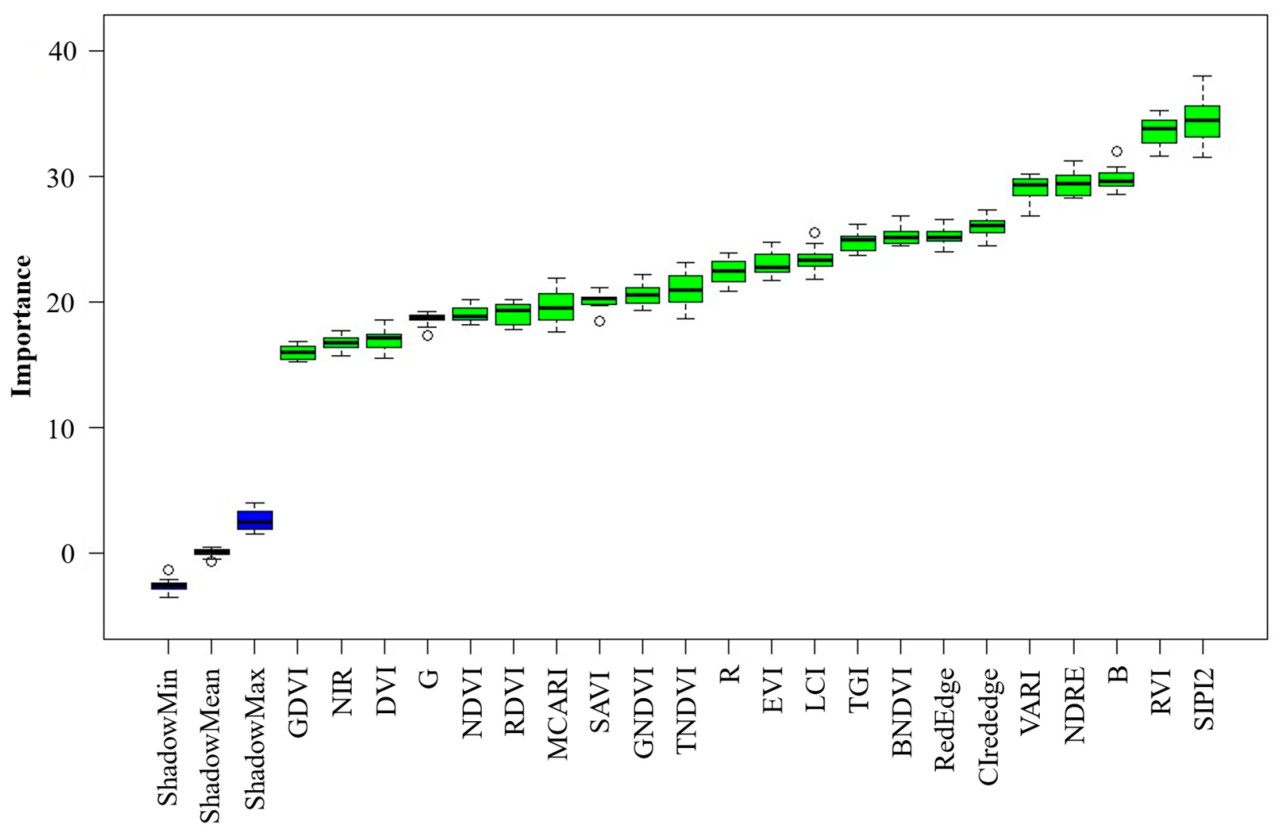

3.2. Классификационная производительность моделей машинного обучения

Методы выбора признаков значительно влияют на точность и стабильность моделей классификации [13]. Оптимальный поднабор признаков может улучшить способность модели к обобщению, минимизировать риск переобучения и повысить точность классификации. Алгоритм Boruta оценивает важность каждого признака, сравнивая его Z-показатель с Z-max. Как показано на Рисунке 6, алгоритм Boruta сохранил все 22 признака, которые в порядке важности: SIPI2, RVI, B, NDRE, VARI, CIrededge, RedEdge, BNDVI, TGI, LCI, EVI, R, TNDVI, GNDVI, SAVI, MCARI, RDVI, NDVI, G, DVI, NIR и GDVI. Это указывает на то, что Boruta считает все признаки полезными для задачи классификации, так как Z-показатель каждого признака превышает Z-max.

Рисунок 6. Выбор признаков с использованием алгоритма Boruta. Признаки, отмеченные синим, представляют «теневые признаки», а зеленые признаки сохранены после процесса.

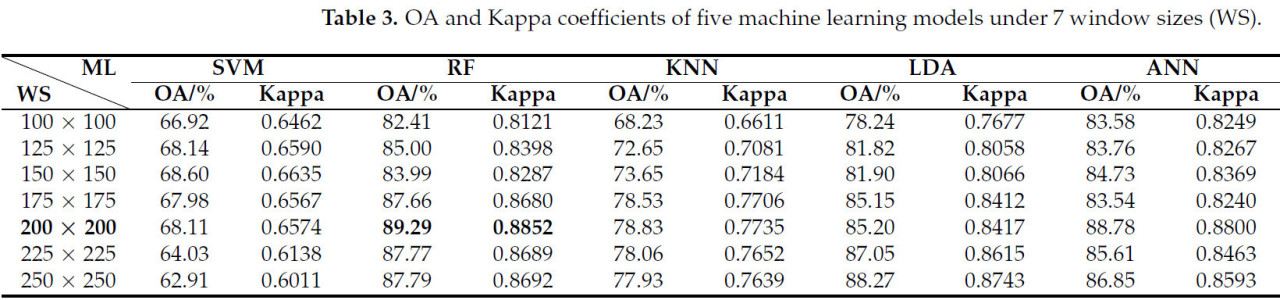

SVM, RF, KNN, LDA и ANN были обучены с использованием наборов данных, построенных через пространственную агрегацию в Разделе 2.3.3. Как показано в Таблице 3, для SVM, RF, KNN и ANN, OA и коэффициенты Каппа моделей сначала увеличиваются, а затем уменьшаются по мере увеличения размера окна пространственной агрегации. В частности, оптимальный размер окна пространственной агрегации для SVM и LDA составляет 150 × 150 (OA 68,60% и коэффициент Каппа 0,6635) и 250 × 250 (OA 88,27% и коэффициент Каппа 0,8743) соответственно. Что касается RF, KNN и ANN, размер окна пространственной агрегации с наивысшими OA и коэффициентом Каппа составляет 200 × 200. OA трех моделей составляет 89,29%, 78,83% и 88,78% соответственно; коэффициент Каппа составляет 0,8852, 0,7735 и 0,8800 соответственно. Это явление можно объяснить тем, что меньшие размеры окон приводят к увеличению вариации значений пикселей, вызывая нестабильность спектральных характеристик локальных областей, что может чрезмерно подчеркивать локализованные вариации значений пикселей, вызванные полеганием. И наоборот, когда размер окна чрезмерно большой, он усредняет спектральные особенности, специфичные для полегания. Это обобщение уменьшает отчетливые спектральные отклики, связанные с степенью тяжести, направлением и типом полегания, снижая способность модели точно различать категории полегания. Мы выбираем 200 × 200 в качестве оптимального размера окна пространственной агрегации на основе вышеуказанных результатов. Таблица 3 также показывает, что RF превосходит другие модели ML и достигает наивысшей OA 89,29% и коэффициента Каппа 0,8852. Это можно объяснить устойчивостью RF к переобучению и его эффективной обработкой многомерных данных [49].

Таблица 3. OA и коэффициенты Каппа пяти моделей машинного обучения при 7 размерах окон (WS).

3.3. Классификационная производительность моделей глубокого обучения

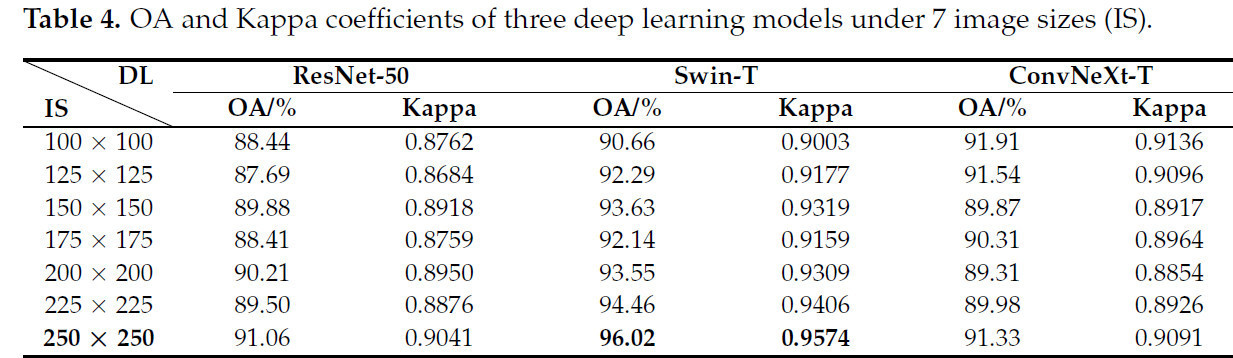

ResNet-50, Swin-T и ConvNeXt-T были обучены с использованием наборов данных, обрезанных с теми же размерами окон, что и для моделей ML. Результаты в Таблице 4 показывают, что Swin-T заметно превосходит как ResNet-50, так и ConvNeXt-T по классификационной производительности, и он более чувствителен к размеру входного изображения, чем ResNet-50 и ConvNeXt-T. В частности, по мере увеличения размера входного изображения, OA Swin-T увеличивается с 90,66% до 96,02%, в то время как диапазон колебаний OA для ResNet-50 и ConvNeXt-T составляет только 3,37 и 2,60 процентных пункта соответственно. ResNet-50 (OA 91,06% и коэффициент Каппа 0,9041) и Swin-T (OA 96,02% и коэффициент Каппа 0,9574) достигли оптимальных результатов при размере изображения 250 × 250, в то время как ConvNeXt-T (OA 91,33% и коэффициент Каппа 0,9091) показал наилучшую производительность при размере изображения 100 × 100. Это в основном связано со способностью моделей DL автоматически извлекать высокоуровневые признаки. Большие размеры изображений обычно предоставляют больше пространственной информации, позволяя модели лучше захватывать ключевые параметры полегания, включая общую структуру и распределение полегших растений кукурузы, тем самым усиливая классификационные возможности модели. Swin-T выделяется в этом отношении, достигая наивысшей классификационной производительности (OA 96,02% и коэффициент Каппа 0,9574) при самом большом размере изображения. Это можно объяснить преимуществом Swin-T в захвате длинно-дистанционных зависимостей и много scale признаков, что делает его более эффективным при обработке высокодетальных изображений.

Таблица 4. OA и коэффициенты Каппа трех моделей глубокого обучения при 7 размерах изображений (IS).

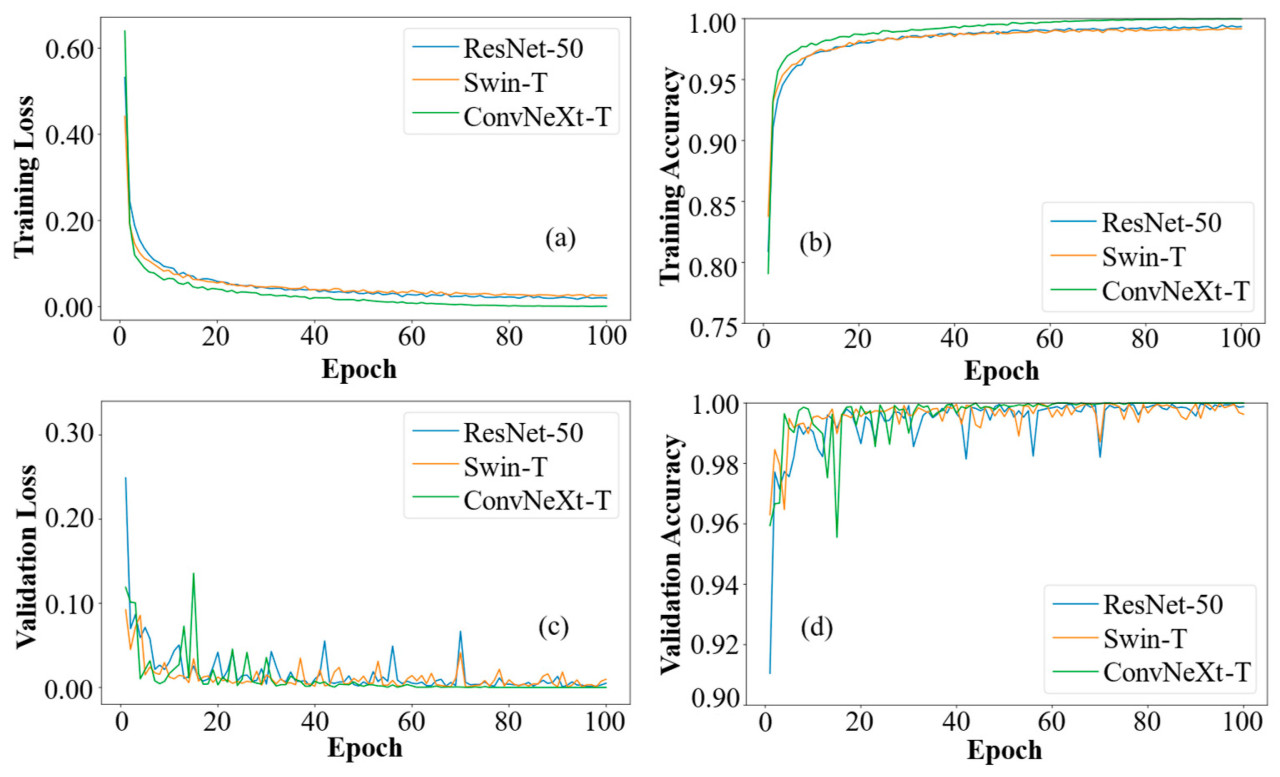

На Рисунке 7 изображены кривые потерь и точности для трех моделей DL в процессе обучения и валидации. Как показано на Рисунке 7a,b, все три модели DL могут быстро сходиться и достигать высокой точности обучения. Однако мы можем наблюдать на Рисунке 7a,c, что потери на обучении и валидации ConvNeXt-T значительно ниже, чем у ResNet-50 и Swin-T, приближаясь к нулю на 100 эпохах. Дополнительно, как видно на Рисунке 7b,d, точность на обучении и валидации ConvNeXt-T выше, чем у ResNet-50 и Swin-T, приближаясь к 100% на 100 эпохах. Это предполагает, что ConvNeXt-T может проявлять переобучение на тренировочном наборе, приводя к сниженной производительности обобщения. Этот вывод может быть подтвержден тестовыми данными, представленными в Таблице 4. Как показано на Рисунке 7c,d, более высокие потери на валидации и более низкая точность валидации предполагают, что ResNet-50 не так эффективен в обобщении на невидимые данные, как две другие модели. Дополнительно, более волатильные кривые потерь и точности валидации указывают на плохую стабильность модели для ResNet-50. Эти явления могут объяснить, почему классификационная точность ResNet-50 уступает в Таблице 4. Swin-T демонстрирует относительно стабильную производительность на тренировочных, валидационных и тестовых наборах данных, указывая на сильные возможности обобщения. Это дополнительно объясняет причину выдающейся производительности Swin-T в оценке полегания кукурузы.

Рисунок 7. Кривые потерь и точности обучения и валидации трех моделей глубокого обучения. (a) Кривые потерь обучения; (b) Кривые точности обучения; (c) Кривые потерь валидации; (d) Кривые точности валидации.

3.4. Сравнительный анализ между RF и Swin-T

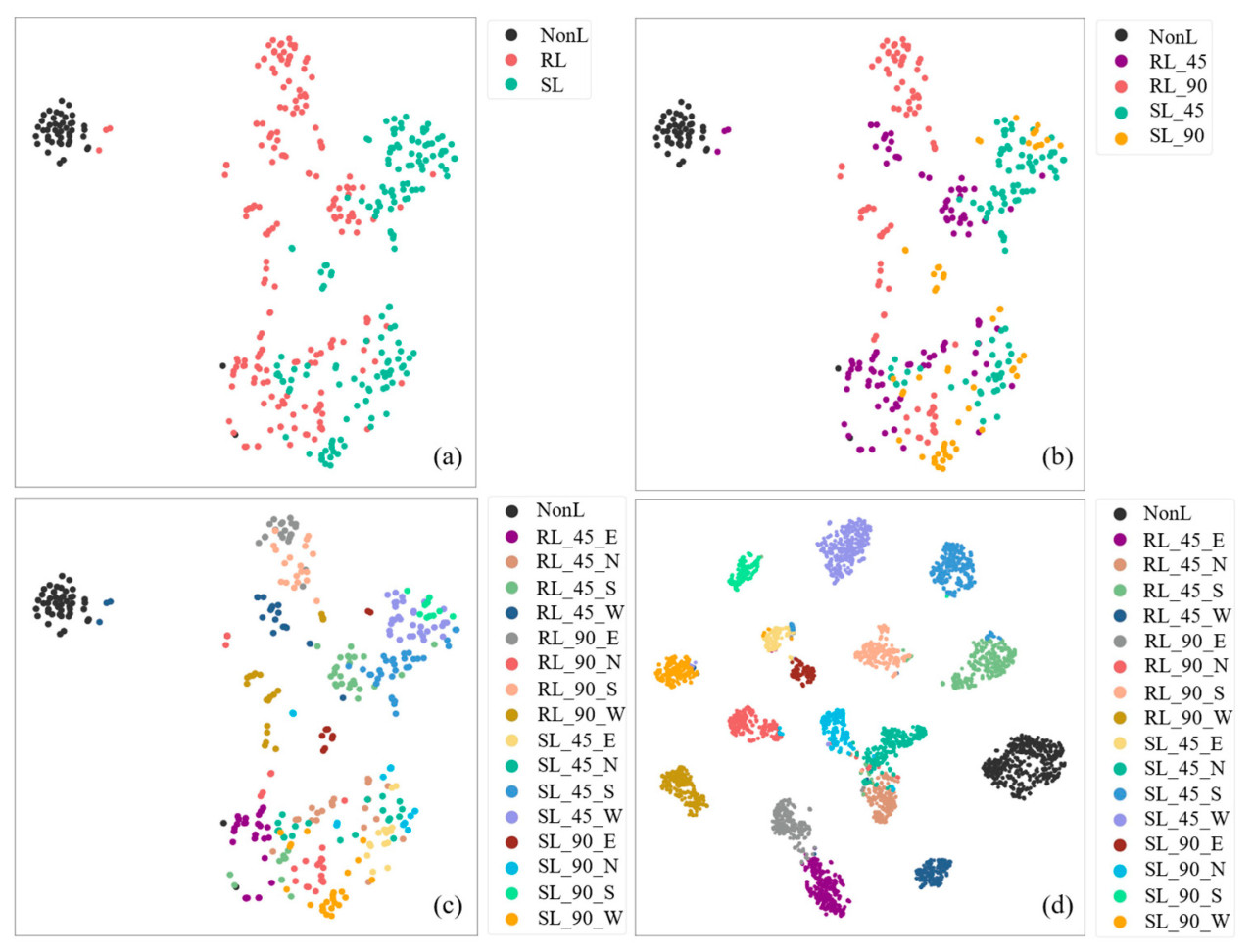

Таблица 5 представляет классификационную производительность как RF, так и Swin-T для каждой категории с использованием четырех метрик: Accuracy, Precision, Recall и F1-Score. Рисунок 8 иллюстрирует результаты этих двух классификационных моделей с использованием инструментария t-SNE (t-стохастическое вложение соседей). Как показано на Рисунке 8c,d, Swin-T превосходит RF в различении семантических признаков across 17 классов, демонстрируя превосходную внутриклассовую сплоченность и межклассовую разделимость. Это подчеркивает мощные возможности извлечения признаков моделей DL. Во-первых, и RF, и Swin-T способны эффективно различать полегшую и неполегшую кукурузу (как показано на Рисунке 8a,d). Однако RF демонстрирует меньшую степень дифференциации между полеганием корня и полеганием стебля, с границами, которые сравнительно размыты (как показано на Рисунке 8a). Рисунок 8b,c дополнительно иллюстрирует, что в результатах классификации RF существует перекрытие в нескольких образцах между RL_45 и SL_45, такими как RL_45_N (Recall 79,17%, как показано в Таблице 5) и SL_45_N (Recall 72,00%). Аналогично, в результатах классификации Swin-T (Рисунок 8d), расстояния между RL_45_N (Recall 83,33%) и SL_45_N (F1-score 0,9257) также относительно близки, приводя к некоторым ошибкам классификации в Swin-T. Это может быть связано с тем, что области обнаженного стебля у RL_45 и SL_45 схожи, что приводит к неочевидным различиям в спектральном отражении на мультиспектральных изображениях, влияя на классификационную производительность как RF, так и Swin-T. Во-вторых, межклассовое расстояние между RL_90 и RL_45 значительно для RF, тогда как межклассовое расстояние между SL_90 и SL_45 мало. Имеет место ситуация, когда некоторые образцы смешаны, как показано на Рисунке 8b. Это указывает на то, что RF может эффективно различать степень тяжести полегания корня, но имеет определенные ограничения в определении степени тяжести полегания стебля. Это в первую очередь потому, что полегание стебля вызывает относительно незначительные повреждения структуры полога, и кукуруза имеет сильную способность к самовосстановлению после полегания стебля, что затрудняет для RF эффективное различение двух степеней тяжести полегания стебля. Хотя SL_90_N (Recall 88,64%, как показано в Таблице 5) и SL_45_N (F1-score 0,9257) в Swin-T (Рисунок 8d) также имеют отдельные образцы, смешанные на границе, общее различие все еще значительно. Наконец, Рисунок 8c показывает, что категории разных направлений полегания распределены дискретно, отражая недостаточную производительность RF в различении направлений полегания (например, Precision 65,22% для RL_90_E и Recall 75,00% для RL_90_S, как показано в Таблице 5). Хотя некоторые образцы SL_45_E (Recall 79,87%) были ошибочно классифицированы как SL_45_S (Precision 91,39%) в Swin-T, Swin-T демонстрирует значительно превосходящую способность к дискриминации направления полегания кукурузы по сравнению с RF. В заключение, Swin-T превосходит RF across трех измерений классификации: тип полегания, степень тяжести и направление. Это превосходство также объясняет, почему его OA достигла 96,02%, что на 6,73 процентных пункта выше, чем у RF (89,29%).

Рисунок 8. Визуализация t-SNE для RF и Swin-T. (a) RF для различных типов полегания; (b) RF для типов и степеней тяжести полегания; (c) RF для типов, степеней тяжести и направлений полегания. (d) Swin-T для типов, степеней тяжести и направлений полегания.

Таблица 5. Классификационная производительность RF и Swin-T для каждого параметра полегания.

4. Обсуждение

4.1. Сравнение данной работы с предыдущими исследованиями

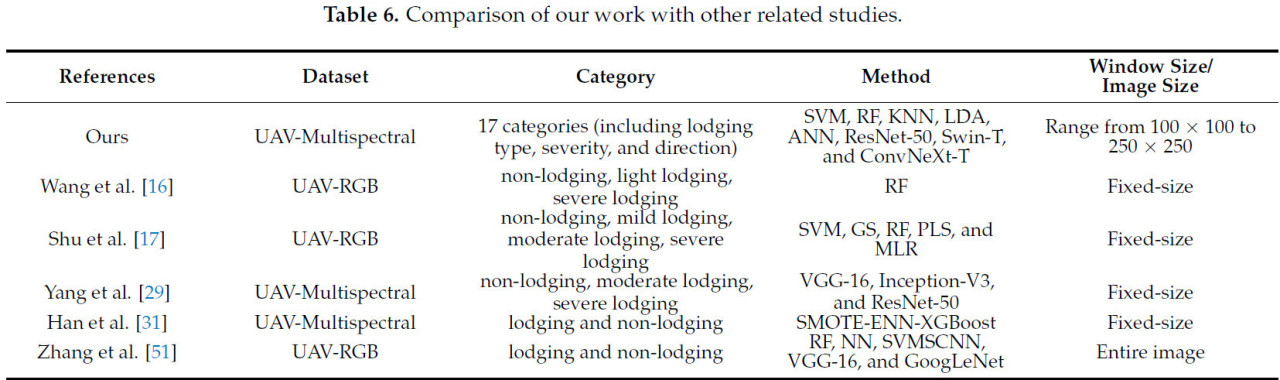

Таблица 6 предоставляет краткое summary исследований, связанных с оценкой полегания кукурузы. Предыдущие исследования преимущественно использовали БПЛА с RGB или мультиспектральными камерами для сбора наборов данных о полегании кукурузы. Например, Wang et al. [16], Shu et al. [17] и Zhang et al. [51] извлекали текстурные данные и данные структуры полога из БПЛА-RGB изображений, предлагая экономичный подход. Однако мультиспектральные изображения могут предоставить более богатую спектральную информацию, которая лучше отражает физиологическое состояние и здоровье растений. Соответственно, Yang et al. [29], Han et al. [31] и наша работа использовали мультиспектральные данные для извлечения вегетационных индексов и оценки параметров полегания кукурузы.

Таблица 6. Сравнение нашей работы с другими связанными исследованиями.

Что касается категорий классификации, Han et al. [31] и Zhang et al. [51] рассматривали только бинарную классификацию: полегшие и неполегшие условия. Однако разные степени полегания по-разному влияют на кукурузу: слабое полегание снизит урожай, в то время как сильное полегание может привести к полной потере урожая. Другие исследования, перечисленные в Таблице 6, расширили свой фокус до классификации степени тяжести полегания, тогда как наше исследование предоставило всестороннюю количественную оценку 17 параметров полегания кукурузы, включая тип, степень тяжести и направление. Эта детализация позволяет получить более подробное понимание эффектов полегания и улучшает точность оценок потери урожая.

С методологической точки зрения, подходы ML были основным выбором для оценки полегания кукурузы, в частности модель RF [16,17,51]. Хотя Yang et al. [29] и Zhang et al. [51] исследовали потенциал DL в идентификации полегания кукурузы, модели, использованные в этих исследованиях, относительно устарели. В contrast, мы провели обширный сравнительный анализ пяти широко используемых моделей ML и трех передовых моделей DL. Среди них Swin-T продемонстрировала превосходную производительность в количественной оценке полегания кукурузы, пользуясь преимуществами своего иерархического дизайна и способности эффективно захватывать глобальные и локальные признаки. Наконец, в то время как другие исследования обычно полагались на фиксированные размеры окон или все изображение в качестве входных данных для обучения модели, наша работа показала, что изменение размера окна (в диапазоне от 100 × 100 до 250 × 250) значительно влияет на точность и устойчивость моделей обнаружения полегания. Этот подход подчеркивает важность оптимизации стратегий предварительной обработки данных для улучшения производительности обнаружения полегания.

4.2. Ограничения и перспективы

Однако это исследование также имеет определенные ограничения. Хотя Swin-T продемонстрировала исключительную производительность благодаря своим надежным возможностям извлечения признаков, ожидается, что слияние множественных признаков (например, текстурных данных и данных структуры полога) дополнительно уточнит точность модели [16]. Кроме того, в этой работе использовалось искусственное полегание из-за отсутствия условий естественного полегания кукурузы в то время. Хотя это позволяет более точно исследовать различия в спектральном отражении кукурузы при различных параметрах полегания, все еще необходимо собрать более сложные данные о полегании в естественных условиях для всесторонней оценки устойчивости и обобщающей способности модели. Кроме того, это исследование в основном было сосредоточено на пространственной неоднородности полегшей кукурузы, не исследуя временную неоднородность в динамике роста кукурузы, что будет решено в наших ближайших будущих исследованиях. Наконец, модели, разработанные в этом исследовании, специально предназначены для количественной оценки параметров полегания кукурузы. Однако их прямое применение к другим культурам (например, пшенице) в настоящее время ограничено из-за различий в структуре культуры, спектральных характеристиках и особенностях полегания между кукурузой и другими культурами. Тем не менее, предложенный метод обладает высокой переносимостью на другие культуры. В частности, для целевой культуры (например, пшеницы) может быть собран соответствующий набор данных о полегании и обработан в соответствии с экспериментальным рабочим процессом, изложенным в данной статье, который включает извлечение вегетационных индексов, построение набора данных и обучение модели. С этими модификациями модель может быть адаптирована для оценки параметров полегания для нескольких культур.

5. Выводы

Быстрое получение информации о полегании с использованием количественного БПЛА-мультиспектрального дистанционного зондирования имеет ключевое значение для оценки ущерба от полегания кукурузы. Данная работа создала БПЛА-мультиспектральный набор данных, который включает полегшую кукурузу с разными типами, степенями тяжести и направлениями. Мы всесторонне проанализировали и сравнили классификационную производительность пяти моделей машинного обучения и трех моделей глубокого обучения в этих детальных категориях. Мы восполнили недостаток количественного анализа различных параметров полегания кукурузы и предоставили более точный метод для оценки ущерба от полегания.

Это исследование показало, что выбор подходящего размера окна для пространственной агрегации может эффективно подавлять шум на БПЛА-мультиспектральных изображениях, таким образом повышая точность моделей машинного обучения. Аналогично, размеры входных изображений напрямую влияют на классификационные результаты моделей глубокого обучения. Более того, случайный лес (RF) (общая точность 89,29% и коэффициент Каппа 0,8852) и Swin-T (общая точность 96,02% и коэффициент Каппа 0,9574) показали наилучшие результаты в машинном и глубоком обучении соответственно. Наконец, Swin-T превзошла случайный лес по трем параметрам: тип полегания, степень тяжести и направление, с общей точностью на 6,73 процентных пункта выше.

Это исследование раскрывает потенциал глубокого обучения для количественной оценки параметров полегания кукурузы с помощью БПЛА-мультиспектральных изображений, что было слабо изучено в предыдущей литературе.

Ссылки

1. FAOSTAT (Food and Agriculture Organization Corporate Statistical Database). World Production of Major Crops. 2023. Available online: https://www.fao.org/faostat/en/#data/QCL/visualize (accessed on 22 June 2024).

2. Pinthus, M.J. Lodging in wheat, barley, and oats: The phenomenon, its causes, and preventive measures. Adv. Agron. 1974, 25, 209–263. [Google Scholar] [CrossRef]

3. Berry, P.M.; Spink, J.H.; Gay, A.P.; Craigon, J. A comparison of root and stem lodging risks among winter wheat cultivars. J. Agric. Sci. 2003, 141, 191–202. [Google Scholar] [CrossRef]

4. Berry, P.M.; Sterling, M.; Spink, J.H.; Baker, C.J.; Sylvester-Bradley, R.; Mooney, S.J.; Tams, A.R.; Ennos, A.R. Understanding and reducing lodging in cereals. Adv. Agron. 2004, 84, 217–271. [Google Scholar] [CrossRef]

5. Baker, C.J.; Sterling, M.; Berry, P. A generalised model of crop lodging. J. Theor. Biol. 2014, 363, 1–12. [Google Scholar] [CrossRef] [PubMed]

6. Chauhan, S.; Darvishzadeh, R.; Boschetti, M.; Pepe, M.; Nelson, A. Remote sensing-based crop lodging assessment: Current status and perspectives. ISPRS-J. Photogramm. Remote Sens. 2019, 151, 124–140. [Google Scholar] [CrossRef]

7. Chauhan, S.; Darvishzadeh, R.; Boschetti, M.; Nelson, A. Discriminant analysis for lodging severity classification in wheat using RADARSAT-2 and Sentinel-1 data. ISPRS-J. Photogramm. Remote Sens. 2020, 164, 138–151. [Google Scholar] [CrossRef]

8. Guan, H.; Huang, J.; Li, L.; Li, X.; Ma, Y.; Niu, Q.; Huang, H. A novel approach to estimate maize lodging area with PolSAR data. IEEE Trans. Geosci. Remote Sens. 2022, 60, 3216341. [Google Scholar] [CrossRef]

9. Guan, H.; Huang, J.; Li, X.; Zeng, Y.; Su, W.; Ma, Y.; Dong, J.; Niu, Q.; Wang, W. An improved approach to estimating crop lodging percentage with Sentinel-2 imagery using machine learning. Int. J. Appl. Earth Obs. Geoinf. 2022, 113, 102992. [Google Scholar] [CrossRef]

10. Qu, X.; Shi, D.; Gu, X.; Sun, Q.; Hu, X.; Yang, X.; Pan, Y. Monitoring lodging extents of maize crop using multitemporal GF-1 images. IEEE J. Sel. Top. Appl. Earth Observ. Remote Sens. 2022, 15, 3800–3814. [Google Scholar] [CrossRef]

11. Qu, X.; Zhou, J.; Gu, X.; Wang, Y.; Sun, Q.; Pan, Y. Monitoring maize lodging severity based on multi-temporal Sentinel-1 images using Time-weighted Dynamic time Warping. Comput. Electron. Agric. 2023, 215, 108365. [Google Scholar] [CrossRef]

12. Huang, X.; Xuan, F.; Dong, Y.; Su, W.; Wang, X.; Huang, J.; Li, X.; Zeng, Y.; Miao, S.; Li, J. Identifying corn lodging in the mature period using Chinese GF-1 PMS images. Remote Sens. 2023, 15, 894. [Google Scholar] [CrossRef]

13. Maes, W.H.; Steppe, K. Perspectives for remote sensing with unmanned aerial vehicles in precision agriculture. Trends Plant Sci. 2019, 24, 152–164. [Google Scholar] [CrossRef] [PubMed]

14. Li, X.; Li, X.; Liu, W.; Wei, B.; Xu, X. A UAV-based framework for crop lodging assessment. Eur. J. Agron. 2021, 123, 126201. [Google Scholar] [CrossRef]

15. Wang, D.; Zhao, M.; Li, Z.; Xu, S.; Wu, X.; Ma, X.; Liu, X. A survey of unmanned aerial vehicles and deep learning in precision agriculture. Eur. J. Agron. 2025, 164, 127477. [Google Scholar] [CrossRef]

16. Wang, Z.; Nie, C.; Wang, H.; Ao, Y.; Jin, X.; Yu, X.; Bai, Y.; Liu, Y.; Shao, M.; Cheng, M.; et al. Detection and analysis of degree of maize lodging using UAV-RGB image multi-feature factors and various classification methods. ISPRS Int. J. Geo-Inf. 2021, 10, 309. [Google Scholar] [CrossRef]

17. Shu, M.; Bai, K.; Meng, L.; Yang, X.; Li, B.; Ma, Y. Assessing maize lodging severity using multitemporal UAV-based digital images. Eur. J. Agron. 2023, 144, 126754. [Google Scholar] [CrossRef]

18. Guan, H.; Liu, H.; Meng, X.; Luo, C.; Bao, Y.; Ma, Y.; Yu, Z.; Zhang, X. A quantitative monitoring method for determining maize lodging in different growth stages. Remote Sens. 2020, 12, 3149. [Google Scholar] [CrossRef]

19. Sun, Q.; Chen, L.; Xu, X.; Gu, X.; Hu, X.; Yang, F.; Pan, Y. A new comprehensive index for monitoring maize lodging severity using UAV-based multi-spectral imagery. Comput. Electron. Agric. 2022, 202, 107362. [Google Scholar] [CrossRef]

20. Sun, Q.; Gu, X.; Chen, L.; Xu, X.; Wei, Z.; Pan, Y.; Gao, Y. Monitoring maize canopy chlorophyll density under lodging stress based on UAV hyperspectral imagery. Comput. Electron. Agric. 2022, 193, 106671. [Google Scholar] [CrossRef]

21. Liu, T.; Li, R.; Zhong, X.; Jiang, M.; Jin, X.; Zhou, P.; Liu, S.; Sun, C.; Guo, W. Estimates of rice lodging using indices derived from UAV visible and thermal infrared images. Agric. For. Meteorol. 2018, 252, 144–154. [Google Scholar] [CrossRef]

22. Hu, X.; Gu, X.; Sun, Q.; Yang, Y.; Qu, X.; Yang, X.; Guo, R. Comparison of the performance of Multi-source Three-dimensional structural data in the application of monitoring maize lodging. Comput. Electron. Agric. 2023, 208, 107782. [Google Scholar] [CrossRef]

23. Wang, D.; Zhao, M.; Li, Z.; Wu, X.; Li, N.; Li, D.; Xu, S.; Liu, X. Classification of maize lodging types using UAV-SAR remote sensing data and machine learning methods. Comput. Electron. Agric. 2024, 227, 109637. [Google Scholar] [CrossRef]

24. Yuan, Q.; Shen, H.; Li, T.; Li, Z.; Li, S.; Jiang, Y.; Xu, H.; Tan, W.; Yang, Q.; Wang, J.; et al. Deep learning in environmental remote sensing: Achievements and challenges. Remote Sens. Environ. 2020, 241, 111716. [Google Scholar] [CrossRef]

25. Kamilaris, A.; Prenafeta-Boldú, F.X. Deep learning in agriculture: A survey. Comput. Electron. Agric. 2018, 147, 70–90. [Google Scholar] [CrossRef]

26. Wang, D.; Cao, W.; Zhang, F.; Li, Z.; Xu, S.; Wu, X. A review of deep learning in multiscale agricultural sensing. Remote Sens. 2022, 14, 559. [Google Scholar] [CrossRef]

27. Su, J.; Zhu, X.; Li, S.; Chen, W.H. AI meets UAVs: A survey on AI empowered UAV perception systems for precision agriculture. Neurocomputing 2023, 518, 242–270. [Google Scholar] [CrossRef]

28. Zhang, L.; Zhang, L.; Du, B. Deep learning for remote sensing data: A technical tutorial on the state of the art. IEEE Geosci. Remote Sens. Mag. 2016, 4, 22–40. [Google Scholar] [CrossRef]

29. Yang, X.; Gao, S.; Sun, Q.; Gu, X.; Chen, T.; Zhou, J.; Pan, Y. Classification of maize lodging extents using deep learning algorithms by UAV-based RGB and multispectral images. Agriculture 2022, 12, 970. [Google Scholar] [CrossRef]

30. Sun, Q.; Sun, L.; Shu, M.; Gu, X.; Yang, G.; Zhou, L. Monitoring maize lodging grades via unmanned aerial vehicle multispectral image. Plant Phenomics 2019, 2019, 5704154. [Google Scholar] [CrossRef]

31. Han, L.; Yang, G.; Yang, X.; Song, X.; Xu, B.; Li, Z.; Wu, J.; Yang, H.; Wu, J. An explainable XGBoost model improved by SMOTE-ENN technique for maize lodging detection based on multi-source unmanned aerial vehicle images. Comput. Electron. Agric. 2022, 194, 106804. [Google Scholar] [CrossRef]

32. Rouse, J.W.; Haas, R.H.; Schell, J.A.; Deering, D.W. Monitoring vegetation systems in the Great Plains with ERTS. NASA Spec. Publ. 1974, 351, 309. [Google Scholar]

33. Yang, C.; Everitt, J.H.; Bradford, J.M.; Murden, D. Airborne hyperspectral imagery and yield monitor data for mapping cotton yield variability. Precis. Agric. 2004, 5, 445–461. [Google Scholar] [CrossRef]

34. Gitelson, A.A.; Kaufman, Y.J.; Merzlyak, M.N. Use of a green channel in remote sensing of global vegetation from EOS-MODIS. Remote Sens. Environ. 1996, 58, 289–298. [Google Scholar] [CrossRef]

35. Datt, B. Remote sensing of water content in Eucalyptus leaves. Aust. J. Bot. 1999, 47, 909–923. [Google Scholar] [CrossRef]

36. Daughtry, C.S.; Walthall, C.L.; Kim, M.S.; De Colstoun, E.B.; McMurtrey, J.E., III. Estimating corn leaf chlorophyll concentration from leaf and canopy reflectance. Remote Sens. Environ. 2000, 74, 229–239. [Google Scholar] [CrossRef]

37. Barnes, E.M.; Clarke, T.R.; Richards, S.E.; Colaizzi, P.D.; Haberland, J.; Kostrzewski, M.; Waller, P.; Chio, C.; Riley, E.; Thompson, T.; et al. Coincident detection of crop water stress, nitrogen status and canopy density using ground based multispectral data. In Proceedings of the Fifth International Conference on Precision Agriculture, Bloomington, MN, USA, 16–19 July 2000; p. 1619. [Google Scholar]

38. Blackburn, G.A. Spectral indices for estimating photosynthetic pigment concentrations: A test using senescent tree leaves. Int. J. Remote Sens. 1998, 19, 657–675. [Google Scholar] [CrossRef]

39. Hunt Jr, E.R.; Daughtry, C.S.T.; Eitel, J.U.; Long, D.S. Remote sensing leaf chlorophyll content using a visible band index. Agron. J. 2011, 103, 1090–1099. [Google Scholar] [CrossRef]

40. Gitelson, A.A.; Kaufman, Y.J.; Stark, R.; Rundquist, D. Novel algorithms for remote estimation of vegetation fraction. Remote Sens. Environ. 2002, 80, 76–87. [Google Scholar] [CrossRef]

41. Tucker, C.J. Red and photographic infrared linear combinations for monitoring vegetation. Remote Sens. Environ. 1979, 8, 127–150. [Google Scholar] [CrossRef]

42. Roujean, J.L.; Breon, F.M. Estimating PAR absorbed by vegetation from bidirectional reflectance measurements. Remote Sens. Environ. 1995, 51, 375–384. [Google Scholar] [CrossRef]

43. Huete, A.; Didan, K.; Miura, T.; Rodriguez, E.P.; Gao, X.; Ferreira, L.G. Overview of the radiometric and biophysical performance of the MODIS vegetation indices. Remote Sens. Environ. 2002, 83, 195–213. [Google Scholar] [CrossRef]

44. Jordan, C.F. Derivation of leaf-area index from quality of light on the forest floor. Ecology. 1969, 50, 663–666. [Google Scholar] [CrossRef]

45. Gitelson, A.A.; Viña, A.; Arkebauer, T.J.; Rundquist, D.C.; Keydan, G.; Leavitt, B. Remote estimation of leaf area index and green leaf biomass in maize canopies. Geophys. Res. Lett. 2003, 30, 1248. [Google Scholar] [CrossRef]

46. Huete, A.R. A soil-adjusted vegetation index (SAVI). Remote Sens. Environ. 1988, 25, 295–309. [Google Scholar] [CrossRef]

47. Kursa, M.B.; Jankowski, A.; Rudnicki, W.R. Boruta–a system for feature selection. Fundam. Informaticae 2010, 101, 271–285. [Google Scholar] [CrossRef]

48. He, K.; Zhang, X.; Ren, S.; Sun, J. Deep residual learning for image recognition. In Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA, 27–30 June 2016; pp. 770–778. [Google Scholar] [CrossRef]

49. Liu, Z.; Lin, Y.; Cao, Y.; Hu, H.; Wei, Y.; Zhang, Z.; Lin, S.; Guo, B. Swin transformer: Hierarchical vision transformer using shifted windows. In Proceedings of the 2021 IEEE/CVF International Conference on Computer Vision (ICCV), Montreal, QC, Canada, 10–17 October 2021; pp. 10012–10022. [Google Scholar] [CrossRef]

50. Liu, Z.; Mao, H.; Wu, C.Y.; Feichtenhofer, C.; Darrell, T.; Xie, S. A convnet for the 2020s. arXiv 2022, arXiv:2201.03545. [Google Scholar] [CrossRef]

51. Zhang, Z.; Flores, P.; Igathinathane, C.; Naik, D.L.; Kiran, R.; Ransom, J.K. Wheat Lodging Detection from UAS Imagery Using Machine Learning Algorithms. Remote Sens. 2020, 12, 1838. [Google Scholar] [CrossRef]

Zhao M, Wang D, Yan Q, Li Z, Liu X. UAV-Multispectral Based Maize Lodging Stress Assessment with Machine and Deep Learning Methods. Agriculture. 2025; 15(1):36. https://doi.org/10.3390/agriculture15010036

Перевод статьи «UAV-Multispectral Based Maize Lodging Stress Assessment with Machine and Deep Learning Methods» авторов Zhao M, Wang D, Yan Q, Li Z, Liu X., оригинал доступен по ссылке. Лицензия: CC BY. Изменения: переведено на русский язык

Комментарии (0)