Разработка гусеничного электроробота для прополки органического лука

Сокращение численности фермеров стало серьезной проблемой для японского сельского хозяйства. В ответ на это растет интерес к электрификации и автоматизации сельскохозяйственной техники, особенно в контексте Целей устойчивого развития (ЦУР) ООН. Данное исследование сосредоточено на разработке гусеничного робота на электрической тяге, предназначенного для операций по прополке, с целью сокращения использования гербицидов при органическом выращивании лука. Прополка требует точных, аккуратных операций в течение длительного времени, что делает ее физически и морально тяжелой задачей.

Аннотация

Для облегчения трудовой нагрузки, связанной с прополкой, мы использовали цветную камеру для захвата изображений культуры и применили искусственный интеллект (ИИ) для идентификации рядков. Была разработана автоматизированная система, в которой электрогусеничник следовал по идентифицированным рядкам. Данные распознавания передавались на управляющий ПК, который направлял движение гусеничной платформы через драйверы моторов, оснащенные интерфейсом связи CAN (Controller Area Network).

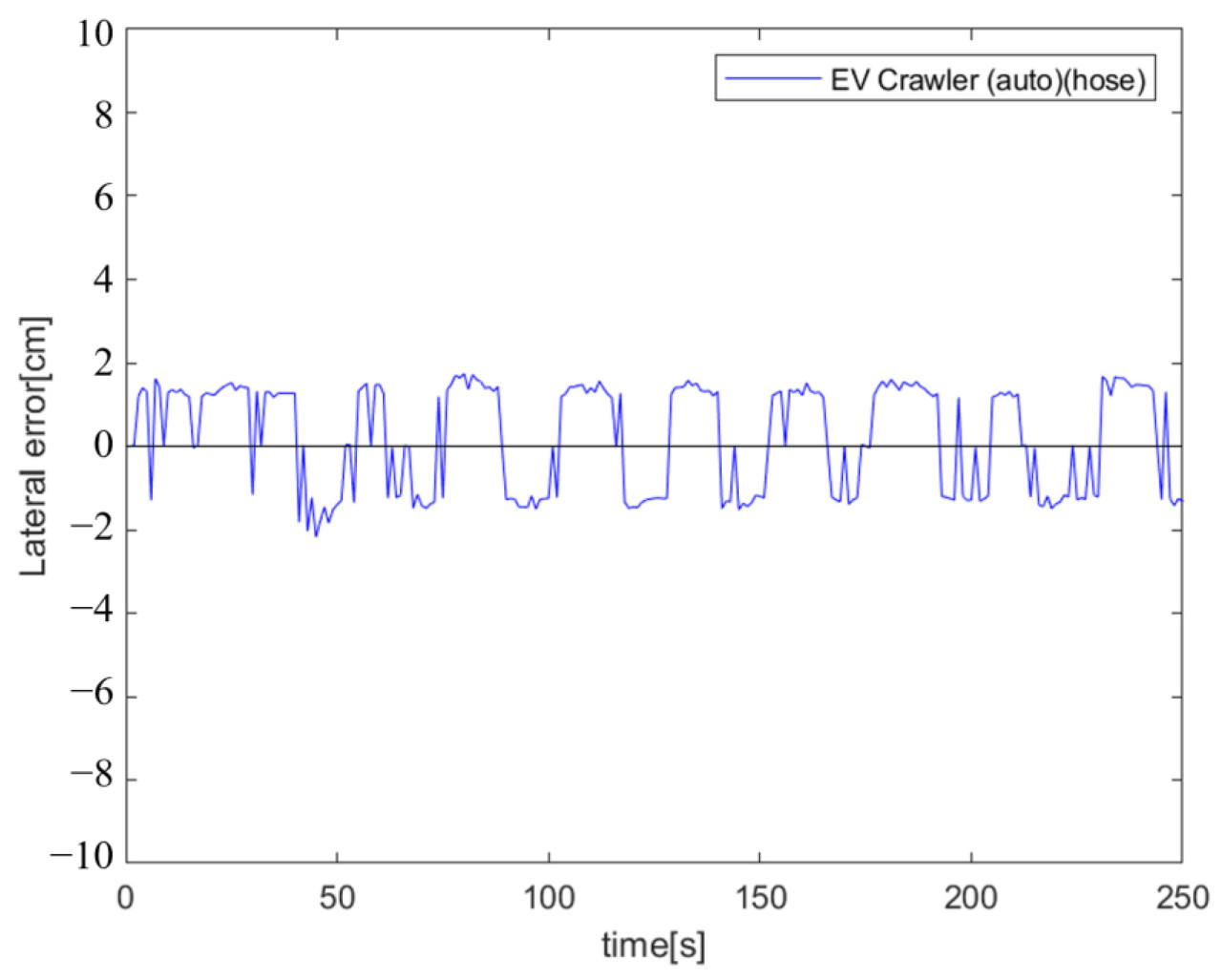

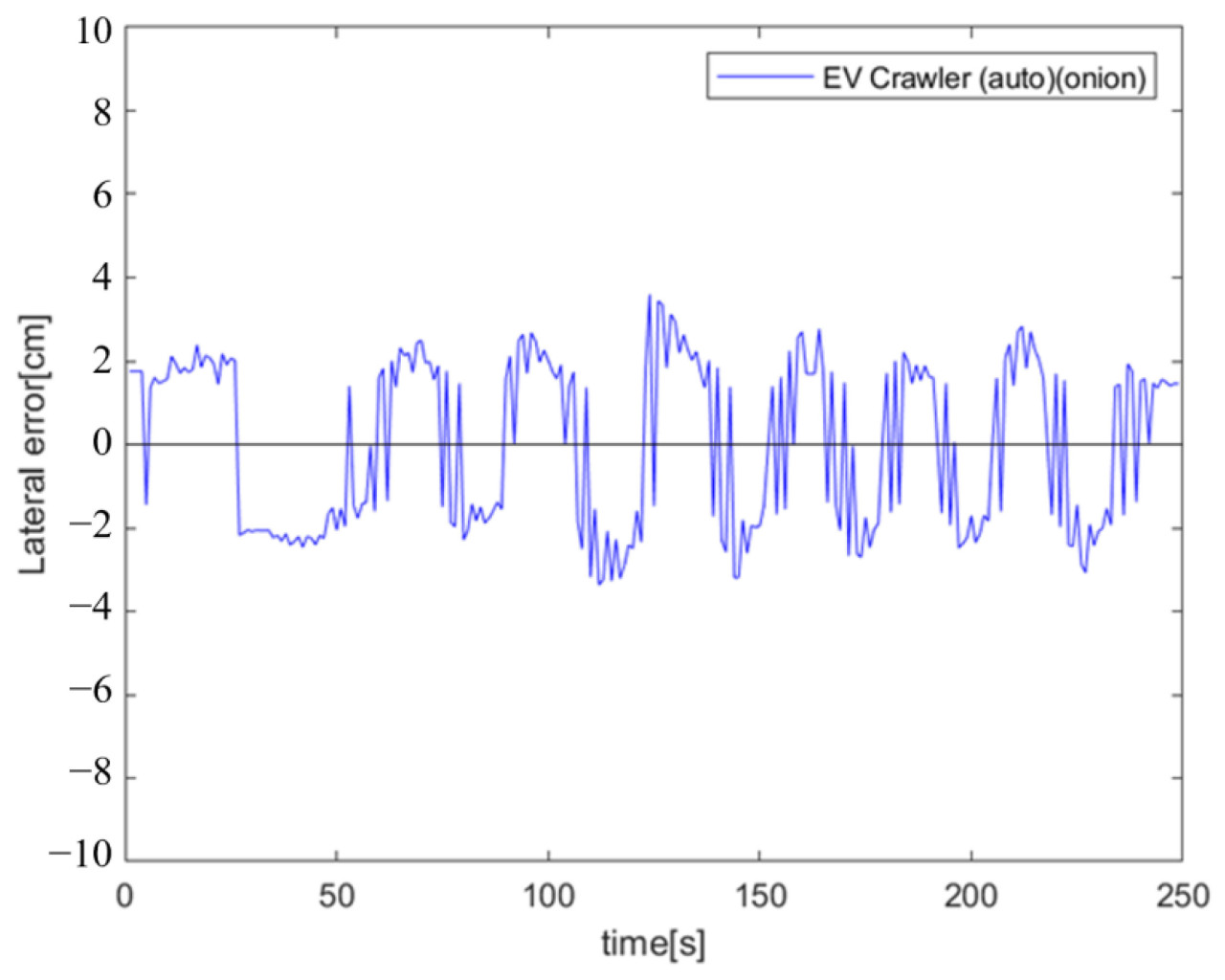

На основе результатов идентификации рядков система регулировала разность скоростей двигателей, что позволяло электрогусеничнику следовать по рядкам с высокой точностью. Полевые эксперименты продемонстрировали эффективность системы: при автоматизированной работе сохранялось боковое отклонение в пределах ±2,3 см, в то время как максимальная ошибка при ручном управлении составляла ±10 см. Эти результаты указывают на то, что система автоматизации обеспечивает более высокую точность и пригодна для задач по прополке в органическом земледелии.

1. Введение

В последние годы сельское хозяйство Японии сталкивается с растущими проблемами, в частности, из-за сокращения числа основных работников и увеличения доли работников пожилого возраста. Эти демографические тенденции, обусловленные снижением рождаемости и старением населения страны, значительно повлияли на сельскохозяйственную рабочую силу [1]. Одновременно растущая экологическая осведомленность вывела органическое земледелие в центр внимания. Органическое земледелие не только снижает риск загрязнения окружающей среды, но и повышает стоимость сельскохозяйственной продукции [2,3,4,5]. Однако основной проблемой органического земледелия является повышенная трудоемкость прополки по сравнению с традиционным использованием гербицидов [6]. Роботизированная автоматизация была признана эффективным решением этой проблемы [7]. Среди различных методов автоматизации борьбы с сорняками в органическом земледелии особого внимания заслуживают пропольные культиваторы [8]. Эти устройства используются при возделывании нескольких культур, включая бобовые, кукурузу, картофель, лук и сахарную свеклу. Работа пропольных культиваторов требует тонкой точности, часто на сантиметровом уровне, в течение длительного времени, что физически и морально утомительно, дополнительно подчеркивая необходимость автоматизации.

Автоматизация операций пропольного культиватора требует систем, способных как следовать по рядкам культур, так и точно их распознавать. В реальных полевых условиях пересадка культур — будь то механическая или ручная — может приводить к разной степени смещения рядков. Следовательно, пропольные машины без обратной связи не могут автоматически корректировать движение согласно изгибам рядков, что может привести к повреждению культур. Поэтому для автоматизированных систем важно избегать повреждения всходов. Пропольные культиваторы широко используются в органическом выращивании лука [9]. Междурядья при выращивании лука обычно составляют от 12 до 15 см, что уже, чем у таких культур, как кукуруза (20–70 см) и соя (60–70 см). Таким образом, требуется высокая точность отслеживания рядков [10,11,12]. Эта точность имеет ключевое значение для успешной автоматизации. Исследования систем автоматического руления для сельскохозяйственной техники изучали методы с использованием как глобальных навигационных спутниковых систем (GNSS), так и систем на основе камер [13,14]. В случае автоматического руления тракторов были разработаны гидравлические системы рулевого управления, которые могут отслеживать целевые линии с отклонением угла поворота менее 2,192° и максимальной ошибкой бокового слежения за путем 4,39 см [15,16]. Используя GNSS и инерциальные навигационные системы (INS), сельскохозяйственные тракторы смогли достичь ошибки бокового слежения за путем всего 2,94 см в условиях прямолинейного движения [17]. Однако навигационные системы на основе GNSS уязвимы для факторов окружающей среды, таких как погодные условия, позиционирование спутников и окружающие препятствия. Чтобы преодолеть эти ограничения, разрабатываются системы обнаружения дорог на основе машинного зрения, не зависящие от GNSS. Эти системы работают за счет сегментации поверхностей и краев дороги из RGB-изображений, полученных камерами. Полученная ошибка по боковому отклонению от системы машинного зрения затем может передаваться в систему автоматической навигации трактора, обеспечивая автоматическое вождение с боковыми ошибками менее 0,2 м на грунтовых дорогах и менее 0,4 м на мощенных дорогах [18]. Это наглядно показывает, что автоматическая работа пропольного культиватора возможна, если рядки культур могут быть успешно распознаны.

Распознавание и определение рядков культур широко изучались с использованием методов обработки изображений и искусственного интеллекта (ИИ). Методы обработки изображений для определения рядков культур обычно включают идентификацию плотности сорняков, обеспечение наведения и извлечение перекрывающихся данных для обработки в определенных областях, что позволяет оценивать и распознавать рядки культур [19]. Распознавание кривых обычно выполняется путем извлечения характерных точек из изображений и постепенного определения путей [20]. Однако определение рядков культур на основе изображений часто подвержено ошибкам распознавания из-за роста культур, что требует настройки различных шаблонов. Обнаружение рядков культур на основе машинного зрения, как правило, сталкивается с такими проблемами, как низкая точность обнаружения и неоптимальная производительность в реальном времени. Дальнейшие, сложные полевые условия — такие как высокая плотность сорняков, плохое освещение и наличие теней от растительности — создают значительные трудности для обнаружения рядков культур [21,22]. Последние достижения в методах распознавания изображений на основе ИИ предоставляют решения этих проблем [23]. Например, семантическая сегментация с использованием архитектур глубоких нейронных сетей, таких как Fully Convolutional Networks (FCN) и U-Net, была успешно применена к операциям сбора чая, позволяя извлекать контуры чайных рядков для точного определения рядков культур [24]. Дополнительно, глубокое обучение модели, такие как R-CNN и SSD, продемонстрировали эффективность в определении рядков культур на рисовых полях [25]. На полях клубники сверточные нейронные сети (CNN) использовались для сегментации RGB-изображений на области культур и не-культур, эффективно обрабатывая неровные контуры [26]. Для картофеля U-Net с базовой архитектурой VGG16 применялась для адаптивной регулировки позиции линии визуального наведения в соответствии со стадиями роста культуры, обеспечивая точное обнаружение навигационной линии [27]. Определение рядков салата использовало вегетационные индексы, полученные из захваченных изображений, в сочетании с алгоритмом Progressive Sample Consensus (PROSAC) и фильтрацией по расстоянию, чтобы надежно извлекать осевые линии рядков и достигать распознавания в реальном времени со скоростью 10 кадров в секунду (FPS). Модель YOLOv8-seg была предложена за свою сбалансированную производительность как в обнаружении в реальном времени, так и в точности, превосходя другие модели сегментации, такие как Mask R-CNN, YOLOv5-seg и YOLOv7-seg, с улучшениями по среднему Average Precision (mAP50) на 10,8%, 13,4% и 1,8% соответственно. Дополнительно, она достигла скорости обнаружения 24,8 FPS на автономном устройстве Jetson Orin Nano [28]. В начальных тестах на полях лука модель YOLOv8-seg продемонстрировала свою способность надежно определять рядки культур в сложных условиях, таких как высокая плотность сорняков и меняющееся освещение. Учитывая эти результаты, модель YOLOv8-seg считается особенно подходящей для работы в реальном времени и высокой точности обнаружения, особенно для определения рядков лука с использованием распознавания изображений на основе ИИ.

Чтобы снизить воздействие на окружающую среду и повысить точность вождения, рассматривалось внедрение машин на гусеничном ходу с электроприводом. Подсчитано, что электрификация сельскохозяйственной техники сократит выбросы углекислого газа в сельском хозяйстве на 44–70%, значительно способствуя экологической устойчивости [29,30]. У машин с двигателем внутреннего сгорания, таких как тракторы, ускорение и торможение медленнее по сравнению с электромобилями, что делает высоко-точное автономное вождение более сложной задачей. Электрификация обеспечивает более точное автоматическое вождение [31]. Среди сельскохозяйственной техники широко используются как колесные, так и гусеничные типы. Гусеничные машины оказывают меньшее давление на грунт и предлагают большую эффективность тяги по сравнению с колесными машинами, что поддерживает развитие электрогусеничников [32]. Исследования по автоматическому вождению гусеничных систем показали высокие уровни точности вождения, при этом системы RTK-GPS и IMU достигли точности по боковому отклонению и направлению примерно 1 см и 0,2° соответственно [33]. По этим причинам в данной статье принят тип электрогусеничника для его эксплуатационных преимуществ.

Следовательно, данное исследование направлено на автоматизацию задач прополочного культивирования путем разработки электрогусеничника (EV), который заменяет традиционные тракторные машины в сельскохозяйственных операциях. Разработана система для выполнения автономного вождения за счет распознавания рядков культур с помощью распознавания изображений на основе ИИ и определения линий культур. Проведен сравнительный анализ между системами ручного и автоматического вождения с использованием как тракторов, так и EV-гусеничников, чтобы оценить производительность слежения разработанной системы. Практическая реализация гусеничных механизмов является весьма перспективной; однако в ходе эксплуатации возникают такие проблемы, как стоимость, масштабируемость, а также качество и доступность данных. Преодоление этих проблем потребует не только технологических достижений, но и оптимизации проектирования системы и управления ресурсами. При внедрении систем ИИ ключевое значение имеют разработка стратегий эффективного использования гусеничных машин и стремление к устойчивой эксплуатации. Полагаем, что данное исследование внесет вклад в решение этих вопросов.

2. Материалы и методы

2.1. Робот для прополки на гусеничном ходу с электроприводом

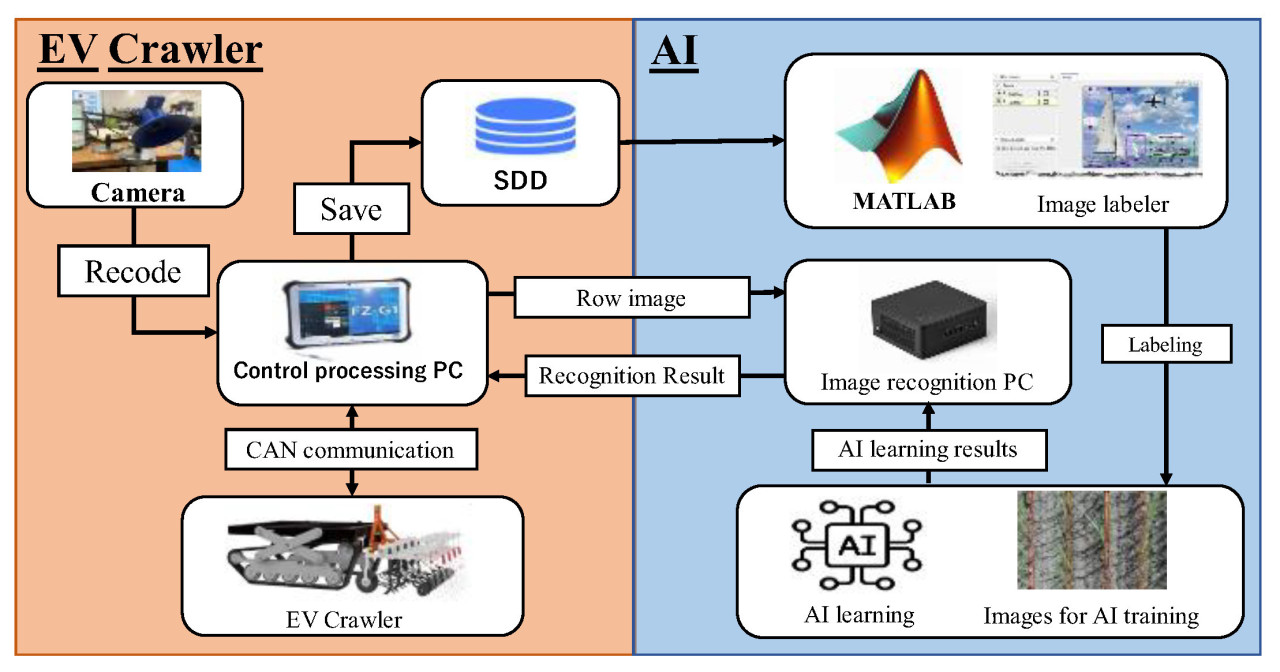

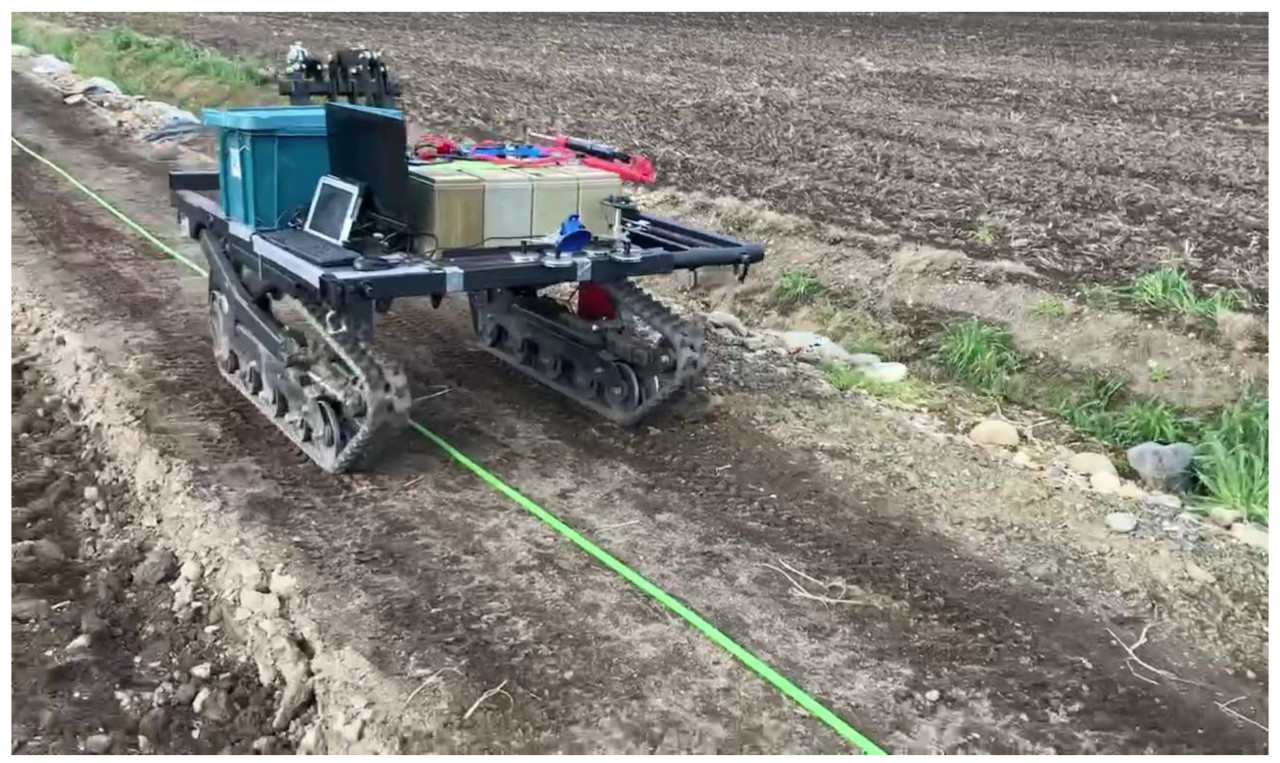

Как показано на Рисунке 1, робот для прополки на гусеничном ходу с электроприводом состоит из электрогусеничника (EV) и системы распознавания изображений на основе ИИ. EV-гусеничник захватывает изображения рядков культур с помощью интегрированной цветной камеры, которые затем передаются в реальном времени на управляющий ПК для распознавания изображений на основе ИИ. Обработанные результаты распознавания subsequently передаются обратно на управляющий ПК, который генерирует и передает команды движения на EV-гусеничник, управляя им для следования по рядкам культур и избегания их повреждения во время автоматической работы.

Рисунок 1. Схема системы робота для прополки на гусеничном ходу.

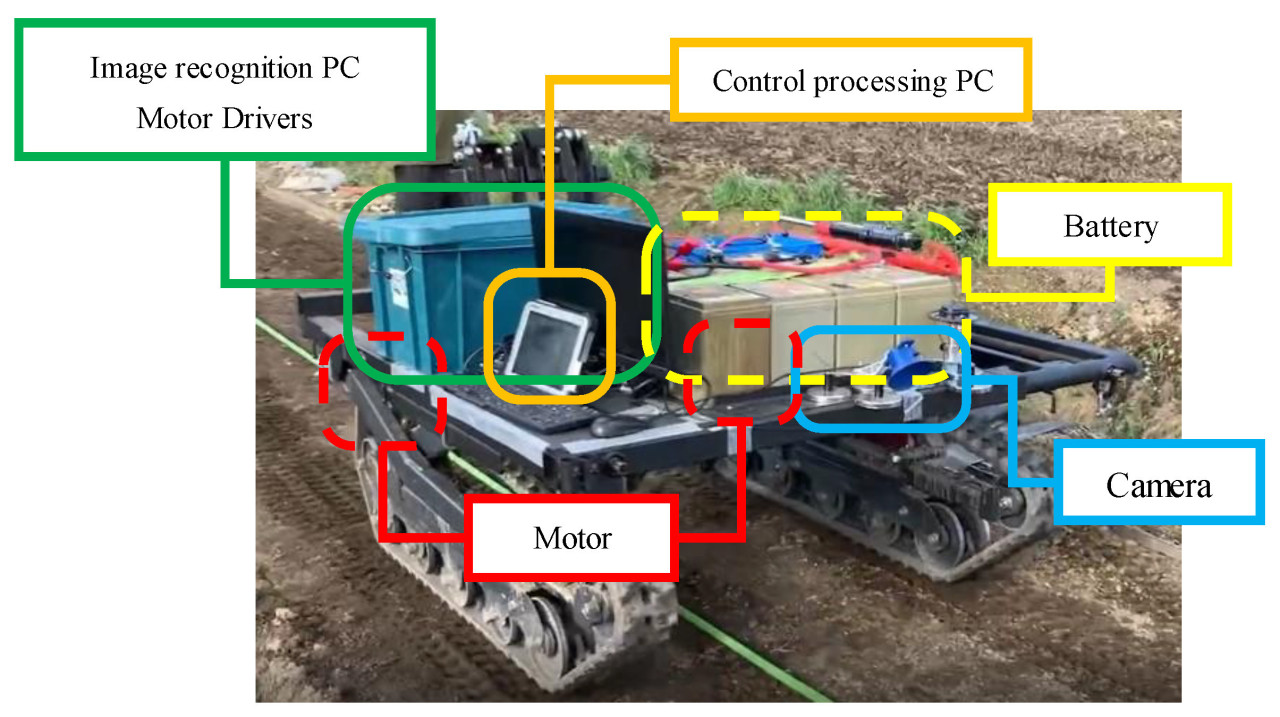

В процессе распознавания изображений на основе ИИ изображения, захваченные во время работы, аннотируются на основе собранных данных. Эти размеченные данные затем используются для обучения модели ИИ на выделенном ПК для обучения. После обучения модель развертывается на ПК для распознавания изображений, что позволяет распознавать рядки культур в реальном времени во время автономной работы. Таблица 1 описывает компоненты, использованные в роботе гусеничного типа, в то время как Рисунок 2 иллюстрирует фактическую конфигурацию робота гусеничного типа.

Рисунок 2. Робот на гусеничном ходу.

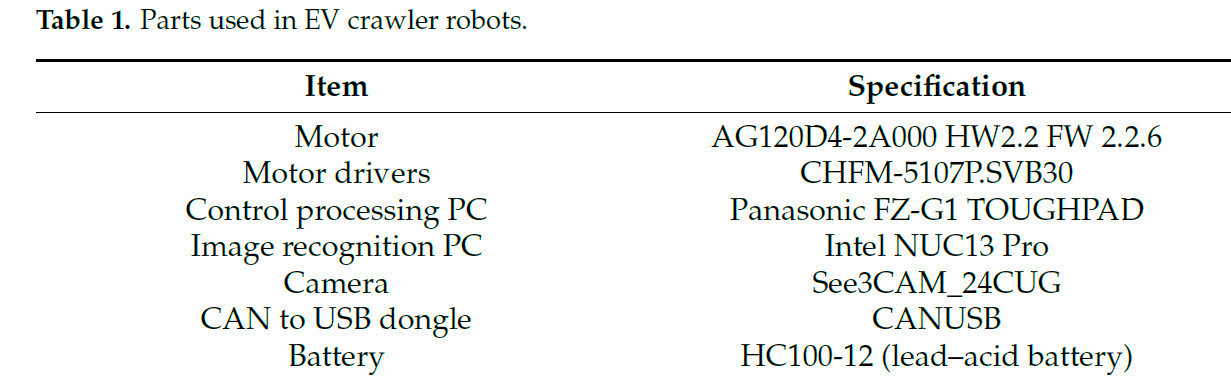

Таблица 1. Компоненты, используемые в роботах на гусеничном ходу.

2.2. Базовая конструкция EV-гусеничника

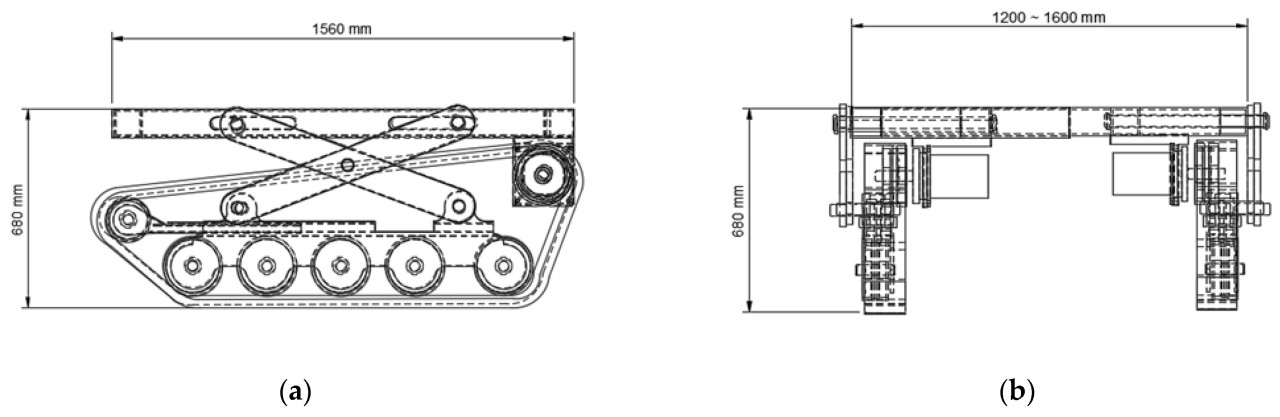

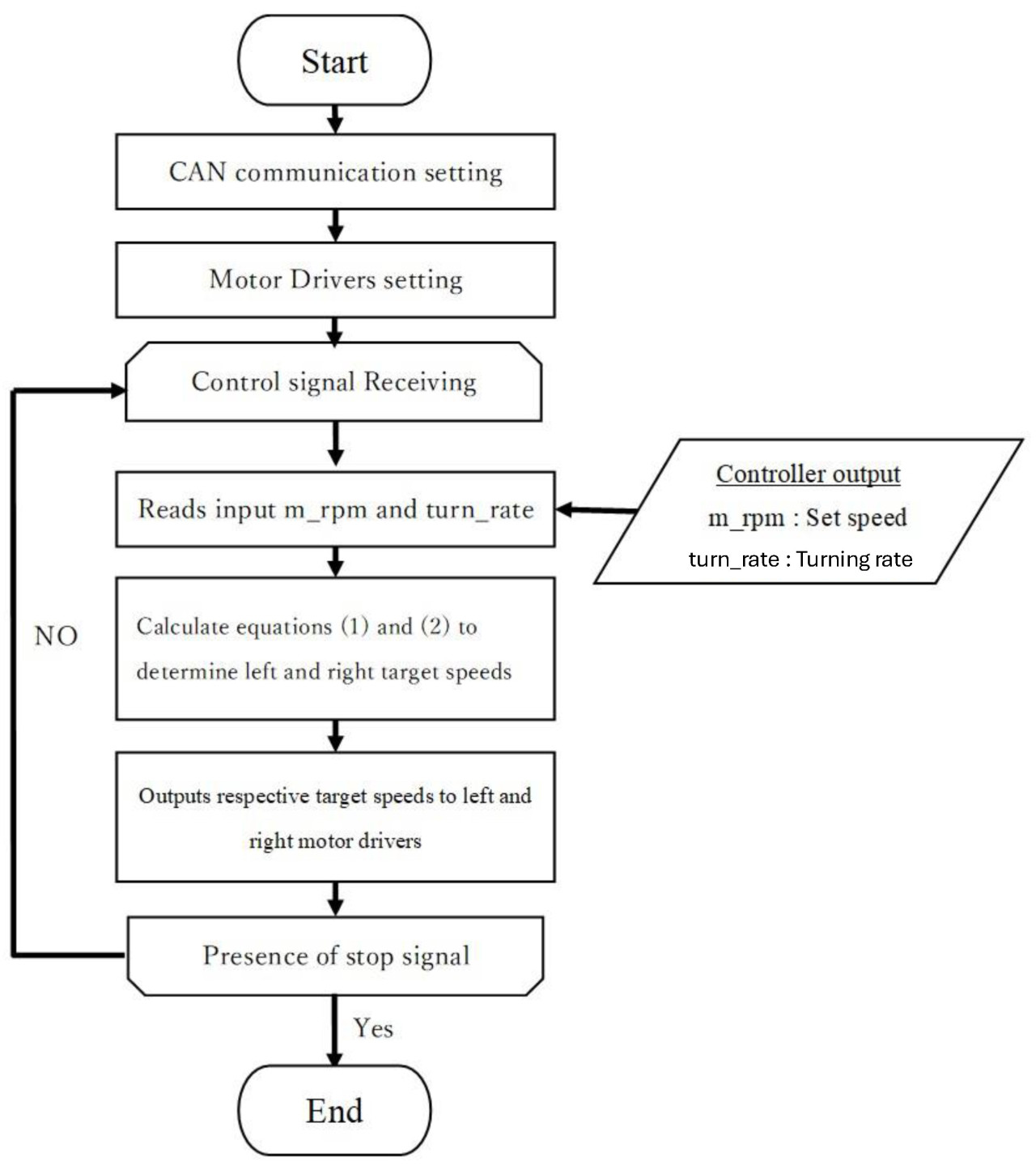

Для разработки робота для прополки на гусеничном ходу с электроприводом была проведена начальная фаза проектирования. Поскольку ширина (междурядье) рядков лука может меняться на разных полях, было необходимо регулировать ширину машины, чтобы предотвратить повреждение рядков. Решение применить конструкцию гусеничного типа было основано на нескольких факторах, включая необходимость сокращения количества рабочих компонентов за счет дифференциального привода, упрощения конструкции системы, возможности крутого разворота на месте, минимизации проскальзывания и улучшения ее проходимости по разнообразному рельефу. Рисунок 3a,b иллюстрируют базовый проект EV-гусеничника, в то время как Таблица 2 предоставляет подробные спецификации EV-гусеничника. Причиной принятия гусеничной конструкции было то, что она использует гусеницы для перемещения по земле, что распределяет ее вес по большой площади, увеличивая контактную поверхность с грунтом. Это приводит к большему трению, делая его менее склонным к проскальзыванию. Дополнительно, гусеничная система позволяет стабильно перемещаться по неровной местности или песчаным поверхностям, и при пересечении камней или препятствий гибкость гусениц позволяет им адаптироваться к грунту, облегчая преодоление этих трудностей.

Рисунок 3. (a) вид сбоку и (b) вид спереди.

Таблица 2. Спецификации EV-гусеничника.

2.3. Управление двигателем EV-гусеничника

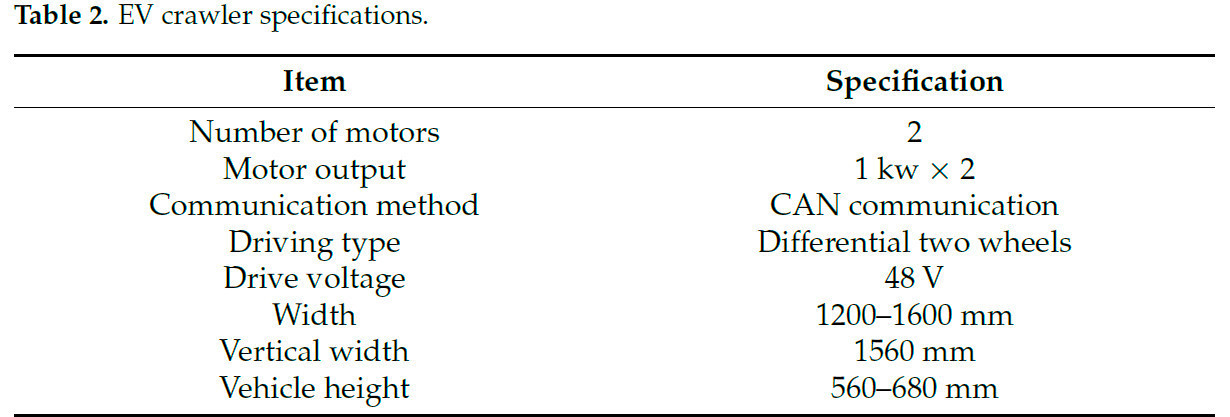

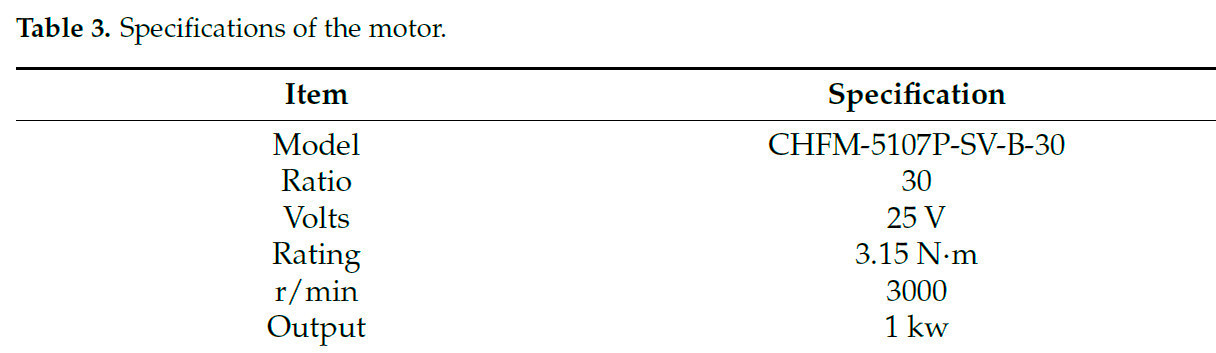

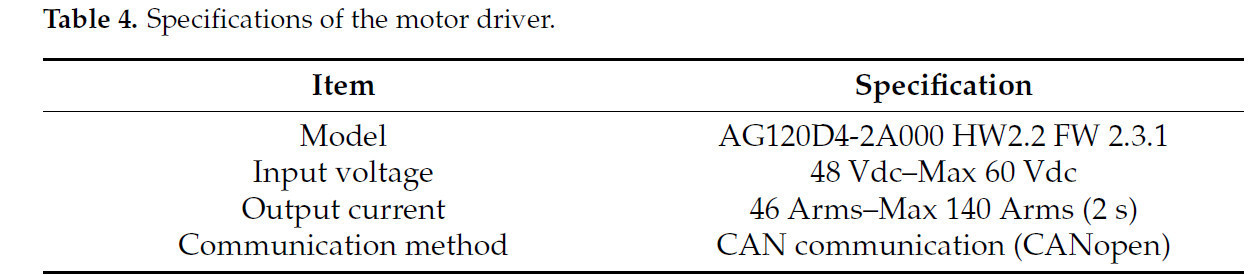

Для робота гусеничного типа была разработана программа управления двигателем. Таблица 3 представляет спецификации двигателя, в то время как Таблица 4 описывает спецификации драйвера двигателя (MD). Используемые в этой системе драйверы двигателей совместимы с коммуникацией Controller Area Network (CAN). Рисунок 4 изображает блок-схему команд привода, используемых во время работы EV-гусеничника.

Рисунок 4. Блок-схема управления двигателем.

Таблица 3. Спецификации двигателя.

Таблица 4. Спецификации драйвера двигателя.

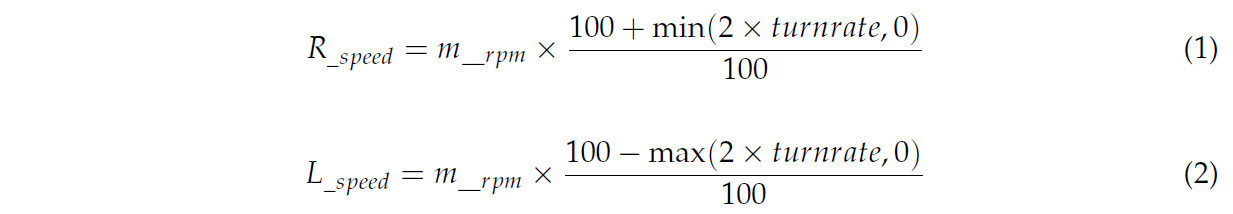

Управляющий ПК вычисляет необходимые значения, используя Выражения (1) и (2) на основе параметров m_rpm (заданная скорость: от −3000 до 3000 об/мин) и turn_rate (скорость поворота: от −50 до 50). Эти значения используются для регулировки разности скоростей между левым и правым двигателями для обеспечения поворота. Система использует дифференциальное управление двумя колесами, позволяя осуществлять плавный поворот за счет разности скоростей. Связь между управляющим ПК и драйверами двигателей осуществляется через связь PDO (Process Data Object) в рамках протокола CANopen. Операции чтения/записи выполняются через заранее определенные интервалы, что позволяет передавать команды скорости и контролировать состояния двигателей. Контролируемые параметры включают скорость вращения, ток, крутящий момент, статус ошибки и статус конфигурации двигателя, как указано в спецификациях MD. Используя связь PDO, система обеспечивает периодическое получение и передачу данных в реальном времени, предоставляя высокую реактивность во время работы.

2.4. Распознавание рядков культур с использованием ИИ

2.4.1. Сбор и разметка обучающих изображений

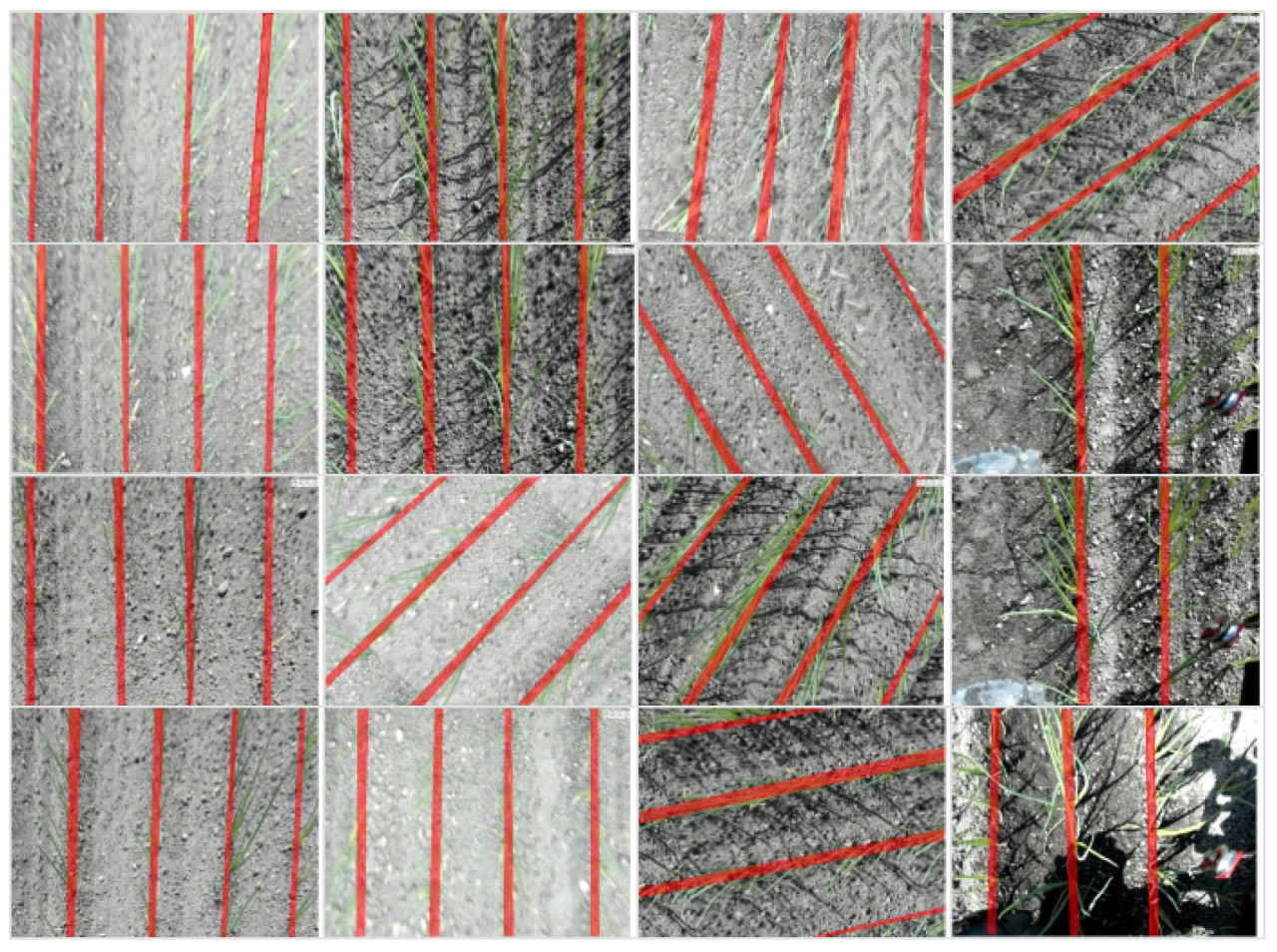

В реальном поле камера была установлена на тракторе для захвата изображений рядков культур. Изображения собирались с полей лука в разные даты и при разных погодных условиях. Однако из-за того, что камера была прикреплена к трактору, захваченные изображения представляли только прямолинейные рядки культур, и невозможно было захватить изображения диагональных рядков. В таких прямолинейных изображениях диагональные рядки не могут быть распознаны, что может затруднить восстановление или коррекцию ошибок во время движения машины при следовании по рядкам. Поэтому в данном исследовании была разработана система с использованием MATLAB2023b для искусственного создания диагональных рядков культур. Эта программа была разработана в MATLAB для изменения размера и корректировки углов этих изображений, генерируя синтетические изображения диагональных рядков культур. Случайно выбранные изображения были размечены с использованием формата многоугольника в приложении Image Labeler в MATLAB, как показано на Рисунке 5, для разметки рядков культур. Всего было размечено 270 изображений прямых рядков и 130 изображений диагональных рядков, в результате чего был создан набор из 400 размеченных изображений, который впоследствии использовался для обучения.

Рисунок 5. Разметка рядков культур красными линиями.

2.4.2. Обучение ИИ

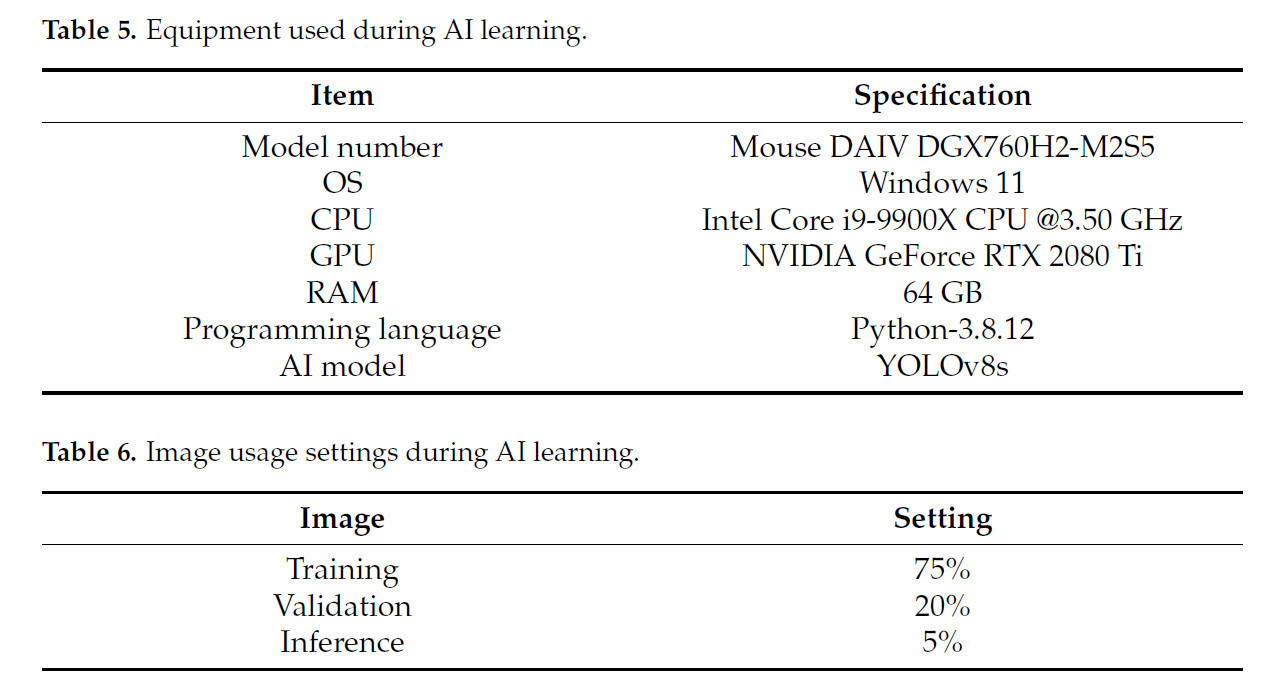

Используя размеченные обучающие данные, было проведено обучение модели ИИ на устройствах, указанных в Таблице 5. В процессе обучения использовалась определенная доля изображений для каждой размеченной категории, как подробно описано в Таблице 6. Набор данных был разделен на следующие три подмножества: обучающий набор данных использовался для обучения сети, проверочный набор данных применялся для предотвращения переобучения, а тестовый набор данных использовался после обучения для оценки производительности распознавания модели ИИ. Причина выбора YOLOv8s в данном исследовании заключается в том, что он позволяет осуществлять обработку изображений ИИ только с помощью ЦП, что позволяет миниатюризировать ПК для распознавания изображений.

Таблица 5. Оборудование, использованное во время обучения ИИ.

Таблица 6. Настройки использования изображений во время обучения ИИ.

2.4.3. Оценка обучения ИИ

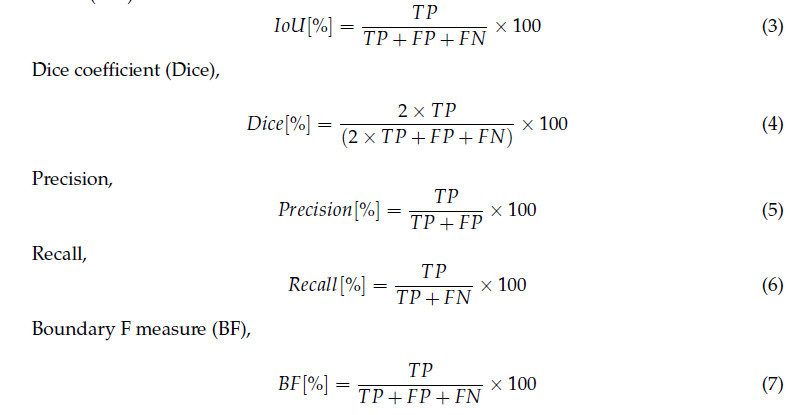

Производительность обучающей модели была оценена с использованием набора метрик оценки. Для этой оценки использовались 400 изображений, которые были выделены как тестовые изображения во время обучения. Основной используемой метрикой оценки была Intersection over Union (IoU).

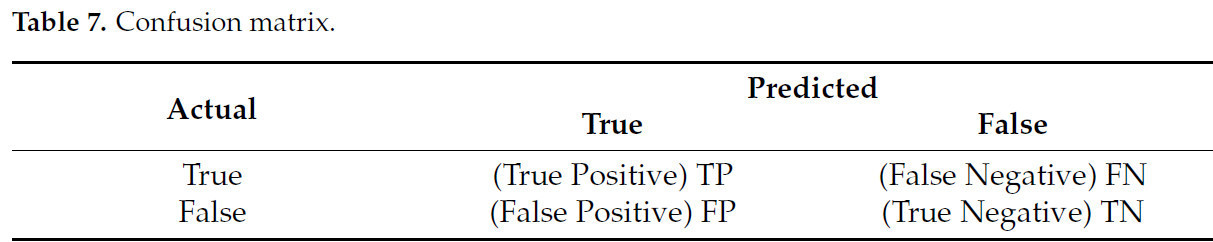

Таблица 7 представляет матрицу ошибок, где TP (True Positive) означает правильное предсказание класса рядка культуры, FP (False Positive) указывает на ложную идентификацию как класса рядка культуры, а FN (False Negative) представляет собой неудачу в идентификации класса рядка культуры. Например, при оценке класса рядка культуры пиксель, помеченный как класс рядка культуры, считается TP, если предсказан как рядок, и FN, если предсказан как другой класс. И наоборот, пиксель, помеченный как класс не-рядка культуры, классифицируется как FP, если предсказан как рядок культуры.

Таблица 7. Матрица ошибок.

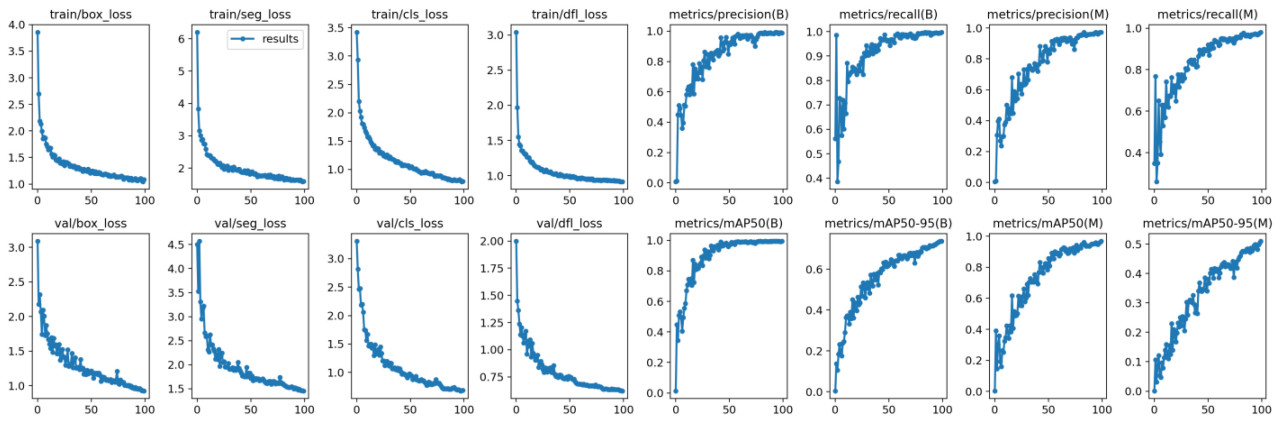

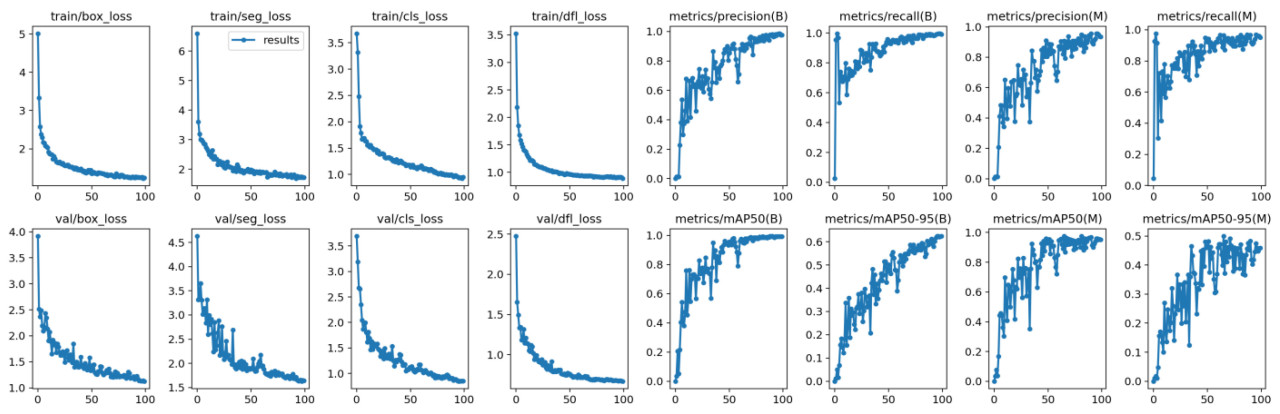

На Рисунке 6 и Рисунке 7 представлены результаты распознавания рядков лука с использованием обученной модели ИИ, которая была обучена на 340 изображениях. Распознанные моделью рядки культур выделены красным цветом. Из этих результатов видно, что модель ИИ способна распознавать рядки культур, независимо от того, прямые они или диагональные. На Рисунке 8 и Рисунке 9 показаны метрики производительности, включая потери ограничивающей рамки (train/box_loss), потери сегментации (train/seg_loss), потери классификации (train/cls_loss) и потери объектности (train/obj_loss). Эти метрики стабильно уменьшаются с увеличением эпох обучения, что указывает на то, что модель улучшается в части локализации объектов и идентификации классов. Это отражает улучшенную способность модели к обобщению для локализации объектов на ранее невиданных данных. Точность для Класса B (metrics/precision(B)), полнота для Класса B (metrics/recall(B)) и средняя средняя точность при IoU = 0,50 для Класса B (metrics/mAP50(B)) показывают растущие кривые точности. Это свидетельствует о том, что модель эффективно сокращает ложные срабатывания, улучшает свою способность идентифицировать все истинно положительные срабатывания с течением времени и достигает хорошей точности и полноты для Класса B при этом пороге IoU. Дополнительно, средняя средняя точность при IoU = 0,50:0,95 для Класса B (metrics/mAP50-95(B)) стабильно улучшается, достигая высоких конечных значений. Это демонстрирует, что модель хорошо работает при различных уровнях строгости локализации.

Рисунок 6. Результат распознавания ИИ (GPU). Распознанные рядки культур залиты красным.

Рисунок 7. Результат распознавания ИИ (CPU). Распознанные рядки культур залиты красным.

Рисунок 8. Динамика производительности обучения и проверки модели ИИ (GPU).

Рисунок 9. Динамика производительности обучения и проверки модели ИИ (CPU).

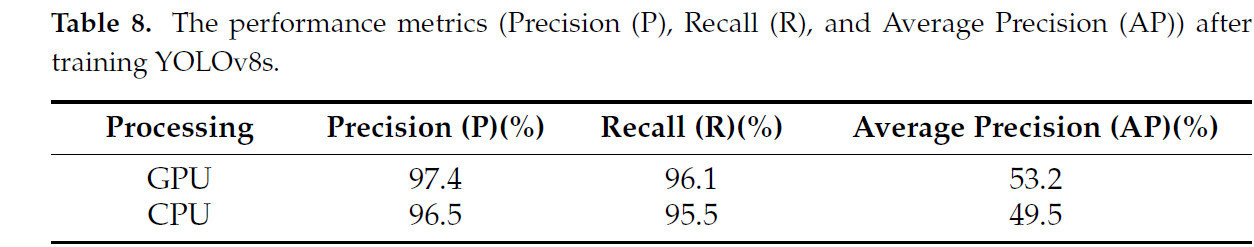

Таблица 8 представляет метрики производительности (Точность (P), Полнота (R) и Средняя Точность (AP)) после обучения YOLOv8s. Результаты показывают, что как реализации на GPU, так и на CPU достигли высоких значений точности и полноты.

Таблица 8. Метрики производительности (Точность (P), Полнота (R) и Средняя Точность (AP)) после обучения YOLOv8s.

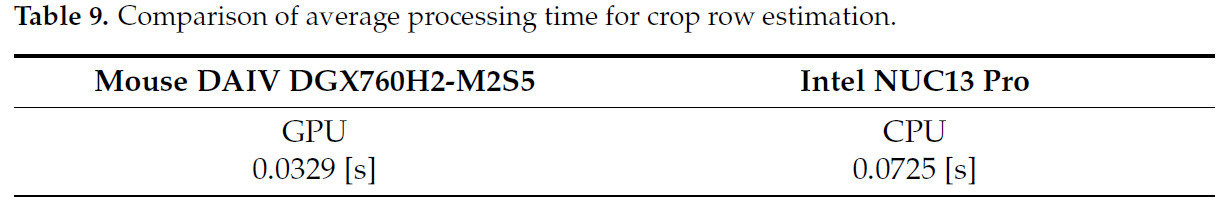

Таблица 9 сравнивает скорости обработки для определения рядков культур с использованием обработки на GPU и CPU. В то время как обработка на CPU заняла примерно в два раза больше времени, чем обработка на GPU, было установлено, что она достаточно быстра для данного применения.

Таблица 9. Сравнение среднего времени обработки для определения рядков культур.

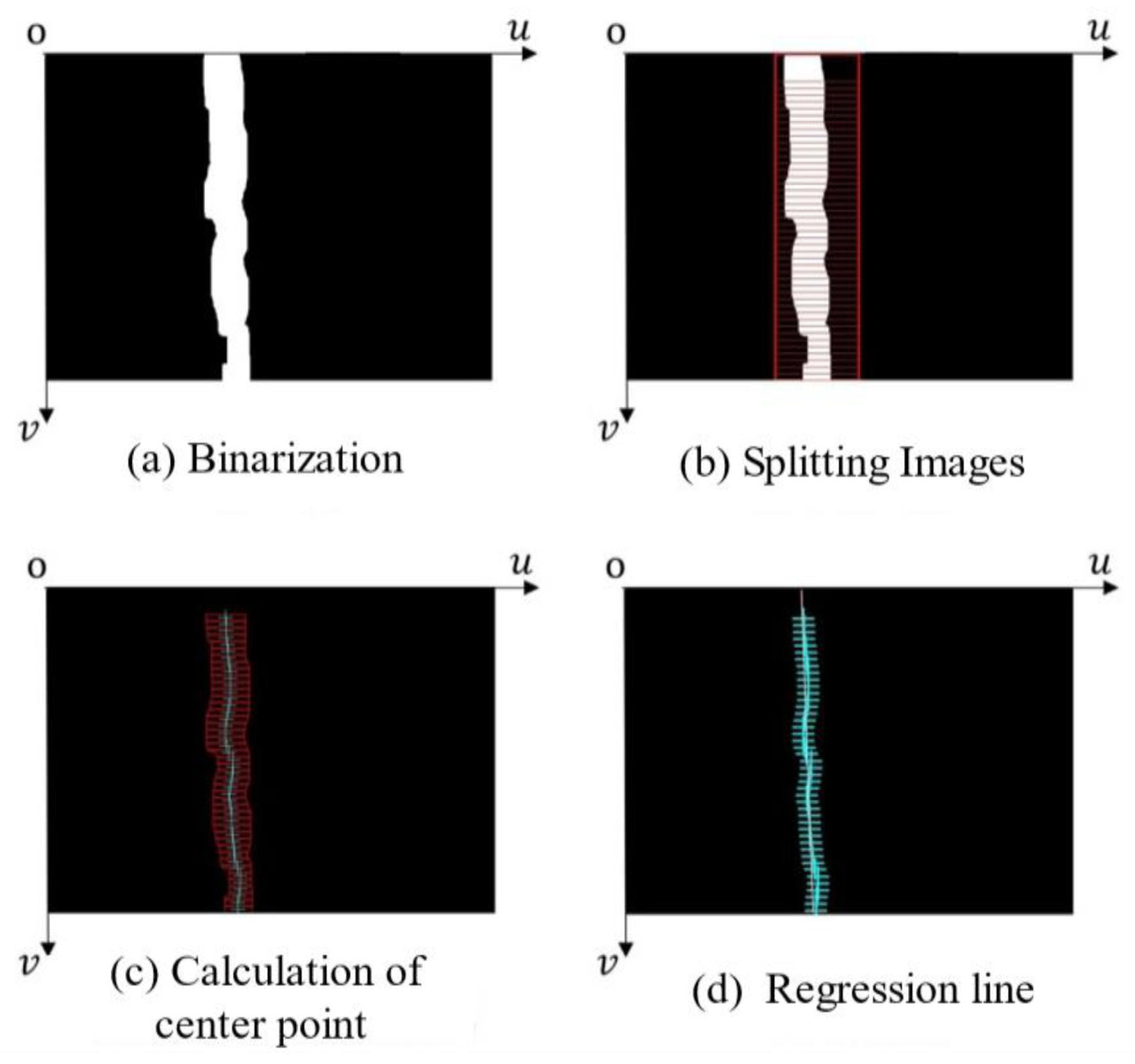

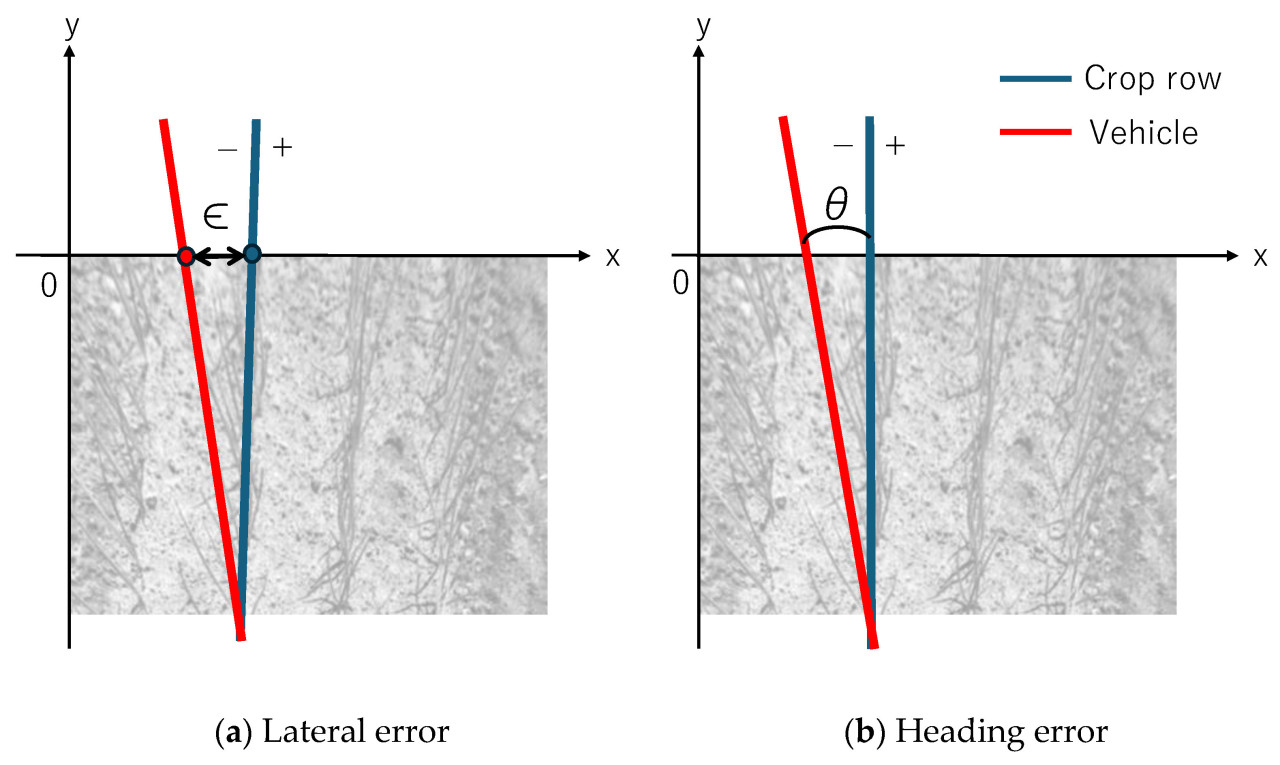

На Рисунке 10 иллюстрируется метод, использованный для обнаружения линий рядков культур. Линии рядков культур извлекаются с использованием метода наименьших квадратов, примененного к областям рядков культур, идентифицированным с помощью распознавания изображений. Эти извлеченные и оцененные линии рассматриваются как рядки культур и обозначаются как целевые линии. Из этих полученных целевых линий Рисунок 11a демонстрирует, как рассчитывается боковая ошибка, в то время как Рисунок 11b показывает расчет ошибки курса. Поскольку вертикальная ось изображения ориентирована вниз как положительная, выполняется преобразование координат для изменения ориентации оси y так, чтобы положительное направление было вверх. Синяя линия на рисунке представляет обнаруженную линию рядка культуры. Красная линия на рисунке представляет путь движения машины.

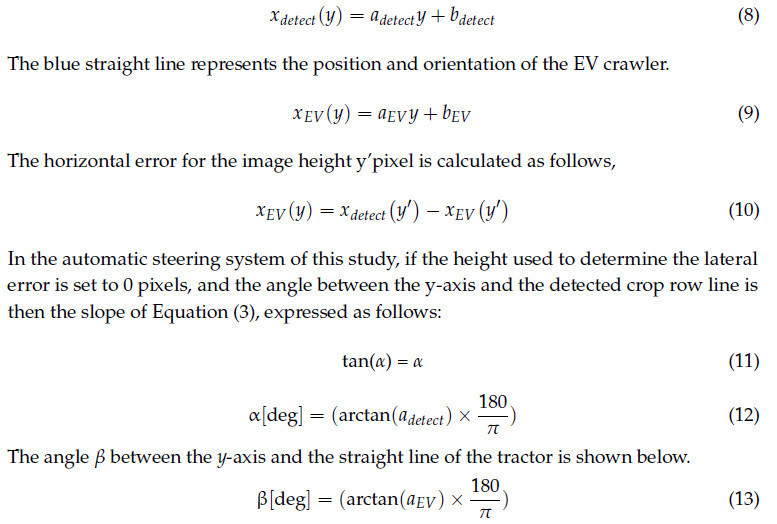

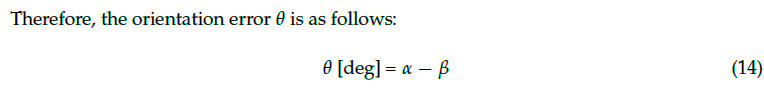

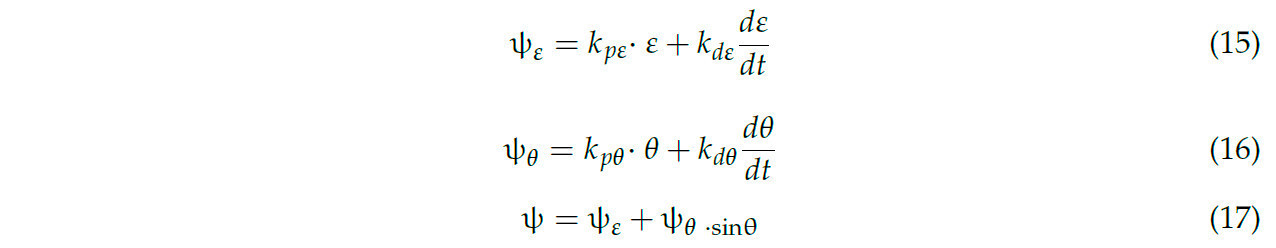

В системе автоматического руления данного исследования, если высота, используемая для определения боковой ошибки, установлена на 0 пикселей, и угол между осью y и обнаруженной линией рядка культуры равен α, тогда наклон Уравнения (3) выражается следующим образом:

Рассчитанный ψ будет выводиться как turn_rate EV-гусеничника, как показано на Рисунке 4, чтобы позволить роботу следовать по рядкам культур.

Рисунок 10. Процедура расчета прямой линии рядка культуры.

Рисунок 11. Определение боковой ошибки и ошибки курса.

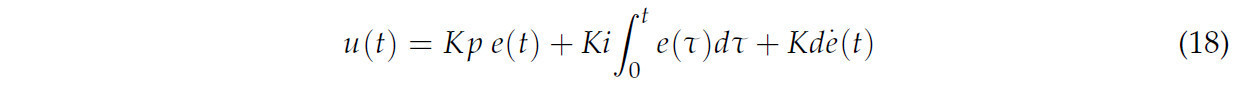

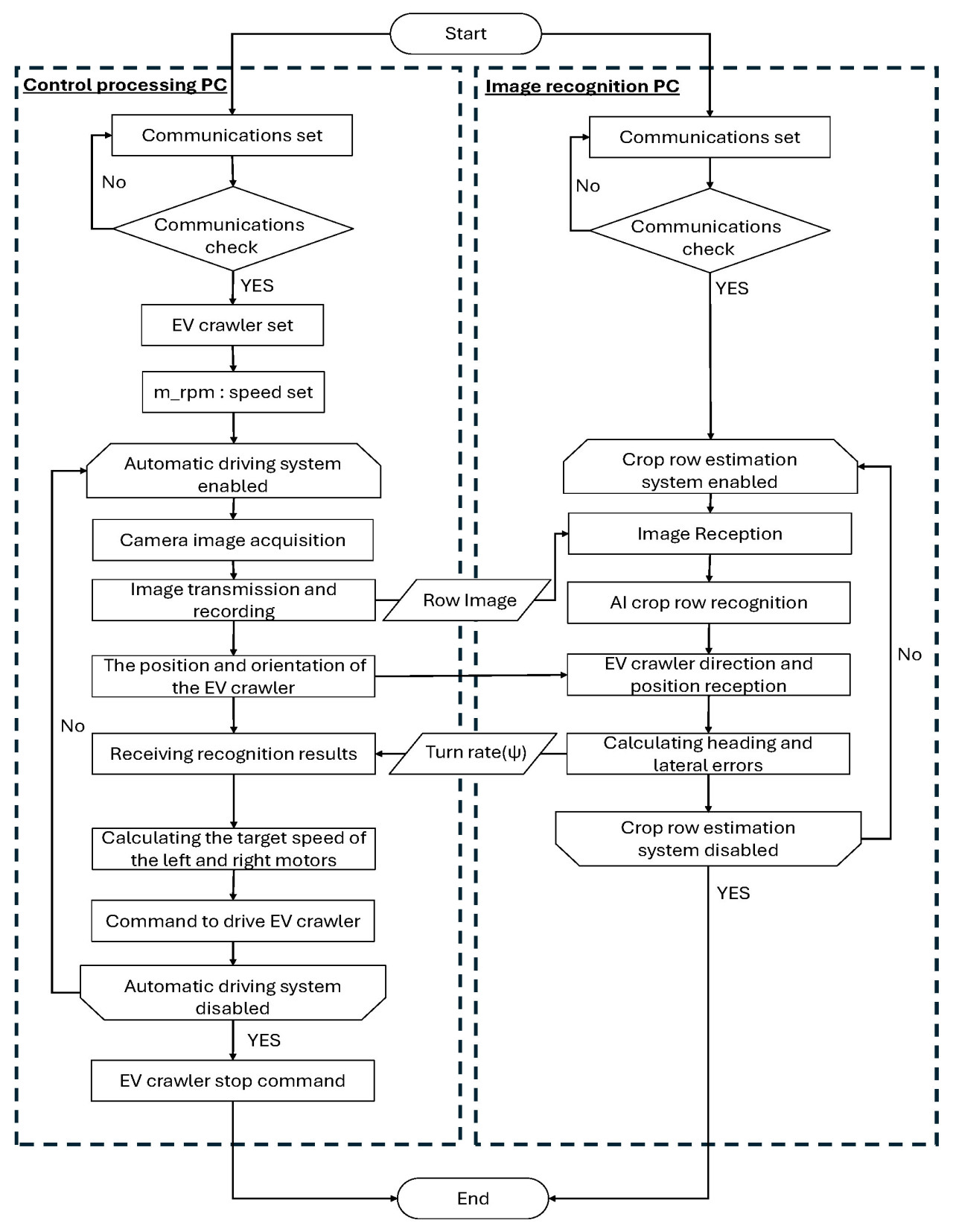

Система автоматического вождения EV-гусеничника структурирована в соответствии с потоком, описанным на Рисунке 12. Процедура вождения включает определение угла поворота EV-гусеничника на основе обнаруженных линий рядков культур. Это достигается путем размещения опорных линий на изображении для указания позиции и ориентации EV-гусеничника. Далее, целевая скорость (m_rpm) устанавливается на экране, и процесс вождения инициируется нажатием кнопки пуска. Уравнение (18) описывает формулу для PID-регулирования. PID-регулирование применяется для обеспечения того, чтобы целевое значение рассчитанного угла поворота (turn_rate) становилось равным нулю. Настройка параметров PID-регулятора выполняется вручную путем практического управления EV-гусеничником. В настоящее время система предназначена для следования только прямым и диагональным линиям, и она не может обрабатывать ситуации, когда рядки культур больше не распознаются или когда происходят изменения в междурядьях.

Рисунок 12. Система управления автоматическим вождением.

3. Результаты экспериментов

Эксперимент проводился на полях компании Yahagi Agriculture Co., Ltd., расположенной в городе Цубецу, округ Абасири, Хоккайдо, в сезон прополки 2024 года. Были выполнены два типа испытаний: одно включало имитацию рядков культур с использованием зеленых шлангов, а другое — фактическую прополку культиватором на полях лука. Зеленый шланг использовался в качестве заменителя рядков культур. Обоснование этого выбора заключалось в способности шланга легко формировать прямые или изогнутые линии, облегчая оценку точности слежения за целью. Дополнительно, шланг можно было подготовить независимо от сезона, предлагая высокую универсальность в имитационных средах. Эта характеристика позволяет проводить эффективные и последовательные эксперименты, имитирующие реальные полевые условия. Были записаны как ручные, так и автоматические операции трактора и EV-гусеничника. Системы двигались со скоростью примерно 5 км/ч с прикрепленным пропольным культиватором, и их производительность слежения сравнивалась.

Дополнительные 50 изображений были включены в обучающий набор данных, чтобы позволить системе точно обнаруживать зеленые шланги. Точность слежения за рядками культур оценивалась путем записи боковых ошибок на основе результатов распознавания изображений ИИ. Рисунок 13 иллюстрирует экспериментальную установку с использованием шлангов.

Рисунок 13. Экспериментальная среда (шланг).

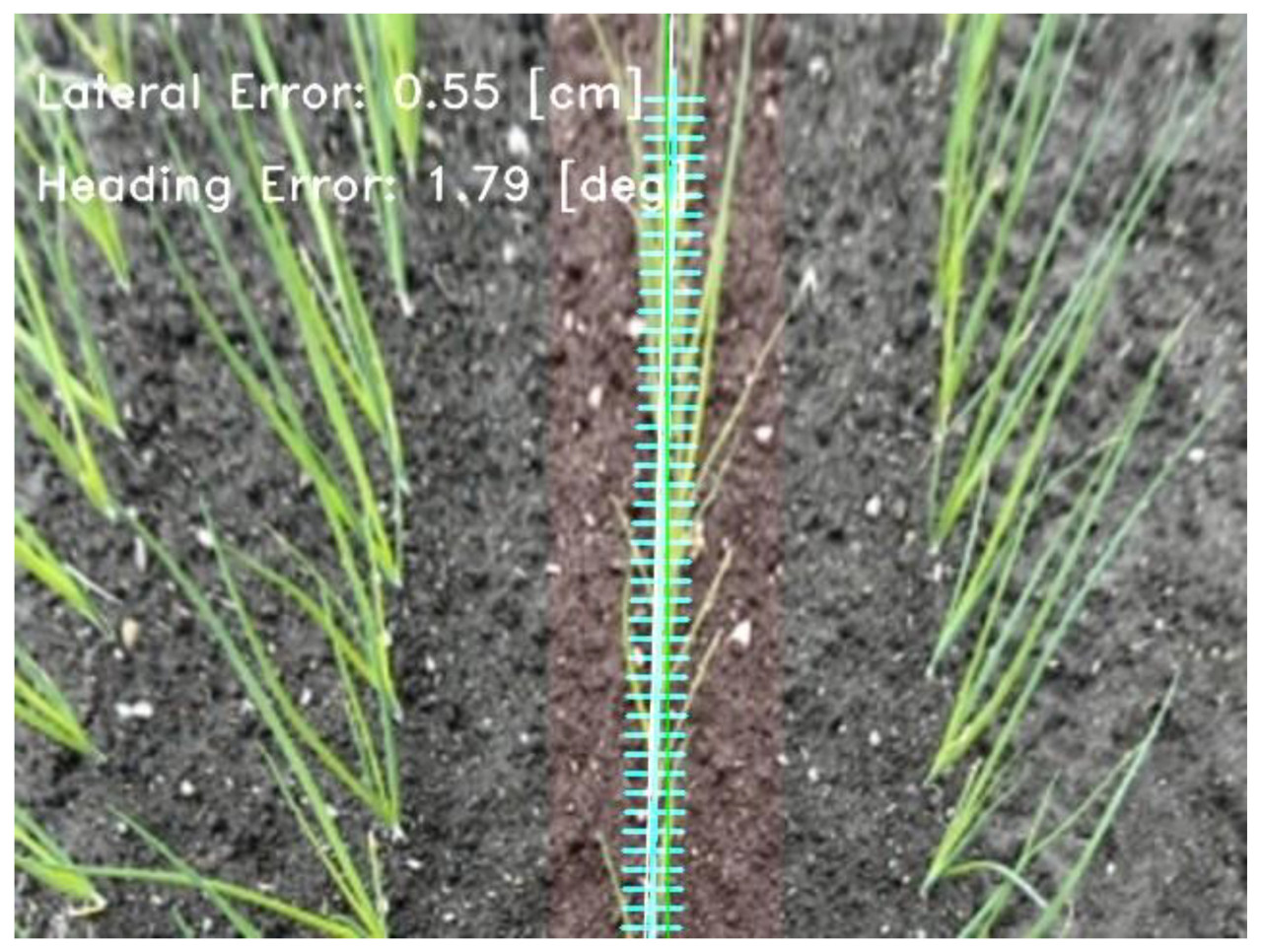

Чтобы оценить точность слежения разработанной системы автономного вождения, были проведены фактические операции прополки на полях лука с использованием культиватора. Были записаны ручное управление трактором фермером, а также как ручное, так и автономное управление EV-гусеничником. Точность слежения за рядками культур оценивалась путем записи боковых ошибок из результатов распознавания изображений ИИ, аналогично эксперименту с зелеными шлангами. Рисунок 14 иллюстрирует экспериментальную среду, в которой система следовала за фактическими рядками лука.

Рисунок 14. Экспериментальная среда (лук).

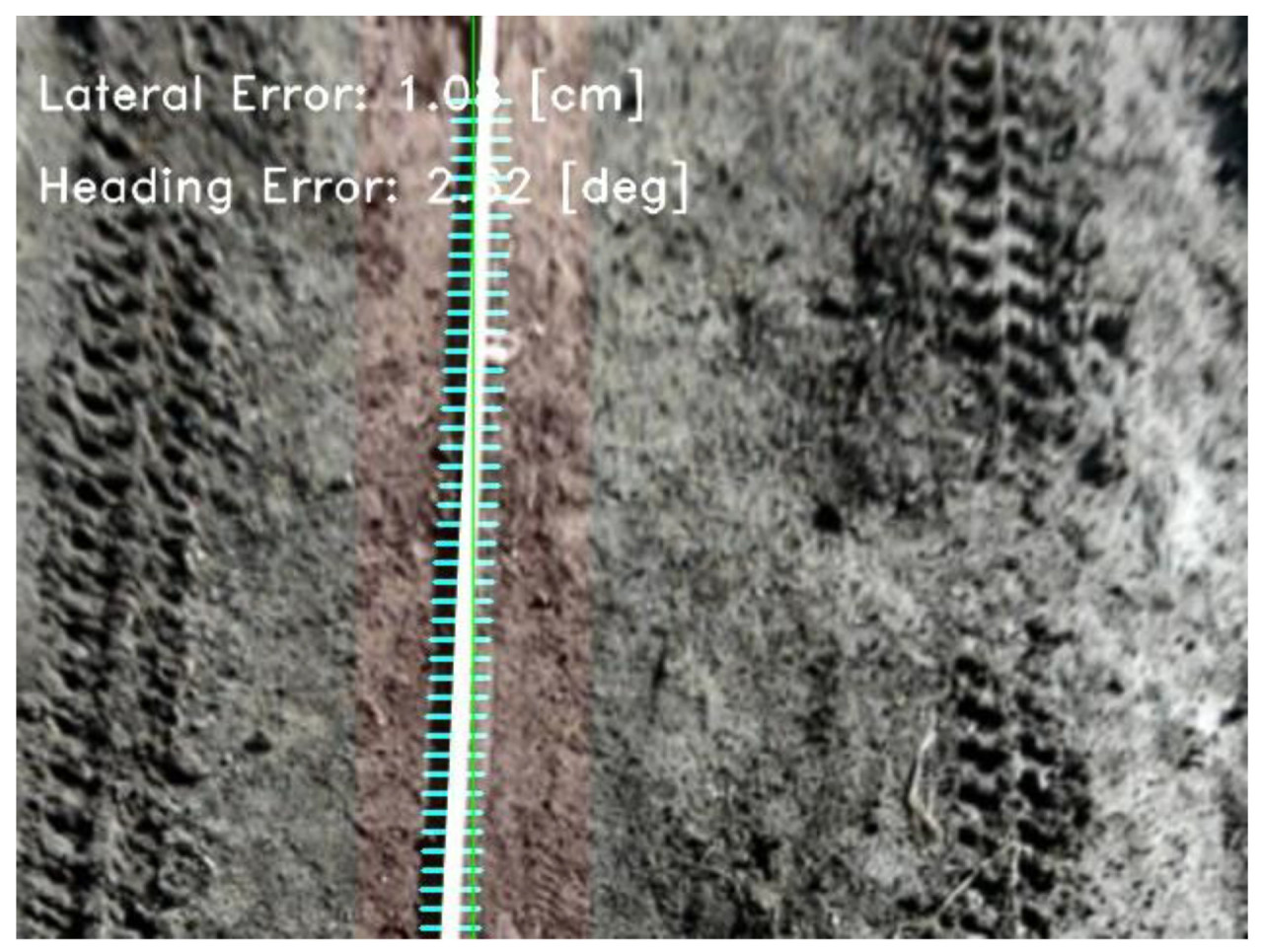

На Рисунке 15 показаны результаты распознавания ИИ для зеленого шланга во время работы. На Рисунке 16 демонстрируется точность слежения системы автономного вождения. Как показано на Рисунке 16, система поддерживала максимальную ошибку в пределах ±2 см при следовании по пути. Эти результаты свидетельствуют о том, что автономное вождение с использованием распознавания изображений ИИ на EV-гусеничнике возможно.

Рисунок 15. Распознавание изображений ИИ во время экспериментов (шланг).

Рисунок 16. График отслеживания движения (EV-гусеничник (авто) (шланг)).

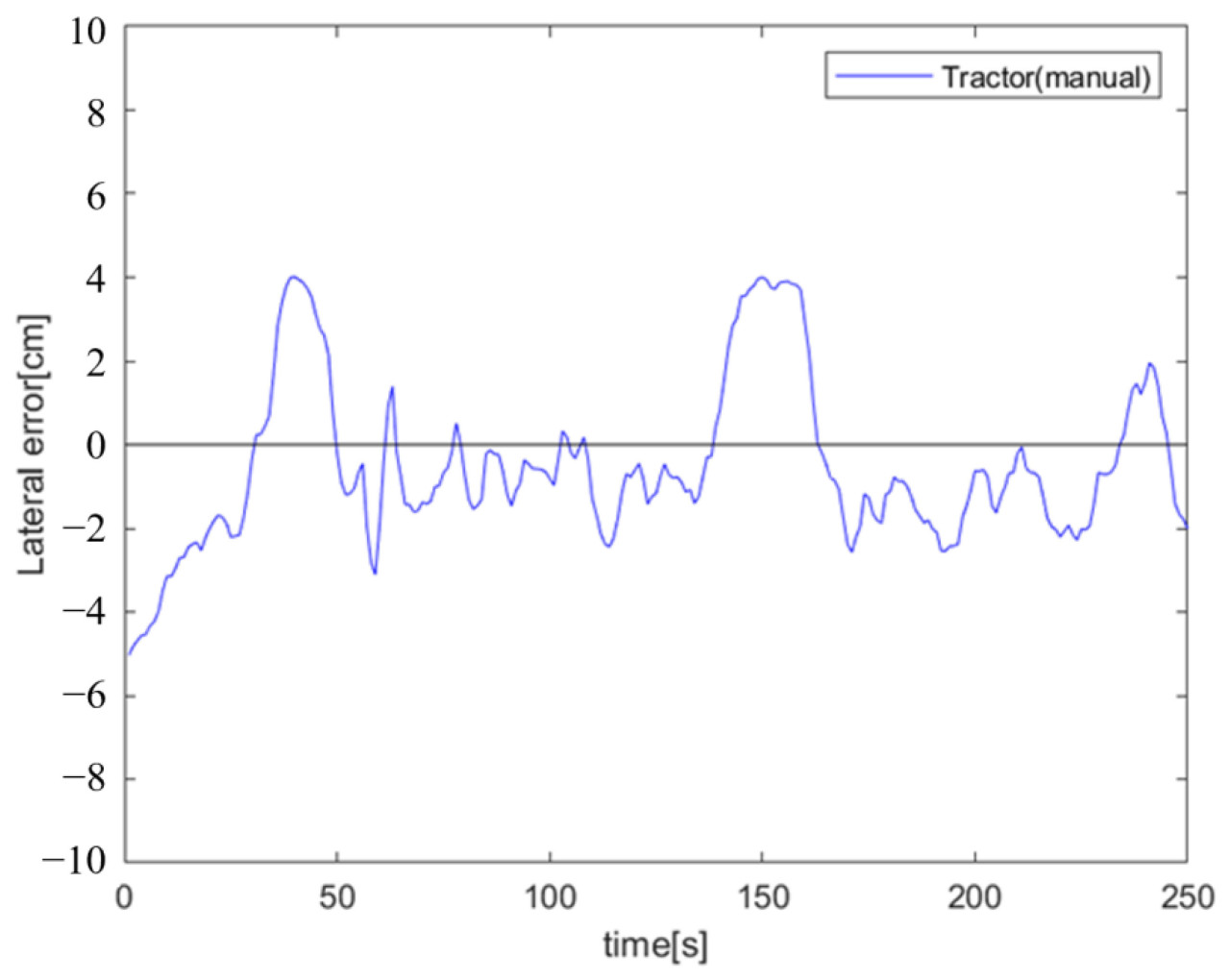

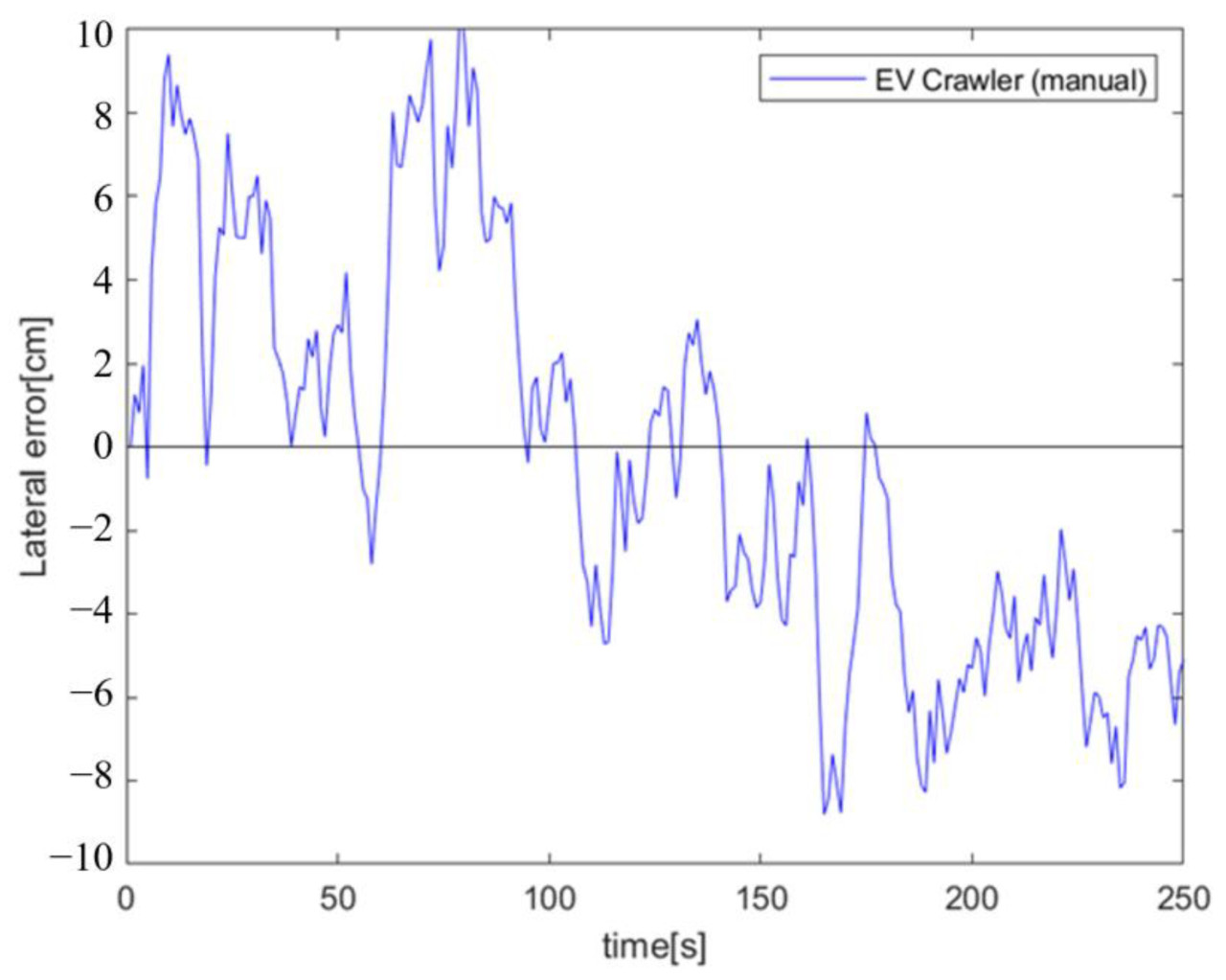

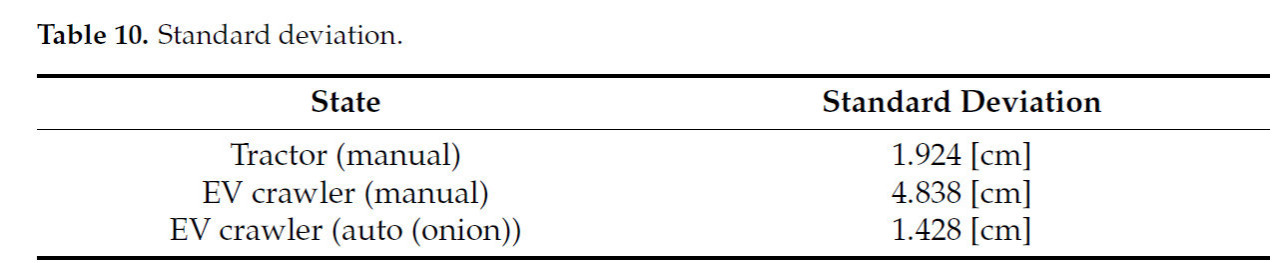

На Рисунке 17 представлены результаты распознавания ИИ для рядков лука во время работы. На Рисунке 18 иллюстрируется точность слежения трактора при ручном управлении, в то время как на Рисунке 19 показана точность слежения EV-гусеничника при ручном управлении. На Рисунке 20 демонстрируется точность слежения EV-гусеничника во время автономной работы. Таблица 10 перечисляет значения стандартного отклонения для каждого сценария. На основе данных на Рисунке 20 и в Таблице 10 очевидно, что точность слежения EV-гусеничника была наивысшей во время автономной работы.

Рисунок 17. Распознавание изображений ИИ во время экспериментов (лук).

Рисунок 18. График отслеживания движения (трактор (ручное управление)).

Рисунок 19. График отслеживания движения (EV-гусеничник (ручное управление)).

Рисунок 20. График отслеживания движения (EV-гусеничник (авто) (лук)).

Таблица 10. Стандартное отклонение.

Во время экспериментов система работала максимум примерно три часа в день, потребляя около 40% заряда батареи.

4. Обсуждение

Данная статья была сосредоточена на автоматизации прополочного культивирования и была направлена на разработку системы управления для робота для прополки на гусеничном ходу. Исследование охватило разработку EV-гусеничника, распознавание рядков культур с использованием ИИ, проектирование системы автоматического слежения за рядками культур и имитационные эксперименты по вождению на полевых путях. В части распознавания рядков культур с помощью ИИ был достигнут значительный прогресс в миниатюризации ПК для распознавания изображений. Дополнительно, было успешно достигнуто распознавание рядков культур в диагональных паттернах.

Робот, разработанный в этом исследовании, достиг высокого уровня точности (1,4 см) за счет комбинации технологии распознавания изображений на основе ИИ с электрической системой. Технология ИИ точно распознавала рядки культур в пределах поля и работала эффективно, не подвергаясь влиянию условий окружающей среды (освещения, изменений почвы или моделей роста растений). Это улучшение точности было обусловлено способностью ИИ динамически корректировать путь, принимая решения в реальном времени на основе сложных условий в поле. Дополнительно, внедрение электрической системы обеспечило большую реактивность и точность по сравнению с традиционными системами с двигателем внутреннего сгорания. Это позволяет стабильно работать и значительно повысит точность задач сельскохозяйственной автоматизации.

В отличие от этого, другие системы сельскохозяйственных роботов, такие как автономный трактор John Deere или роботы Naio Technologies (например, Oz), полагаются на технологию GPS и базовое распознавание изображений, обычно работая с точностью от примерно 2 до 5 см. Эти системы, основанные на GPS и камерах, особенно чувствительны к погодным и окружающим условиям. Например, туман, яркий солнечный свет или влажность почвы могут повлиять на точность датчиков, потенциально приводя к ошибкам идентификации. В отличие от этого, системы на основе ИИ могут более гибко обрабатывать эти вариации, достигая высоко точного распознавания культур и движения. Дальнейшие, электрическая система испытывает меньший механический износ и позволяет осуществлять точное управление, позволяя роботу работать стабильно и точно даже на сложном или неровном рельефе — преимущество по сравнению с другими системами.

5. Выводы

В этом исследовании мы разработали робот для прополки на гусеничном ходу, используемый на поле органического лука. Результаты экспериментов продемонстрировали превосходную точность навигации около 1,4 см. Точность автоматической навигации превзошла управление, осуществляемое человеком. Эта высокая точность может быть отнесена как к аппаратным, так и к системным компонентам. Конструкция гусеничного типа улучшила мобильность и стабильность на неровных сельскохозяйственных полях, в то время как переход на электрическую энергию улучшил реактивность и точность. Интеграция технологии распознавания изображений на основе ИИ дополнительно повысила точность, позволив роботу надежно идентифицировать рядки культур даже в сложных полевых условиях с меняющимся освещением, почвой и моделями роста.

Производительность робота подчеркивает потенциал комбинирования ИИ с электрическими системами для сельскохозяйственной автоматизации. Способность системы распознавать как прямые, так и диагональные рядки культур, одновременно минимизируя ошибки неправильного распознавания, позволила ей динамически корректировать свой путь в реальном времени. Эта возможность обеспечивает эффективное и точное выполнение задач в разнообразных средах, предлагая значительное улучшение по сравнению с традиционными системами.

Несмотря на эти достижения, существуют потенциальные проблемы, связанные с системой автономного вождения, которые требуют дальнейшего внимания. Одна потенциальная проблема — это способность модели ИИ точно различать рядки культур и другие элементы в поле, такие как зеленые прямые линии, которые могут быть ошибочно распознаны как рядки культур. Хотя мы кратко упомянули возможность такой ситуации, это остается проблемой, которая может повлиять на производительность робота, особенно на полях с различными моделями роста растений, тенями или похожими визуальными сигналами. Дальнейшие исследования должны быть сосредоточены на разработке обучающих моделей, которые являются более устойчивыми к таким мешающим элементам, потенциально включая дополнительные источники данных, такие как поведение растений, стадии роста и изменения окружающей среды с течением времени.

Дополнительно, хотя текущая система хорошо показала себя в экспериментальной среде, ее поведение может меняться в разных погодных условиях и средах. Например, экстремальная погода, такая как сильный дождь или высокий ветер, может повлиять на точность навигации робота или его способность надежно обнаруживать рядки культур. Чтобы решить эту проблему, в дальнейших исследованиях следует сравнить результаты автономного вождения в различных погодных условиях и полевых средах. Это помогло бы выявить любые факторы окружающей среды, которые влияют на производительность робота, и могло бы привести к улучшениям в адаптивности модели.

Другим ограничением текущего исследования является обработка роботом крупномасштабных, густых полей с культурами, где системы движения междурядий могут столкнуться с трудностями. Улучшение способности робота работать эффективно в таких средах, сохраняя при этом свой высокий уровень точности, будет ключевой областью дальнейшей разработки. Дальнейшие, хотя интеграция ИИ улучшила выполнение задач, способность модели адаптироваться к весьма разнообразному поведению культур и нерегулярной планировке полей требует дальнейшей доработки.

С точки зрения дальнейших направлений исследований, один из подходов может заключаться в расширении моделей обучения ИИ, чтобы больше сосредоточиться на моделях поведения культур с течением времени, а не полагаться исключительно на визуальное распознавание. Включая более широкий набор данных об окружающей среде и биологических данных, модель можно обучить делать более точные прогнозы в реальном времени. Дополнительно, изучение слияния данных с нескольких датчиков, комбинирующих визуальные, тепловые и, возможно, даже акустические данные, могло бы улучшить способность робота распознавать культуры в сложных условиях.

В заключение, хотя производительность робота демонстрирует значительный потенциал, существует несколько областей для дальнейших исследований и улучшений. К ним относятся уточнение модели ИИ для минимизации ошибок распознавания, повышение ее адаптивности к разнообразным средам и разработка более эффективных систем для крупномасштабных сельскохозяйственных задач. Решая эти ограничения, дальнейшие модели могут улучшить свою применимость и надежность в различных сельскохозяйственных условиях, поддерживая устойчивые методы земледелия и сокращая зависимость от ручного труда.

Ссылки

1. Statistics on Agricultural Labor Force in Japan (2023); Ministry of Agriculture, Forestry and Fisheries of Japan: Tokyo, Japan, 2023.

2. Boone, L.; Roldán-Ruiz, I.; Van Linden, V.; Muylle, H.; Dewulf, J. Environmental Sustainability of Conventional and Organic Farming: Accounting for Ecosystem Services in Life Cycle Assessment. Sci. Total Environ. 2019, 695, 133841. [Google Scholar] [CrossRef] [PubMed]

3. Lankoski, J.; Thiem, A. Linkages between Agricultural Policies, Productivity and Environmental Sustainability. Ecol. Econ. 2020, 178, 106809. [Google Scholar] [CrossRef]

4. Franco, S. Assessing the Environmental Sustainability of Local Agricultural Systems: How and Why. Curr. Res. Environ. Sustain. 2021, 3, 100028. [Google Scholar] [CrossRef]

5. Cachero-Martínez, S. Consumer Behaviour towards Organic Products: The Moderating Role of Environmental Concern. J. Risk Financ. Manag. 2020, 13, 330. [Google Scholar] [CrossRef]

6. Gamage, A.; Gangahagedara, R.; Gamage, J.; Jayasinghe, N.; Kodikara, N.; Suraweera, P.; Merah, O. Role of Organic Farming for Achieving Sustainability in Agriculture. Farming Syst. 2023, 1, 100005. [Google Scholar] [CrossRef]

7. Vahdanjoo, M.; Gislum, R.; Sørensen, C.A.G. Operational, Economic, and Environmental Assessment of an Agricultural Robot in Seeding and Weeding Operations. AgriEngineering 2023, 5, 299–324. [Google Scholar] [CrossRef]

8. Melander, B.; Lattanzi, B.; Pannacci, E. Intelligent versus Non-Intelligent Mechanical Intra-Row Weed Control in Transplanted Onion and Cabbage. Crop Prot. 2015, 72, 1–8. [Google Scholar] [CrossRef]

9. Oonisi, T.; Tanaka, S. Onion Work Handbook; Rural Culture Association: Kyoto, Japan, 2012. [Google Scholar]

10. Akazaki, S. Onion Encyclopedia; Rural Culture Association: Kyoto, Japan, 2019. [Google Scholar]

11. Maddonni, G.A.; Otegui, M.E.; Cirilo, A.G. Plant Population Density, Row Spacing and Hybrid Effects on Maize Canopy Architecture and Light Attenuation. Field Crops Res. 2001, 71, 183–193. [Google Scholar] [CrossRef]

12. Nakano, H.; Kawamoto, K.; Isida, K. Relationship between distance between rows and growth, yield, and downfall in soybeans. Rep. Chugoku Branch Crop Sci. Soc. Jpn. 1998, 35, P35–P36. [Google Scholar]

13. Roshanianfard, A.; Noguchi, N.; Okamoto, H.; Ishii, K. A Review of Autonomous Agricultural Vehicles (The Experience of Hokkaido University). J. Terramechanics 2020, 91, 155–183. [Google Scholar] [CrossRef]

14. Yao, Z.; Zhao, C.; Zhang, T. Agricultural Machinery Automatic Navigation Technology. iScience 2024, 27, 108714. [Google Scholar] [CrossRef] [PubMed]

15. Bo, H.; Liang, W.; Yuefeng, D.; Zhenghe, S.; Enrong, M.; Zhongxiang, Z. Design and Experiment on Integrated Proportional Control Valve of Automatic Steering System. IFAC-PapersOnLine 2018, 51, 389–396. [Google Scholar] [CrossRef]

16. An, G.; Zhong, Z.; Yang, S.; Yang, L.; Jin, C.; Du, J.; Yin, X. EASS: An Automatic Steering System for Agricultural Wheeled Vehicles Using Fuzzy Control. Comput. Electron. Agric. 2024, 217, 108544. [Google Scholar] [CrossRef]

17. Jing, Y.; Li, Q.; Ye, W.; Liu, G. Development of a GNSS/INS-Based Automatic Navigation Land Levelling System. Comput. Electron. Agric. 2023, 213, 108187. [Google Scholar] [CrossRef]

18. Saha, S.; Morita, T.; Ospina, R.; Noguchi, N. A Vision-Based Navigation System for an Agricultural Autonomous Tractor. IFAC-PapersOnLine 2022, 55, 48–53. [Google Scholar] [CrossRef]

19. Guerrero, J.M.; Ruz, J.J.; Pajares, G. Crop Rows and Weeds Detection in Maize Fields Applying a Computer Vision System Based on Geometry. Comput. Electron. Agric. 2017, 142, 461–472. [Google Scholar] [CrossRef]

20. Bentley, L.; Macinnes, J.; Bhadani, R.; Bose, T. A Pseudo-Derivative Method for Sliding Window Path Mapping in Robotics-Based Image Processing; CAT Vehicle Research Experience for Undergraduates: Tucson, AZ, USA, 2019. [Google Scholar] [CrossRef]

21. Yang, Y.; Zhou, Y.; Yue, X.; Zhang, G.; Wen, X.; Ma, B.; Xu, L.; Chen, L. Real-Time Detection of Crop Rows in Maize Fields Based on Autonomous Extraction of ROI. Expert Syst. Appl. 2023, 213, 118826. [Google Scholar] [CrossRef]

22. Zhang, S.; Liu, Y.; Xiong, K.; Tian, Y.; Du, Y.; Zhu, Z.; Du, M.; Zhai, Z. A Review of Vision-Based Crop Row Detection Method: Focusing on Field Ground Autonomous Navigation Operations. Comput. Electron. Agric. 2024, 222, 109086. [Google Scholar] [CrossRef]

23. Ruan, Z.; Chang, P.; Cui, S.; Luo, J.; Gao, R.; Su, Z. A Precise Crop Row Detection Algorithm in Complex Farmland for Unmanned Agricultural Machines. Biosyst. Eng. 2023, 232, 1–12. [Google Scholar] [CrossRef]

24. Lin, Y.-K.; Chen, S.-F. Development of Navigation System for Tea Field Machine Using Semantic Segmentation. IFAC-PapersOnLine 2019, 52, 108–113. [Google Scholar] [CrossRef]

25. Liu, F.; Yang, Y.; Zeng, Y.; Liu, Z. Bending Diagnosis of Rice Seedling Lines and Guidance Line Extraction of Automatic Weeding Equipment in Paddy Field. Mech. Syst. Signal Process. 2020, 142, 106791. [Google Scholar] [CrossRef]

26. Ponnambalam, V.R.; Bakken, M.; Moore, R.J.D.; Glenn Omholt Gjevestad, J.; Johan From, P. Autonomous Crop Row Guidance Using Adaptive Multi-ROI in Strawberry Fields. Sensors 2020, 20, 5249. [Google Scholar] [CrossRef]

27. Yang, R.; Zhai, Y.; Zhang, J.; Zhang, H.; Tian, G.; Zhang, J.; Huang, P.; Li, L. Potato Visual Navigation Line Detection Based on Deep Learning and Feature Midpoint Adaptation. Agriculture 2022, 12, 1363. [Google Scholar] [CrossRef]

28. Lyu, Z.; Lu, A.; Ma, Y. Improved YOLOv8-Seg Based on Multiscale Feature Fusion and Deformable Convolution for Weed Precision Segmentation. Appl. Sci. 2024, 14, 5002. [Google Scholar] [CrossRef]

29. Farokhi Soofi, A.; Manshadi, S.D.; Saucedo, A. Farm Electrification: A Road-Map to Decarbonize the Agriculture Sector. Electr. J. 2022, 35, 107076. [Google Scholar] [CrossRef]

30. Ghobadpour, A.; Monsalve, G.; Cardenas, A.; Mousazadeh, H. Off-Road Electric Vehicles and Autonomous Robots in Agricultural Sector: Trends, Challenges, and Opportunities. Vehicles 2022, 4, 843–864. [Google Scholar] [CrossRef]

31. Yamazaki, M. Electrification, Automated Driving Trends and Future Automotive Industry. J. Jpn. Soc. Colour Mater. 2018, 91, 351–354. [Google Scholar] [CrossRef]

32. Yamada, H.; Chida, Y.; Tanemura, M. Improvement of Linear Tracking Response of Two-Degree-of-Freedom Control of Discrete-Valued Driven Crawler. IFAC-PapersOnLine 2023, 56, 313–318. [Google Scholar] [CrossRef]

33. Takai, R.; Barawid, O.; Ishii, K.; Noguchi, N. Development of Crawler-Type Robot Tractor Based on GPS and IMU. IFAC Proc. Vol. 2010, 43, 151–156. [Google Scholar] [CrossRef]

Yang L, Kamata S, Hoshino Y, Liu Y, Tomioka C. Development of EV Crawler-Type Weeding Robot for Organic Onion. Agriculture. 2025; 15(1):2. https://doi.org/10.3390/agriculture15010002

Перевод статьи «Development of EV Crawler-Type Weeding Robot for Organic Onion» авторов ang L, Kamata S, Hoshino Y, Liu Y, Tomioka C., оригинал доступен по ссылке. Лицензия: CC BY. Изменения: переведено на русский язык

Комментарии (0)