Новый подход к оптимизации ключевых ограничений Azure Kinect DK для эффективного и точного измерения площади листьев

Площадь листьев кукурузы предоставляет ценную информацию о физиологических процессах, играя критически важную роль в селекции и оптимизации агропрактик. Устройство Azure Kinect DK обладает способностью в реальном времени захватывать и анализировать пространственно-структурные характеристики сельскохозяйственных культур. Однако его дальнейшее применение для измерения площади листьев кукурузы ограничено проблемой рассогласования RGB- и глубинных (depth) данных, а также недостаточной чувствительностью к детальным особенностям на уровне органов растений. В данном исследовании предложен новый подход для решения и оптимизации ограничений Azure Kinect DK с помощью мультимодального сопряжения RGB-D данных с целью улучшения фенотипирования культур на уровне органов.

Аннотация

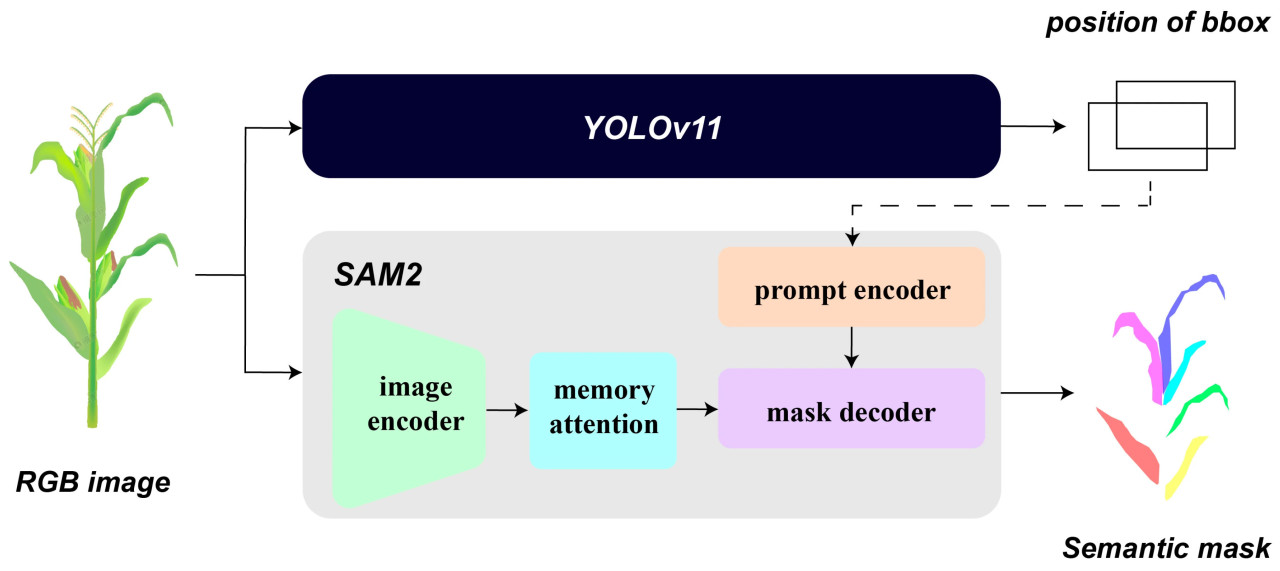

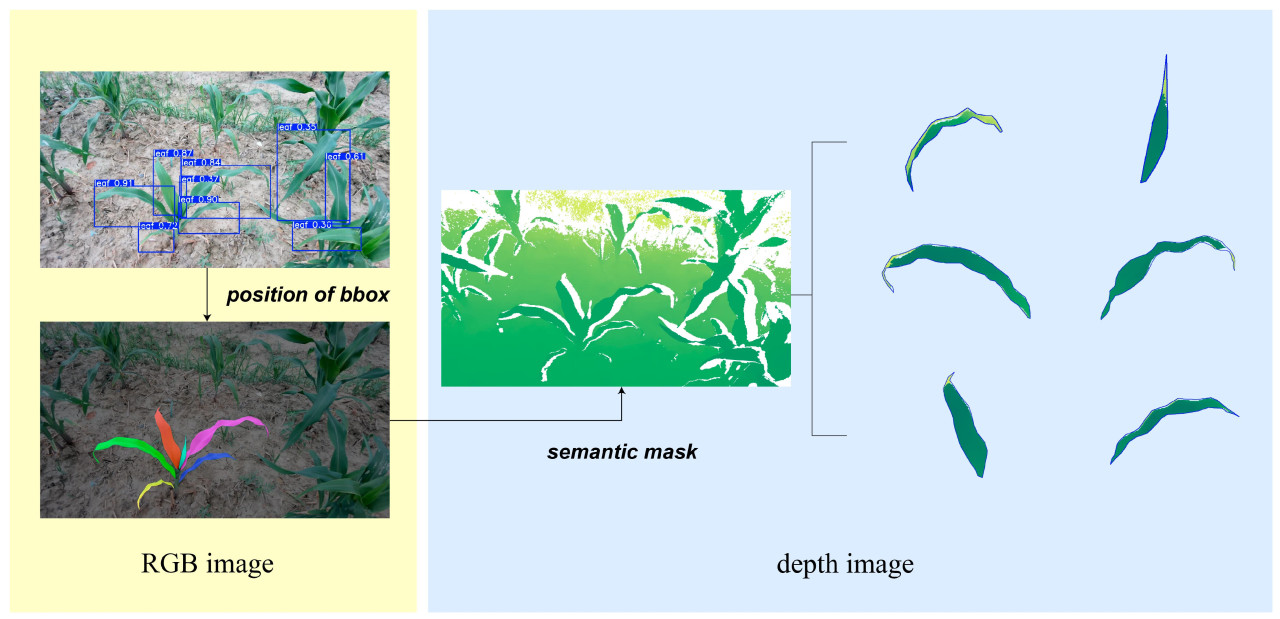

Для коррекции рассогласования RGB-D данных был разработан унифицированный метод повторной калибровки, обеспечивающий точное совмещение RGB- и depth-данных. Кроме того, предложен метод восстановления глубинных данных, управляемый семантической информацией, предназначенный для заполнения пустот (void pixels) и устранения артефактов ("летающих пикселей"), часто встречающихся в выходных данных Azure Kinect DK. Семантическая информация извлекается с использованием гибридной модели YOLOv11-SAM2, которая применяет подсказки на основе контролируемого распознавания объектов и передовые большие визуальные модели для достижения точного семантического анализа RGB-изображений с минимальным ручным вводом. Затем был разработан эффективный алгоритм восстановления глубины на основе фильтрации пикселей для заполнения пустот и устранения "летающих пикселей", а также для восстановления согласованных значений глубины с высокой достоверностью внутри семантических областей.

Валидация данного подхода путем измерения площади листьев в условиях реального поля кукурузы — где возникают такие сложности, как ограниченное рабочее пространство, стесненные углы обзора и изменчивость окружающей среды — продемонстрировала точность, близкую к лабораторной. На 60 образцах листьев кукурузы были достигнуты следующие метрики: средняя абсолютная процентная ошибка (MAPE) — 6,549%, среднеквадратичная ошибка (RMSE) — 4,114 см², средняя абсолютная ошибка (MAE) — 2,980 см² и коэффициент детерминации (R²) — 0,976.

Благодаря фокусировке вычислительных усилий на уровне изображений, а не непосредственно на трехмерных облаках точек, данный подход значительно повысил как эффективность, так и точность измерений при полном использовании возможностей Azure Kinect DK. Это делает его перспективным решением для высокопроизводительного 3D-фенотипирования сельскохозяйственных культур.

1. Введение

Площадь листа кукурузы тесно связана с ключевыми физиологическими процессами, такими как фотосинтез, чистая первичная продукция надземной части и накопление сухого вещества, служа ключевым индикатором реакции растения на такие факторы, как сорт, условия окружающей среды и практики выращивания. Показывая лежащие в основе роста и развития растения закономерности в различных условиях окружающей среды, этот параметр обладает значительным потенциалом для продвижения программ селекции кукурузы и содействия исследованиям в области функционально-структурных моделей растений (FSPMs) [1,2].

Традиционно сбор морфологических данных в значительной степени опирается на ручные измерения, которые требуют больших трудозатрат, отнимают много времени и подвержены ошибкам из-за различных измерительных инструментов и различий между операторами [3,4]. С развитием технологий сенсоров и компьютерного зрения, высокопроизводительные, высокоточные, неразрушающие методы измерения все чаще применяются в фенотипировании сельскохозяйственных культур. В частности, технологии трехмерного (3D) фенотипирования стали горячей темой исследований, предлагая комплексный анализ морфологических структур культур в пространственных измерениях. По сравнению с методами фенотипирования на основе изображений [5,6], 3D-техники обеспечивают измерения в истинном масштабе и позволяют проводить более детальный анализ топологической структуры культуры. Стоит отметить, что, хотя технологии сенсоров большего масштаба отлично справляются с захватом обширных данных о пологе культуры, их ограничения в разрешении и детализации на уровне органов ограничивают их полезность для задач высокоточного фенотипирования, таких как измерение площади листьев кукурузы. Поэтому данное исследование фокусируется на использовании технологий проксимального зондирования для детального анализа площади листьев кукурузы. Чтобы преодолеть ограниченную зону покрытия устройства, его интеграция с мобильной платформой или установка из нескольких устройств может обеспечить высокопроизводительный сбор данных при сохранении точности измерений.

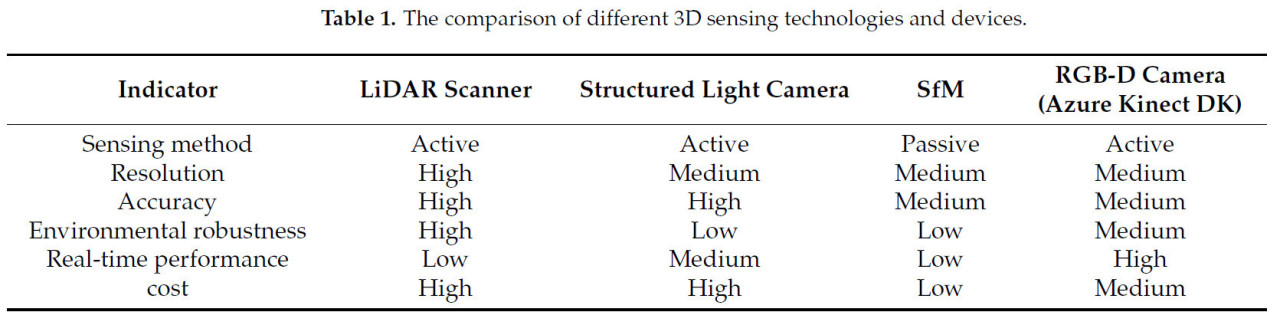

Сравнение различных технологий и устройств 3D-зондирования показано в Таблице 1. Технологии, такие как лидар-сканеры [7,8,9], камеры структурированного света и методы восстановления структуры по движению (SfM) [10,11], находят разнообразное применение в сельскохозяйственном контексте. Среди них RGB-D камеры выделяются благодаря возможности мгновенного захвата изображения, низкой стоимости и портативности, что делает их особенно выгодными для высокопроизводительного фенотипирования в полевых условиях [12]. Серия Kinect, разработанная Microsoft, приобрела значительную популярность, причем ее три поколения потребительских камер — Kinect V1, Kinect V2 и Azure Kinect DK — широко описаны и применяются в сельскохозяйственной практике. Kinect первого поколения использовал чувствительный к окружающей среде структурированный свет для измерения глубины, предлагая относительно низкое разрешение, подходящее для грубых оценок объектов. Например, Andújar и др. использовали Kinect V1 для оценки биомассы посевов цветной капусты [13]. Kinect V2, в котором была применена технология времени пролета (ToF), достиг улучшенных оценок глубины. Устройство продемонстрировало сильные возможности зондирования для полога листовых культур или рассады в сочетании с данными с нескольких ракурсов [14,15,16,17] и даже позволило проводить детальный анализ структур культуры, таких как скелет растения или листья [18,19]. Выпущенный в 2019 году, по сообщениям, новейшее поколение, Azure Kinect DK, превосходит другие потребительские RGB-D камеры с точки зрения точности глубины системы и качества разрешения [20], демонстрируя превосходящую производительность в динамических средах [21] и полу-наружных сценариях [22].

Таблица 1. Сравнение различных технологий и устройств 3D-зондирования.

Несмотря на широкое использование Azure Kinect DK, ограничения, вытекающие из аппаратных ограничений и изменчивости условий, ограничивают его применение для задач уровня органов, таких как измерение площади листа. Хотя измерение площади отдельного оторванного листа может достигать RMSE 4.05 см² [23] в лабораторных условиях, измерения для целых растений кукурузы в поле достигали RMSE в диапазоне от 11 до 41 см² [24,25]. Результаты свидетельствуют, что присущие RGB-D камере ограничения зондирования требуют применения дополнительных алгоритмов для повышения точности измерений, тем самым увеличивая его практическую полезность [26]. Хотя исследователи предлагали методы, такие как оптимизация облака точек [27,28] и завершение окклюзий [29,30] для повышения точности данных, этим подходам не хватает целевых решений, направленных на конкретные проблемы, создаваемые Azure Kinect DK при измерении площади листа, как обсуждается ниже.

Существует три значительные проблемы Azure Kinect DK для фенотипирования сельскохозяйственных культур, особенно для измерения площади листа. Во-первых, рассогласование между RGB и depth данными ограничивает полезность визуальных данных и ограничивает применение семантической информации, полученной из RGB, в последующих анализах. Во-вторых, качество depth данных недостаточно для детального восприятия мелких структур и краев, что часто приводит к пустым пикселям. В-третьих, у Azure Kinect DK отсутствует четкое разграничение вдоль краев объектов, где наличие летающих пикселей серьезно влияет на точность для приложений, полагающихся на анализ пространственной структуры. Следовательно, цели данного исследования заключаются в следующем: (1) предложить унифицированный метод повторной калибровки для коррекции рассогласования между RGB и depth данными Azure Kinect DK; (2) использовать семантические характеристики RGB данных для идентификации пустых пикселей и летающих пикселей в пределах листовых областей depth данных, которые влияют на 3D фенотипирование; (3) разработать процесс восстановления глубины для ремонта глубинной информации для этих ключевых пикселей; и (4) проверить предложенный подход в практических полевых применениях на кукурузе, в которых ограниченные рабочие пространства, стесненные точки обзора и неструктурированные изменения скорости ветра и условий освещения создают дополнительные проблемы для измерения площади листа, тем самым оптимизируя ключевые ограничения Azure Kinect DK. Эти оптимизации обладают значительным потенциалом для развития точного управления в сельском хозяйстве. Повышая точность и надежность измерения площади листа, предложенный метод способствует более точному мониторингу роста и здоровья сельскохозяйственных культур, позволяя принимать обоснованные решения по орошению, удобрению и борьбе с вредителями. Дополнительно, улучшенная способность Azure Kinect DK справляться с полевыми проблемами реального мира позволяет масштабировать и рентабельно внедрять технологии 3D фенотипирования в различных сельскохозяйственных сценариях, способствуя устойчивому и эффективному управлению сельскохозяйственными культурами.

2. Материалы и методы

2.1. Экспериментальная установка

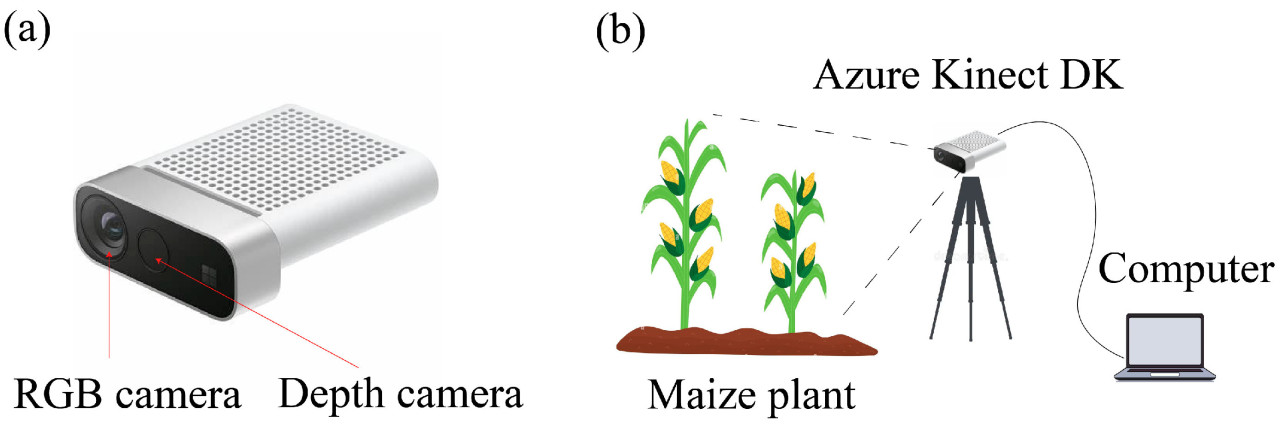

Microsoft Azure Kinect DK (как показано на Рисунке 1a) — это продвинутая RGB-D камера на основе технологии непрерывной волны ToF, с заявленным стандартным отклонением случайной ошибки ≤17 мм. Дополнительно, ее типичная системная ошибка составляет <11 мм +0.1% от измеренного расстояния при отсутствии многолучевой интерференции. Azure Kinect DK оснащена RGB камерой высокого разрешения с максимальным разрешением 12 МП и датчиком глубины с максимальным разрешением 1 МП. Работая на длине волны лазера 850 нм, датчик глубины определяет глубину путем измерения разности фаз между переданным и принятым сигналами, что позволяет одновременно получать depth-изображения и соответствующие им инфракрасные изображения. Исследование выбрало режим WFOV (широкий угол обзора) без биннинга для Azure Kinect DK для более близкого расстояния зондирования и улучшенного качества данных. В этом режиме угол обзора (FOV) RGB камеры составляет H 90° и V 59°, а разрешение и частота кадров RGB-изображения установлены на 3840 × 2160 при 5 fps. В то же время, FOV датчика глубины составляет H120° V120°, с разрешением depth-изображения и частотой кадров, установленными на 1024 × 1024 при 5 fps.

Рисунок 1. Экспериментальная установка. (a) Azure Kinect DK. (b) Экспериментальная установка.

Полевой эксперимент данного исследования проводился на сельскохозяйственном опытном поле Чжэцзянского университета, Ханчжоу, Китай. Данные растений кукурузы были собраны в августе 2024 года, включая RGB-изображения, depth-изображения и истинные значения площадей листьев. Чтобы удовлетворить потребность в высокопроизводительном и быстром фенотипировании в поле, в этом исследовании использовался однокадровый подход с использованием Azure Kinect DK, обеспечивая максимальное экспонирование всей площади листа в пределах поля зрения. В эксперименте RGB-D камера была подключена к мобильной рабочей станции через кабель и установлена на штатив или удерживалась в руках, как показано на Рисунке 1b. Данные собирались и сохранялись программой, разработанной на основе Azure Kinect SDK 1.4.

Были тщательно отобраны пятнадцать растений кукурузы с общим количеством 60 образцов листьев, чтобы гарантировать, что набор данных отражает разнообразие посевов кукурузы в реальных сельскохозяйственных условиях. Критерии отбора включали следующее:

· Разнообразие стадий роста: Образцы были выбраны с различных стадий роста, от V1 (вегетативная стадия, когда присутствует первый воротничок листа) до V7 (вегетативная стадия, когда присутствует семь воротничков листа);

· Изменчивость размера растений: Были включены растения кукурузы с различной высотой (от ~20 см до ~45 см) и размерами листьев (от ~10 см² до ~100 см²), чтобы отразить естественную изменчивость;

· Пространственное распределение: Растения из разных мест в пределах поля были отобраны, чтобы учесть вариации, вызванные плодородием почвы, затенением и другими факторами.

Во время сбора данных условия окружающей среды контролировались для обеспечения последовательности и моделирования проблем реального поля. Температура окружающей среды колебалась от 25 °C до 35 °C, а скорость ветра в среднем составляла 2–5 м/с. Чтобы минимизировать влияние переменных окружающей среды, сбор данных проводился ранним утром или поздним вечером, когда солнечный свет был мягче, уменьшая блики и эффекты теней на изображениях.

Истинные значения площадей листьев были получены путем разрезания каждого листа кукурузы на отдельные части, которые затем немедленно расправлялись и сканировались с помощью 2D сканера. Дополнительно, было собрано 100 RGB-изображений растений кукурузы для обучения сети извлечения семантической информации, как обсуждается в Разделе 2.3. Все задачи в этом исследовании выполнялись на аппаратной платформе, оснащенной процессором AMD Ryzen 7 3700X 8-Core CPU, оперативной памятью 32 ГБ и графическим процессором NVIDIA GTX 1080Ti.

2.2. Описание проблемы

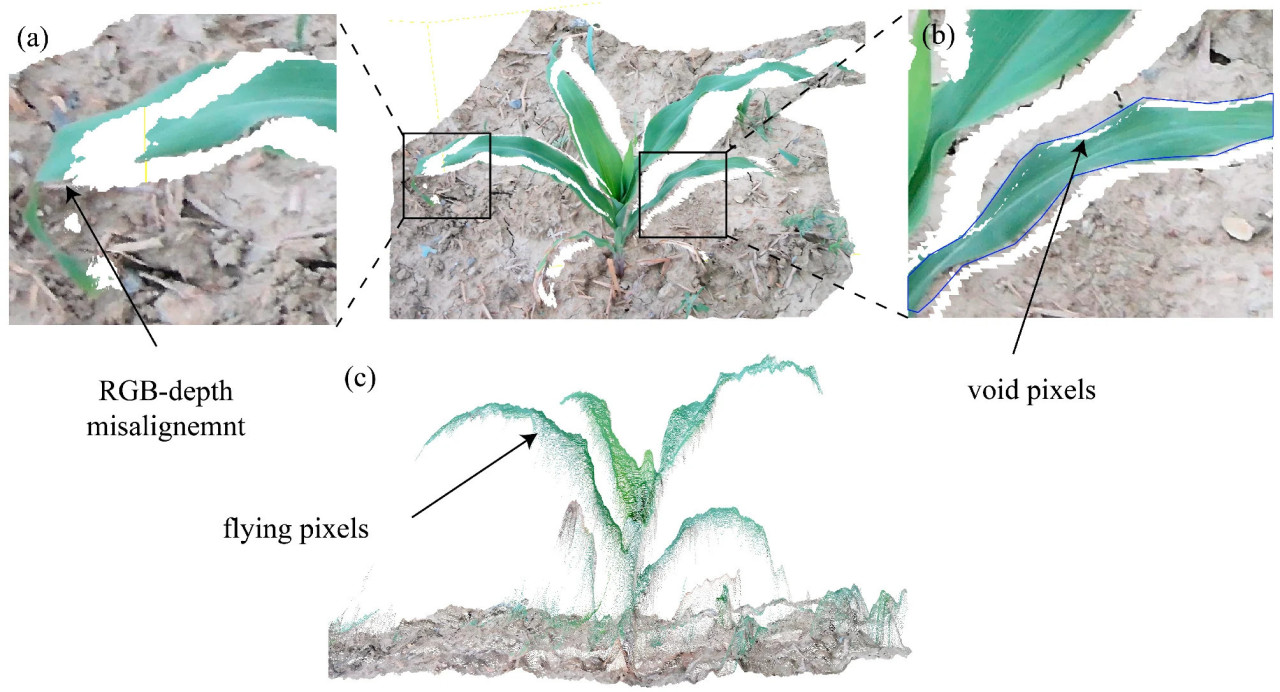

Следуя экспериментальной установке, описанной в Разделе 2.1, RGB-D данные, генерируемые Azure Kinect DK, представляют три основные проблемы, влияющие на последующую обработку и применения. Во-первых, поскольку RGB камера и датчик глубины являются гетерогенными камерами, интегрированными в Azure Kinect DK, их данные требуют совмещения для дальнейших применений. Однако была обнаружена низкая точность совмещения при использовании параметров калибровки перед отправкой, особенно для объектов на близком расстоянии [31]. Как показано на Рисунке 2a, зеленые области, которые изначально принадлежали листу, были неправильно спроецированы на землю. Во-вторых, из-за ограничений возможностей зондирования Azure Kinect DK, depth данные не могут представлять объекты с отражениями поверхности, окклюзиями или находящиеся вне диапазона измерений, что приводит к пустым пикселям [32], как показано на Рисунке 2b, где синяя линия указывает на целевую область. В-третьих, вдоль краев объекта измерения глубины подвержены влиянию смешанных отражений как от объекта, так и от фона, что приводит к снижению соотношения сигнал-шум. Это вмешательство создает каскадные летающие пиксели между объектом и фоном [33,34], как показано на Рисунке 2c. Для решения этих проблем были применены следующие методы, чтобы смягчить их эффекты.

Рисунок 2. Ключевые ограничения данных, генерируемых Azure Kinect DK. (a) Фронтальный вид облака точек Azure Kinect DK, показывающий рассогласование RGB–depth. (b) Фронтальный вид облака точек, показывающий пустые пиксели внутри листовой области. (c) Вид сбоку облака точек, показывающий летающие пиксели вокруг краев листа.

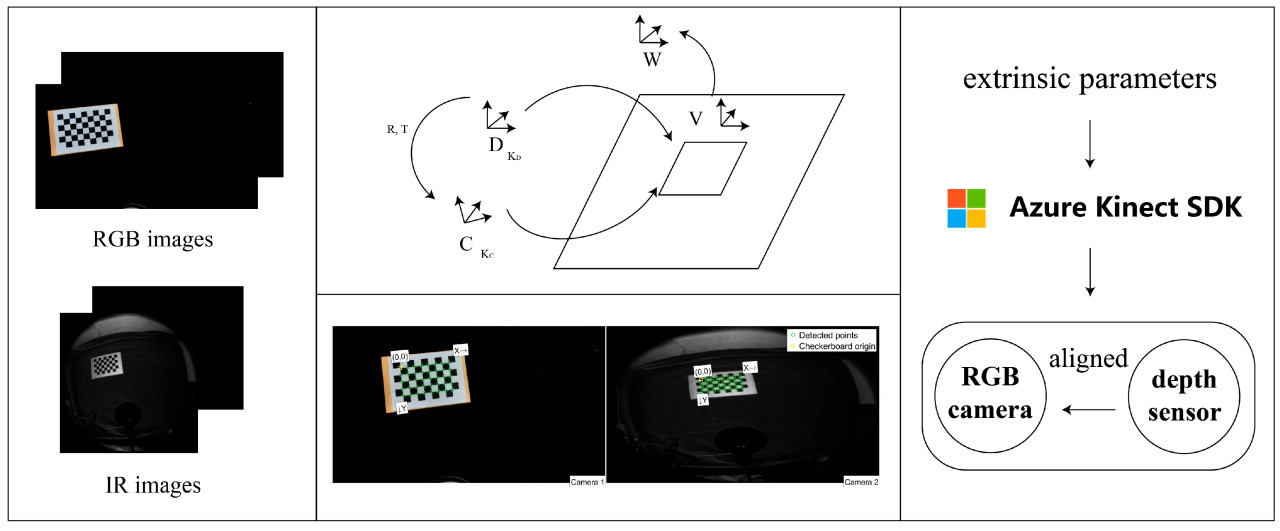

2.3. Повторная калибровка RGB-D камеры

Поскольку алгоритм полагался на точное совмещение RGB и depth изображений, в данном исследовании был проведен метод повторной калибровки на основе шахматной доски для внешних параметров RGB и depth камер. Как упоминалось в Разделе 2.1, хотя датчик глубины не чувствителен к оптическим данным, его исходные инфракрасные изображения могут быть использованы для обнаружения угловых точек шахматной доски [35]. В качестве калибровочной мишени использовалась черно-белая шахматная доска размером 15 см × 10 см с сеткой 9 × 6. Размещенная в диапазоне от 20 см до 1 м от RGB-D камеры, шахматная доска перемещалась и поворачивалась в различных положениях поля зрения, в результате чего был получен набор из 20 пар RGB и инфракрасных изображений. Калибровка выполнялась с помощью инструмента Stereo Camera Calibrator в MATLAB для извлечения внешних параметров как для RGB, так и для depth камер. Depth-изображение было совмещено с RGB-изображением с помощью последующего преобразования координат [36], как показано на Рисунке 3. Стоит отметить, что повторную калибровку необходимо выполнить только один раз. Последующие применения могут использовать внешние параметры, полученные из этой повторной калибровки, для получения стабильно совмещенных RGB–depth результатов.

Рисунок 3. Стратегия повторной калибровки.

2.4. Восстановление depth-изображения, управляемое семантической информацией

Прямое восстановление пустых пикселей и летающих пикселей по всему depth-изображению является сложной задачей и обеспечивает ограниченную защиту для листовых областей. С растущим развитием компьютерного зрения, особенно больших визуальных моделей (LMs), в настоящее время слияние RGB-изображений и depth данных показывает растущий потенциал благодаря способности визуальных моделей показывать семантическую информацию как в RGB, так и в depth данных. Исследование предложило метод восстановления глубины, управляемый семантической информацией, для ремонта пустых пикселей и летающих пикселей в листовой области, используя мультимодальное сопряжение данных RGB-D камеры для улучшения глубинной информации с семантическим руководством на уровне органов.

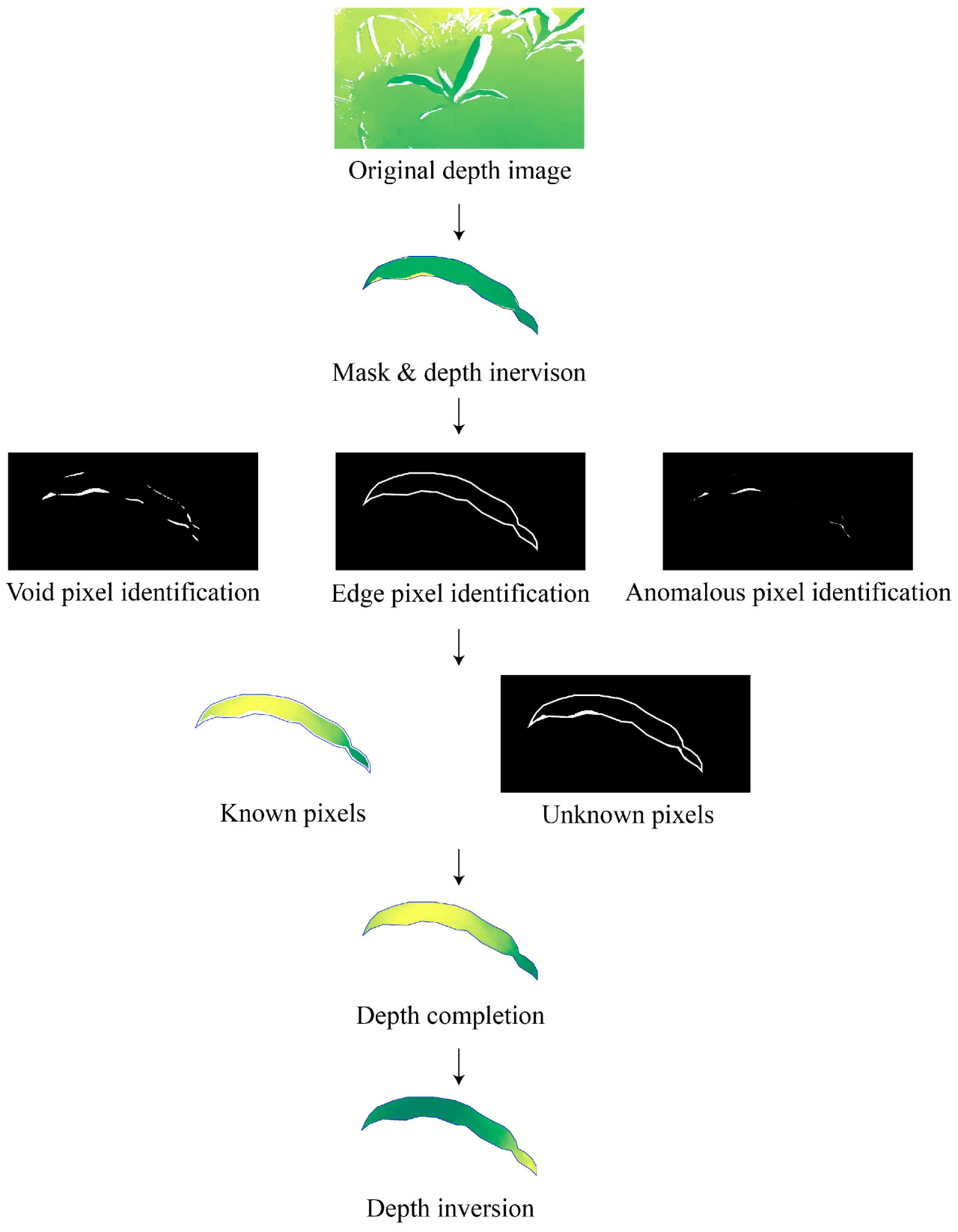

Чтобы извлечь семантическую информацию листьев на RGB-изображениях, исследование разработало структуру сегментации листьев, YOLOv11-SAM2, которая использует подсказки контролируемого распознавания объектов и высокопроизводительные визуальные LMs для достижения высокоточного семантического анализа RGB-изображений с минимальными ручными усилиями. YOLO11 — это передовая модель обнаружения объектов, которая основывается на успехе предыдущих версий YOLO. Чтобы минимизировать ручные аннотации, обеспечивая при этом высокую производительность и обобщаемость, мы использовали набор данных PlantDoc [37] для предварительного обучения YOLOv11 и дополнительно аннотировали 100 изображений листьев кукурузы (как упоминалось в Разделе 2.1) ограничивающими рамками для тонкой настройки модели для улучшенного обнаружения в конкретных сценариях. Это исследование приняло модель YOLOv11-M для обучения и вывода, используя оптимизатор AdamW с начальной скоростью обучения 0.001, моментом, установленным на 0.937, и стратегией затухания с шагом. Модель обучалась в течение 100 эпох с размером пакета 8. Методы аугментации данных включали горизонтальное отражение (вероятность 0.5), случайное масштабирование (диапазон от 0.5 до 1.5), трансляцию (до 10% размера изображения), корректировки HSV (hsv_h = 0.015, hsv_s = 0.7 и hsv_v = 0.4) и случайное стирание (вероятность 0.4).

Segment Anything Model 2 (SAM2) — это визуальная LM для интерактивной сегментации изображений, которая возвращает эффективные маски из любой заданной подсказки сегментации [38]. После того как обученная модель YOLOv11 проводила вывод на новых изображениях, положение ограничивающей рамки каждого обнаруженного листа затем передавалось в качестве подсказки в модель SAM2. В итоге, высокоточные маски листьев были получены из модели SAM2. Поскольку точность результатов сегментации должна быть гарантирована, исследование выбрало модель sam2_hiera_large в качестве модели для вывода. Вся структура YOLOv11-SAM2 показана на Рисунке 4.

Рисунок 4. Структура YOLOv11-SAM2.

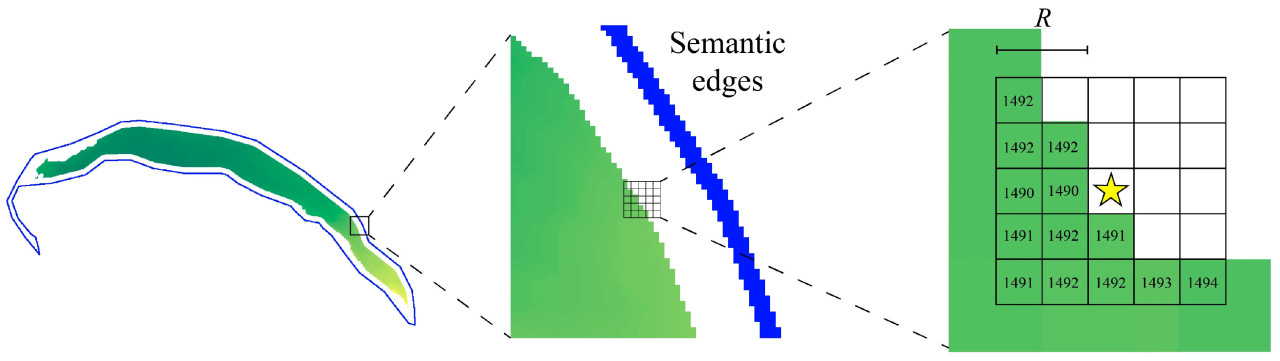

После вывода моделью YOLOv11-SAM2 семантические результаты листьев кукурузы применялись к совмещенному depth-изображению в качестве масок, соответственно. Чтобы идентифицировать и восстановить пустые пиксели и летающие пиксели листовых областей в depth-изображении, это исследование предложило метод восстановления depth-изображения путем интеграции инновационных техник, адаптированных для фенотипирования на уровне органов. Ключевые инновации включают инверсию глубины для приоритизации областей с высокой достоверностью, обнаружение краев на основе топологии для адаптивного восстановления скручивания и складывания листьев, и фильтрацию по гистограмме для динамического устранения аномальных пикселей. Подход фильтрации пикселей алгоритма обеспечивает точное завершение, используя пространственные отношения между известными и неизвестными пикселями, в то время как завершающие этапы улучшения повышают непрерывность краев. Эти усовершенствования значительно улучшают качество depth-изображения, обеспечивая надежные и достоверные измерения даже в сложных морфологических условиях. Более того, как неконтролируемый алгоритм обработки изображений, этот метод предлагает более высокую эффективность и лучшую адаптируемость к различным сценариям, а также устраняет необходимость в обширных данных для обучения по сравнению с методами восстановления на основе глубокого обучения. Предложенный метод был реализован с помощью шести шагов алгоритма, описанных ниже.

(1) Инверсия глубины. Azure Kinect DK сохраняет depth-изображение в 16-битном формате. Объекты, находящиеся дальше от RGB-D камеры, имели более высокие значения в depth-изображении, но с меньшей достоверностью. Чтобы предотвратить возможность операций дилатации и завершения позволить пикселям с меньшей достоверностью перезаписать пиксели с более высокой достоверностью, depth-изображение сначала подвергается инверсии глубины, при которой объекты, находящиеся ближе к камере, имеют более высокие значения в карте глубины. После инверсии глубины значение depth-изображения было следующим:

где 𝐷max — максимально допустимое значение для depth-изображения.

(2) Идентификация пустых пикселей. Значения глубины пикселей вне маски были установлены в 0, а затем пустые пиксели внутри маски исключительно обладают значением 𝐷max. Эти пиксели были извлечены как области, подлежащие восстановлению.

(3) Идентификация краевых пикселей на основе скелета. Чтобы устранить летающие пиксели на краю листа, был принят адаптивный метод идентификации краевых пикселей на основе ширины листа. Из-за возможного скручивания или складывания листьев мы сначала извлекли скелет листа с помощью алгоритма утоньшения Zhang–Suen из маски. Затем средняя ширина листа была рассчитана с использованием кратчайшего евклидова расстояния от каждой точки на скелете до края листа. Пиксели в пределах определенного процента от ширины листа от края листа были идентифицированы как области, подлежащие восстановлению.

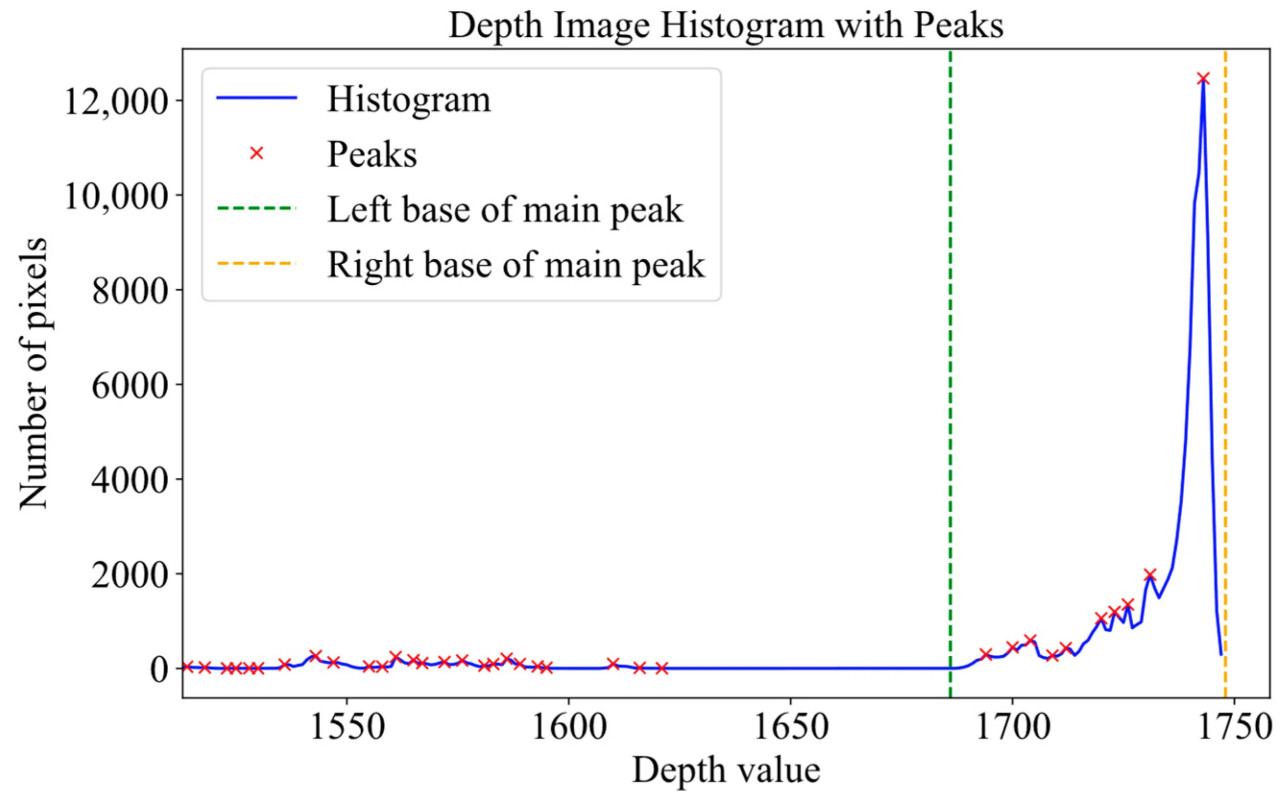

(4) Идентификация аномальных пикселей на основе гистограммы. Хотя вышеупомянутые шаги удалили большинство нежелательных пикселей, некоторые аномальные летающие пиксели все еще оставались необнаруженными. Поэтому мы дополнительно применили фильтрацию по гистограмме, чтобы устранить эти аномальные пиксели. Основной пик в гистограмме depth-изображения с наибольшей выраженностью был идентифицирован, вместе с его левым и правым основаниями. Эти два значения были установлены в качестве верхнего и нижнего порогов для depth-изображения, позволяя идентифицировать аномальные пиксели, значения которых выходят за пределы основного пика.

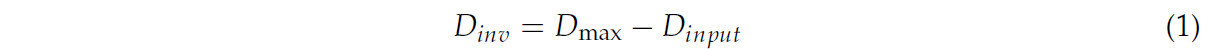

(5) Завершение глубины на основе фильтра пикселей. Для удобства пустые пиксели, краевые пиксели и аномальные пиксели в совокупности называются неизвестными пикселями (UPs), в то время как другие пиксели внутри листовой области обозначаются как известные пиксели (KPs). Сначала была рассчитана матрица расстояний, которая представляла расстояние от UPs до KPs, приоритезируя UPs, которые были ближе к KPs. Затем соседние пиксели каждого UP в пределах диапазона 𝑅 извлекались по порядку. Если количество ненулевых соседних пикселей превышало порог ∂, значение глубины неизвестного пикселя могло быть назначено как среднее значение глубины всех ненулевых соседних пикселей, как показано на Рисунке 5. Мы продолжали этот процесс, пока все UPs не были завершены. Этот метод завершения глубины использовал подход среднего значения, чтобы полностью использовать кумулятивный эффект соседних пикселей, гарантируя, что генерировались только значения глубины, большие, чем в окружающих пикселях, тем самым обеспечивая более высокий уровень достоверности в завершенных значениях глубины.

Рисунок 5. Алгоритм завершения глубины на основе фильтра пикселей (Звезда на рисунке представляет пиксель, который в настоящее время восстанавливается).

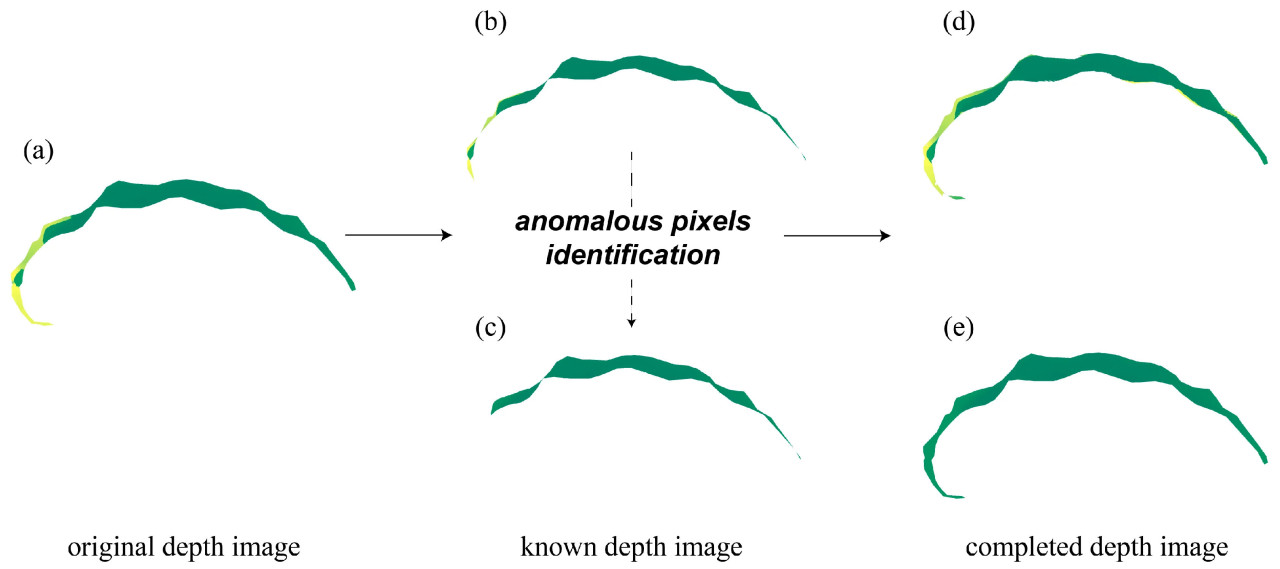

(6) Инверсия глубины. Ядро в форме ромба 5 × 5 использовалось для проведения небольшой дилатации на depth-изображении [39], улучшая взаимосвязь между краями и пикселями с высокой достоверностью в известных областях. Затем depth-изображение снова ограничивалось с использованием семантической маски и подвергалось инверсии глубины, что в итоге давало завершенное depth-изображение. Вся процедура восстановления depth-изображения показана на Рисунке 6.

Рисунок 6. Процедура восстановления depth-изображения.

2.5. Измерение площади листа

Чтобы получить измерения площади листа, depth-изображение необходимо было преобразовать в трехмерное пространство, за которым следовали постобработки, такие как построение сетки, сглаживание и другие шаги. Цветное изображение и совмещенное depth-изображение могли быть преобразованы в облако точек следующим образом:

где 𝑋, 𝑌, и 𝑍 — представление пикселей, отображенных в координаты в трехмерном пространстве. 𝑍 — значение глубины пикселя в depth-изображении. 𝑢 и 𝑣 относятся к строке и столбцу пикселя. Аналогично, RGB информация того же пикселя присоединяется к точке (𝑋,𝑌,𝑍).

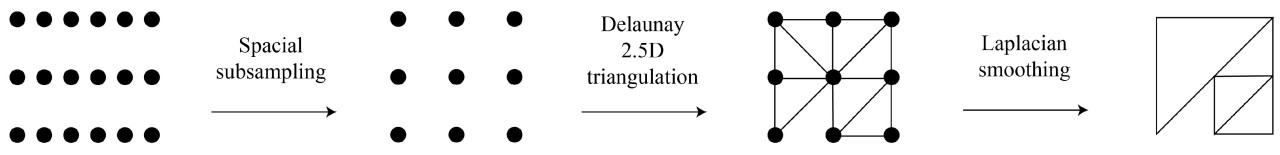

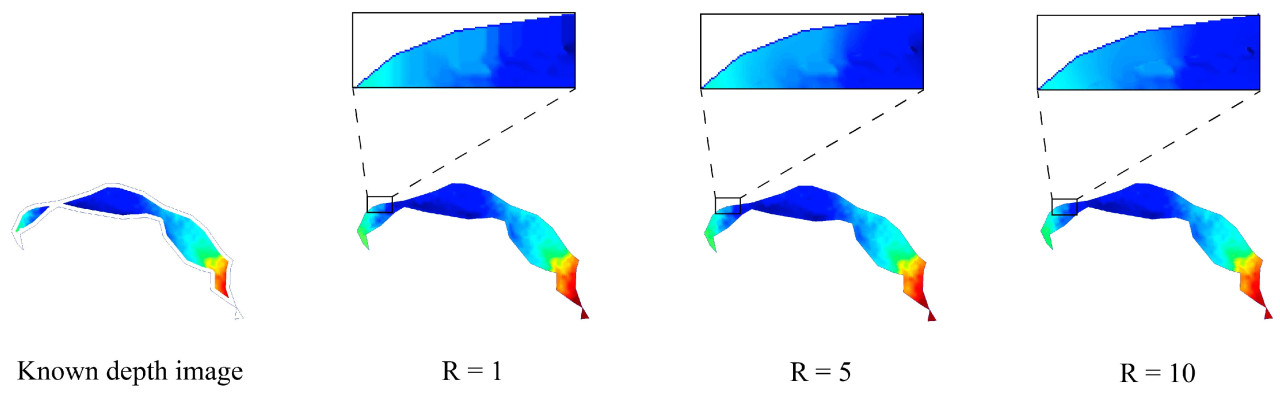

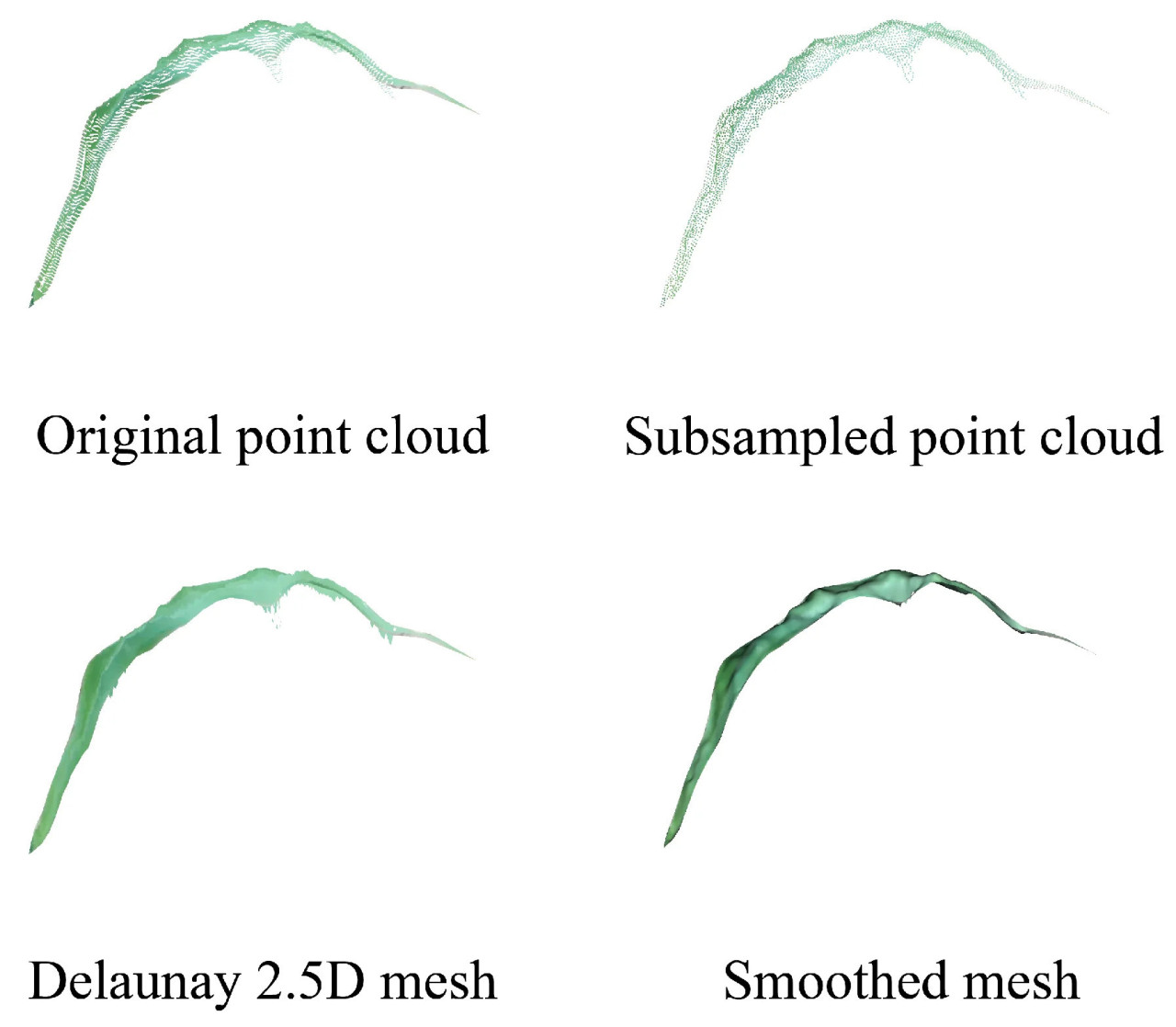

Azure Kinect DK имеет разрешение 1 мм по оси Z. При настройках сэмплирования, описанных в Разделе 2.1, разрешения по оси X и оси Y были чрезмерно высокими, что заставляло облако точек иметь ступенчатую форму. Поскольку поверхность листа имела изогнутую форму, прямое измерение площади привело бы к значительным ошибкам. Поэтому сначала была реализована пространственная подвыборка, чтобы гарантировать, что облако точек было равномерно распределено с шагом 1 мм. Впоследствии к облаку точек была применена триангуляция Delaunay 2.5D для получения грубой сетчатой модели листа. Максимальная длина ребра треугольников была ограничена 0.006 м. Затем метод Лапласова сглаживания был применен к сетчатой модели, с 10 итерациями и коэффициентом сглаживания, установленным на 0.2. Площадь листа, наконец, могла быть измерена путем расчета общей площади поверхности сетки. Процесс постобработки 3D данных для измерения площади листа показан на Рисунке 7.

Рисунок 7. Пример процесса построения сетки 3D данных для измерения площади листа.

2.6. Оценка точности измерения площади листа

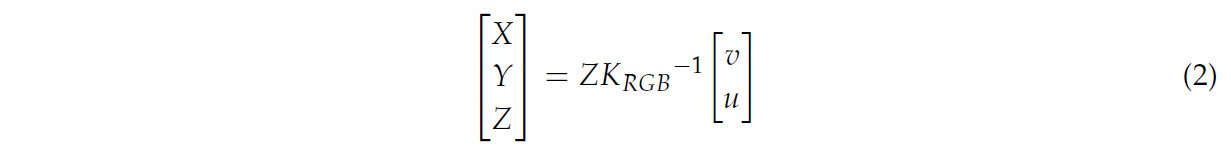

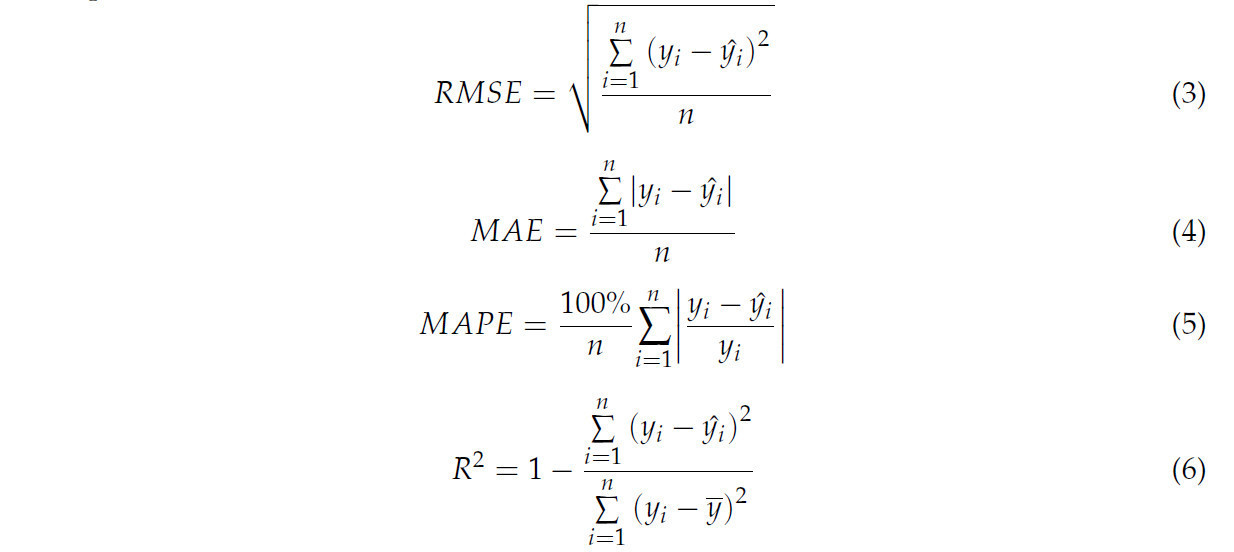

В этом исследовании были приняты четыре показателя для оценки точности измерения площади листа. Среднеквадратичная ошибка (RMSE, Уравнение (3)) отражает общую величину ошибки, в то время как средняя абсолютная ошибка (MAE, Уравнение (4)) представляет среднюю абсолютную ошибку. Средняя абсолютная процентная ошибка (MAPE, Уравнение (5)) выделяет относительную точность в процентах, и коэффициент детерминации (R-квадрат (R2), Уравнение (6)) измеряет, насколько хорошо прогнозы соответствуют фактическим значениям, причем более высокие значения указывают на лучшую производительность.

где 𝑦𝑖̂ — 𝑖-ое смоделированное значение, 𝑦𝑖 — 𝑖-ое истинное значение, и 𝑦̲ — среднее значение истинных значений.

3. Результаты и обсуждения

3.1. Результат повторной калибровки

Полученные из 20 наборов RGB и ИК изображений, точность репроекции внешних параметров RGB камеры и датчика глубины составила 0.975 пикселей. Чтобы облегчить наблюдение за совмещением, мы извлекли 3D облако точек конкретного растения кукурузы, сгенерированное из RGB и совмещенных depth-изображений, для визуализации. Как показано на Рисунке 8c, облако точек до повторной калибровки демонстрировало заметное рассогласование, с некоторым бронзовым цветом, изначально принадлежащим земле, отображенным на лист. Напротив, облако точек после повторной калибровки (Рисунок 8d) обладало последовательным цветом, что указывало на то, что depth-изображение было тесно совмещено с RGB данными. Это повторно откалиброванное совмещение устанавливает надежную основу для использования RGB семантической информации для руководства восстановлением карты глубины в этом исследовании.

Рисунок 8. Облако точек растения кукурузы. (a) Полное облако точек до повторной калибровки. (b) Полное облако точек после повторной калибровки. (c) Облако точек конкретного растения кукурузы до повторной калибровки. (d) Облако точек конкретного растения кукурузы после повторной калибровки.

3.2. Производительность восстановления глубины, управляемого семантической информацией

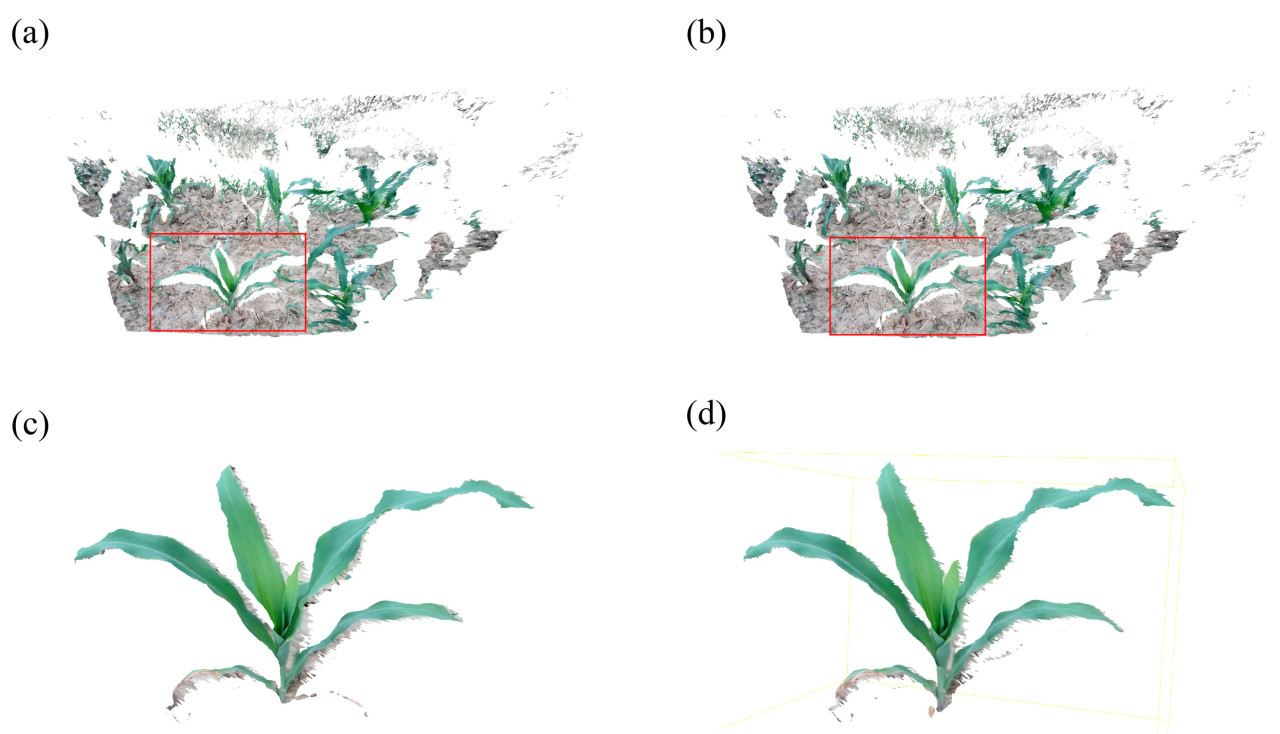

Желтая часть Рисунка 9 иллюстрирует результат извлечения семантической информации YOLOV11-SAM2. Мы видим, что обученная модель YOLOv11 точно обнаружила все листья растения кукурузы, расположенного в центре обзора изображения, настроенная и направленная на основе набора данных для обучения, чтобы фокусироваться на областях с высококачественными depth данными. Хотя у модели были возможности обнаруживать листья других растений кукурузы, позиции ограничивающих рамок только от основного растения кукурузы передавались в качестве подсказки модели SAM2. Результат сегментации модели SAM2 демонстрирует, что, поддерживаемый мощным механизмом данных, LMs могут достигать генерации семантических масок без обучения и с высокой точностью. Семантические маски каждого листа применялись на depth-изображении отдельно для последующего восстановления глубины, как показано в синей части Рисунка 9.

Рисунок 9. Результат извлечения семантической информации YOLOV11-SAM2 и depth-изображение экземпляров листьев.

Для визуализации особенностей depth-изображения мы сопоставили значения depth-изображения с диапазоном 0–255 и использовали цветовую карту Summer (от желтого к зеленому), чтобы четко различать значения глубины. Можно наблюдать, что UPs, включая пустые пиксели, краевые пиксели и аномальные пиксели, были постепенно идентифицированы методом идентификации пикселей, разработанным в этом исследовании.

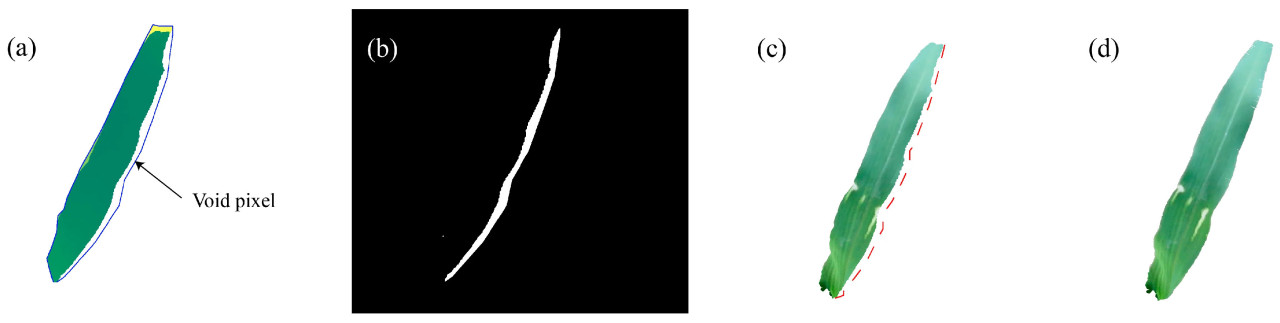

Идентификация пустых пикселей может извлечь большинство невоспринятых листовых областей из исходной карты глубины, максимизируя восстановление площади листа. Как иллюстрировано на Рисунке 10a, синяя линия представляет контур семантической маски листа, с белой областью внутри этого контура, наглядно показывающей присутствие пустых пикселей. Рисунок 10b демонстрирует, что все пустые пиксели в листовой области были точно идентифицированы. После восстановления глубины сгенерированное облако точек на Рисунке 10d эффективно восстановило области, принадлежащие листу. По сравнению с исходным облаком точек на Рисунке 10c, произошло значительное увеличение на правой стороне листа.

Рисунок 10. Идентификация пустых пикселей. (a) Исходное depth-изображение листа кукурузы. (b) Идентифицированные пустые пиксели. (c) Исходное облако точек листа кукурузы. (d) Восстановленное облако точек листа кукурузы.

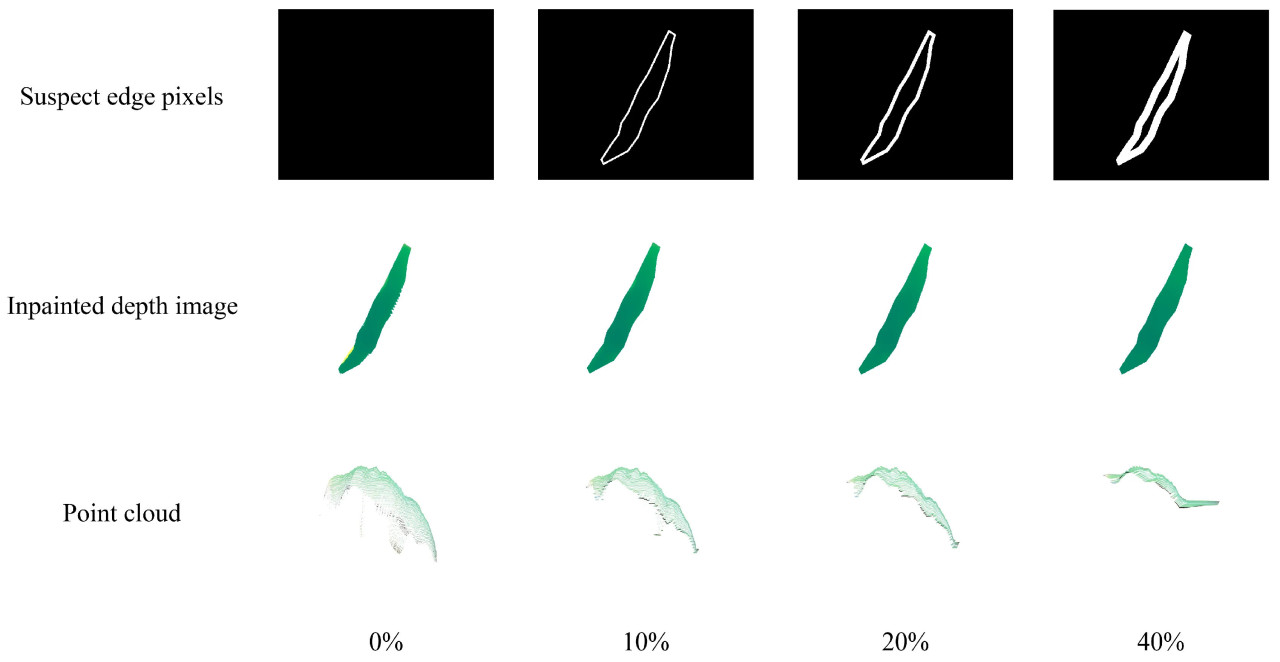

Адаптивная идентификация краевых пикселей на основе ширины скелета листа может эффективно удалять летающие пиксели из исходного depth-изображения. Это исследование проверило производительность идентификации краевых пикселей при различных адаптивных коэффициентах в удалении летающих пикселей. Как показано на Рисунке 11, слишком маленький коэффициент не смог полностью удалить летающие пиксели, в то время как слишком большой коэффициент удалял ключевые действительные известные пиксели из внутренней части листа. Этот недостаток достаточной контекстной информации приводил к большим ошибкам в завершении глубины. Поэтому адаптивный коэффициент в этом исследовании был установлен на 20% ширины скелета листа.

Рисунок 11. Визуализация восстановленного depth-изображения и облака точек при различных коэффициентах идентификации края.

Фильтрация по гистограмме была ключевым методом для идентификации аномальных пикселей. Рисунок 12 демонстрирует эффективность фильтрации по гистограмме для идентификации аномальных пикселей. Из Рисунка 12b можно наблюдать, что шумовые точки на левой стороне листа не были обнаружены вышеупомянутыми методами идентификации пикселей, как указано желтыми значениями глубины, которые не соответствовали основной листовой области. Применение завершения глубины к этим неидентифицированным аномальным пикселям могло усугубить генерацию шумовых точек, как показано на Рисунке 12d. Однако метод фильтрации по гистограмме, предложенный в этом исследовании, эффективно устранил выбросы, что привело к выводу завершения глубины с гладкими градиентами и меньшим шумом, как показано на Рисунке 12e. Рисунок 13 конкретно объясняет, что, локализуя левое и правое основания основного пика гистограммы, можно идентифицировать аномальные пиксели, которые критически влияют на качество завершения глубины.

Рисунок 12. Визуализация идентификации аномальных пикселей. (a) Исходное depth-изображение листа. (b) Depth-изображение известных пикселей без идентификации аномальных пикселей. (c) Depth-изображение известных пикселей с идентификацией аномальных пикселей. (d) Depth-изображение после завершения глубины без идентификации аномальных пикселей. (e) Depth-изображение после завершения глубины с идентификацией аномальных пикселей.

Рисунок 13. Гистограмма depth-изображения с пиками.

После идентификации всех UPs и KPs, алгоритм фильтра пикселей был применен для завершения глубины. Как показано на Рисунке 14, алгоритм давал относительно гладкие результаты завершения, поскольку он ссылался на средние значения соседних действительных пикселей, тем самым генерируя значения глубины с более высокими уровнями достоверности и сводя к минимуму шум, вносимый летающими пикселями с высоким градиентом на краях. Что касается диапазона поиска R фильтра пикселей, меньший диапазон (например, R = один) ограничивал алгоритм фокусировкой только на соседних локальных пикселях, что приводило к полосатой картине завершения. Напротив, чрезмерно большой диапазон (например, R = 10) генерировал размытые значения глубины, не соответствующие исходному градиенту глубины. В этом исследовании был выбран радиус R = пять, поскольку он достигал равномерной глубины, соответствующей градиентам глубины известных пикселей.

Рисунок 14. Производительность фильтра пикселей при использовании различных диапазонов поиска.

3.3. Производительность измерения площади листа

Рисунок 15 иллюстрирует процесс преобразования от исходных RGB-D данных к 3D сетчатой модели, пригодной для измерения площади листа. Из-за ограничения разрешения по направлению глубины depth камеры, исходное облако точек показывало ярко выраженное ступенчатое распределение. После пространственной подвыборки эта проблема была смягчена, хотя и за счет некоторой плотности облака точек. После триангуляции Delaunay появились заметные колебания по сетке, заставляя листовую модель казаться чрезмерно широкой и толстой. Однако окончательная сглаженная сетка эффективно представляла как форму, так и цветовые характеристики листа.

Рисунок 15. Визуализация 3D моделей для измерения площади листа.

Чтобы проверить эффективность предложенного метода в смягчении ограничений Azure Kinect DK, это исследование также ввело исходные RGB-D данные для измерения площади листа в качестве сравнения. Аналогично, исходные данные обрабатывались с помощью семантического маскирования, пространственной подвыборки, триангуляции Delaunay 2.5D и сглаживания Лапласа.

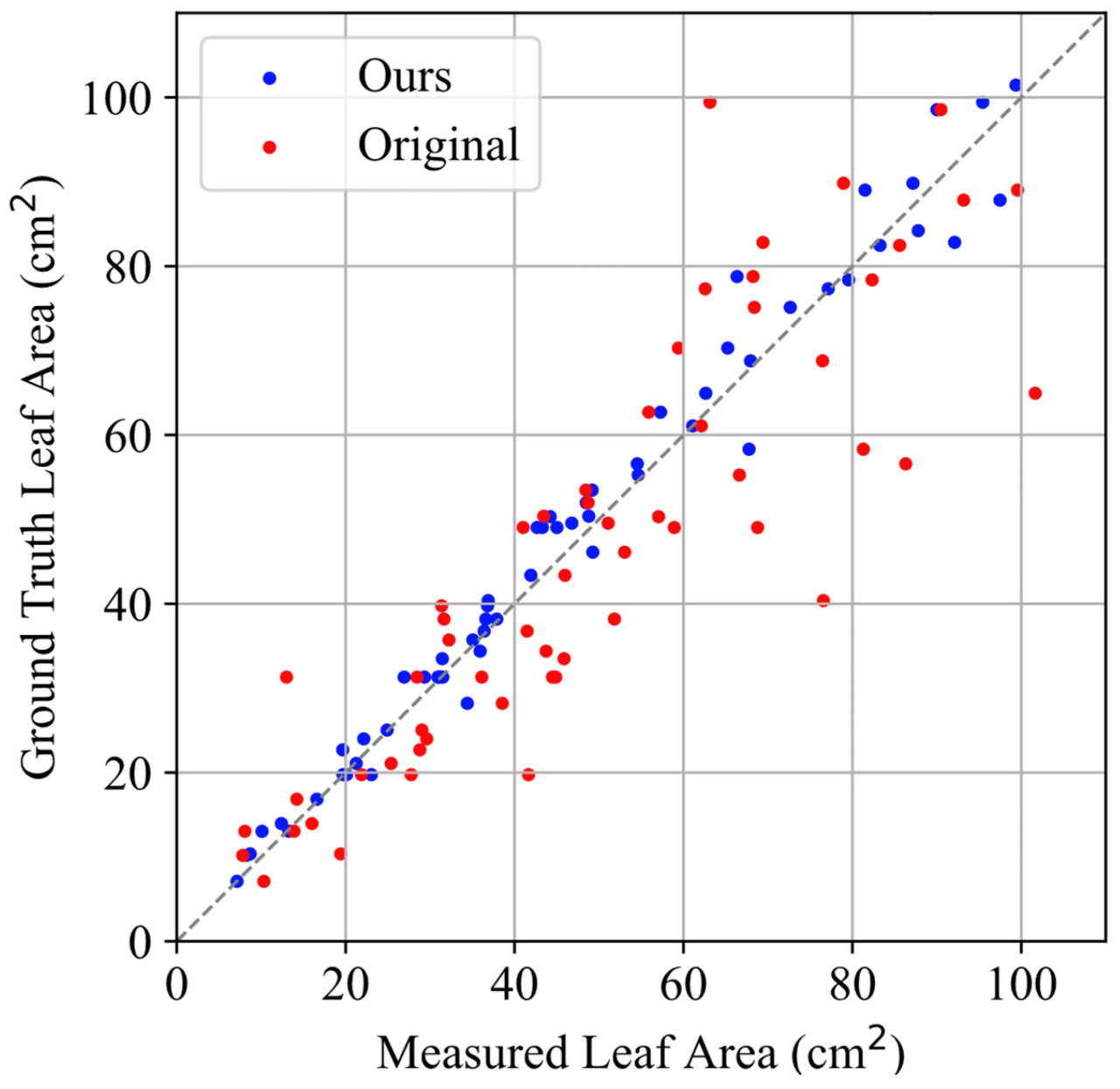

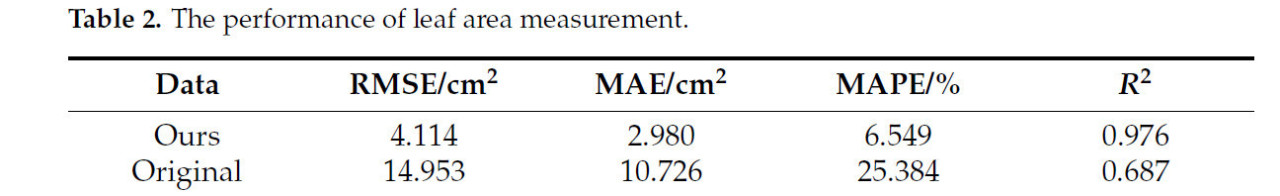

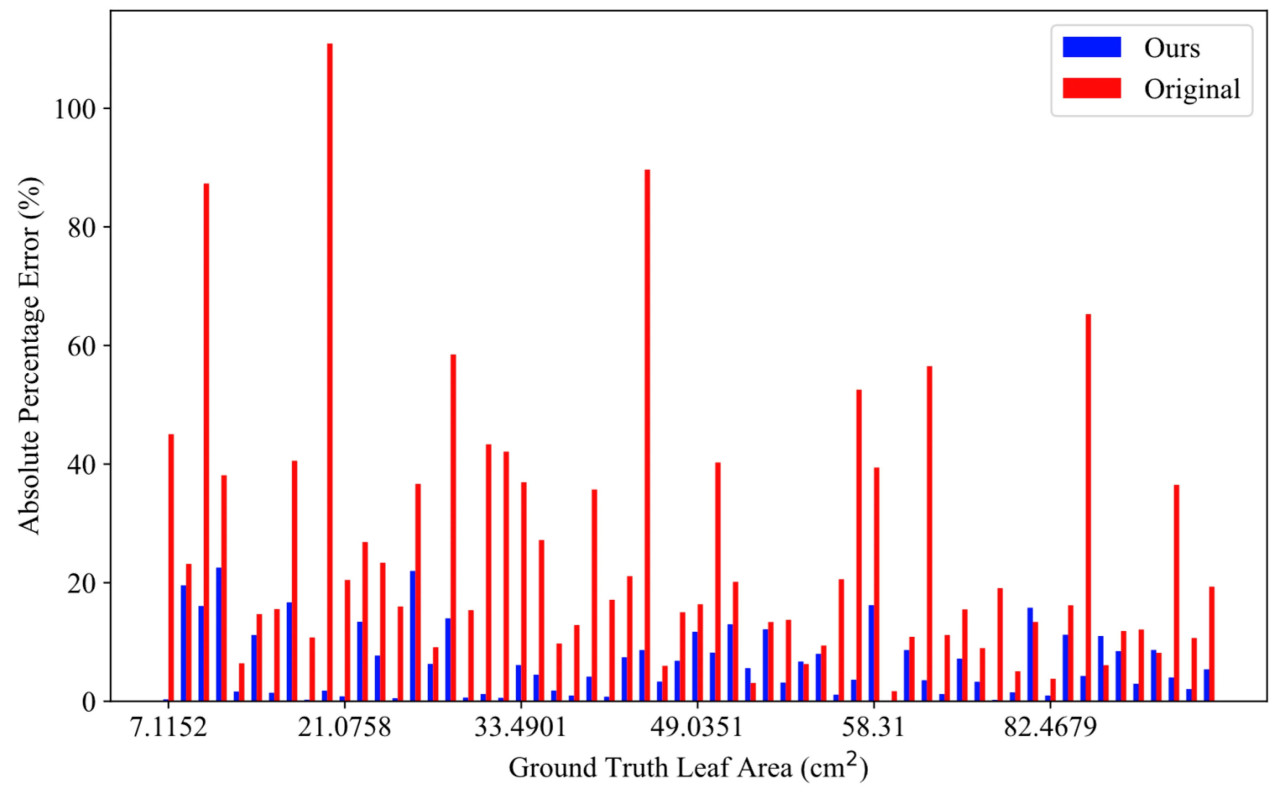

Из Таблицы 2 очевидно, что среди 60 образцов листьев исходные данные были значительно подвержены влиянию ранее упомянутых факторов, что привело к большим ошибкам измерений. Напротив, предложенный метод измерения площади листа на основе восстановления глубины достиг RMSE 4.114 см² и MAE 2.980 см², в то время как MAPE снизился с 25.384% до 6.549%. В то же время, надежность метода также была подтверждена значением R2, равным 0.976. Этот метод поддерживал уровень производительности в полевых условиях, сопоставимый с измерениями, проведенными в стабильных лабораторных условиях, как продемонстрировано в нескольких исследованиях [23]. Рисунок 16 конкретно иллюстрирует взаимосвязь между измеренной площадью листа и истинным значением для каждого образца, на основе нашего метода (красные точки) и исходных данных (зеленые точки). В пределах площади листа от 10 см² до 100 см², зеленые точки были в основном разбросаны вокруг обеих сторон линии 𝑦=𝑥, с ошибками, в основном возникающими из-за переоценки, вызванной летающими пикселями, и недооценки из-за потери площадей листа от пустых или аномальных пикселей глубины. Напротив, красные точки были тесно сгруппированы вокруг линии 𝑦=𝑥, указывая на то, что метод эффективно смягчил ошибки, представленные в исходных данных.

Рисунок 16. Точечные диаграммы измеренных и истинных значений площади листа.

Таблица 2. Производительность измерения площади листа.

В то же время, это исследование проверило производительность предложенного метода в измерении площади листа на различных стадиях роста растений кукурузы. Собранные образцы со стадий роста V1–V7 были разделены на ранние образцы (V1–V4) и поздние образцы (V5–V7). Ранние образцы включали 25 образцов листьев, в то время как поздние образцы включали 35 образцов листьев. Результаты измерений показаны в Таблице 3.

Таблица 3. Производительность измерения площади листа на различных стадиях роста.

Как видно из Таблицы 3, средняя площадь листа ранних образцов (V1–V4) составила 40.907 см², со значениями RMSE и MAE 2.274 см² и 1.812 см², соответственно, и MAPE 5.824%. На этой стадии листья были меньшего размера, что демонстрировало более простые формы с более гладкими поверхностями, что приводило к меньшему шуму в depth-изображениях и более высокой точности измерений. Однако из-за меньшей площади листа присутствие летающих пикселей оказывало более заметное влияние на относительную ошибку, заставляя MAPE приближаться к таковой для поздних образцов.

Для поздних образцов (V5–V7), средняя площадь листа увеличилась до 60.751 см², но значения RMSE и MAE также значительно увеличились до 5.891 см² и 3.742 см², соответственно, с MAPE 6.087%. На этой стадии листья демонстрировали увеличенный размер, скрученные края и более сложную текстуру поверхности. Эти морфологические особенности и большие измерительные поверхности значительно увеличили сложность измерения глубины, приводя к большим ошибкам измерений. Несмотря на это, вышеуказанный результат указывает на то, что предложенный метод демонстрирует хорошую адаптируемость и надежность для измерения площади листа на различных стадиях роста, хотя повышенная сложность морфологии листа на поздних стадиях является основным фактором, влияющим на точность измерений.

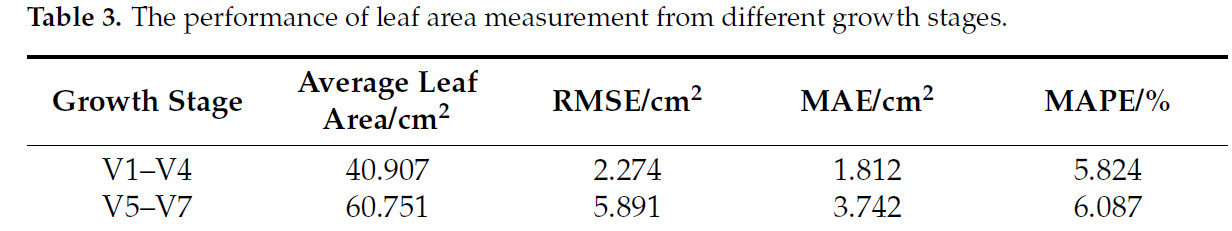

По мере роста растений кукурузы общая площадь листьев увеличивается; однако одновременно появляются новые листья. Поэтому только анализ различных стадий роста недостаточен для проверки отзывчивости метода к листьям различных размеров. Чтобы решить эту проблему, Рисунок 17 представляет абсолютные ошибки (AEs) для всех образцов листьев, отсортированных по площади листа. Результаты показывают, что значения AE для большинства образцов с использованием предложенного метода были менее пяти см², демонстрируя надежную производительность в измерении площади листа кукурузы на стадиях роста от V1 до V7. Однако по мере увеличения площади листа, большие выбросы в AE наблюдались чаще, особенно для образцов с более крупными листьями.

Рисунок 17. График абсолютной ошибки измеренной площади листа.

Как обсуждалось ранее, большие измерительные поверхности вносят больше шума из-за присущих ограничений точности RGB-D камеры, способствуя систематическим ошибкам. Дополнительно, большие края листьев более склонны к скручиванию по мере роста растений кукурузы, и RGB-D камера с трудом точно захватывает такие сложные локальные структуры, что приводит к значительным ошибкам, вызванным неполной или неточной глубинной информацией.

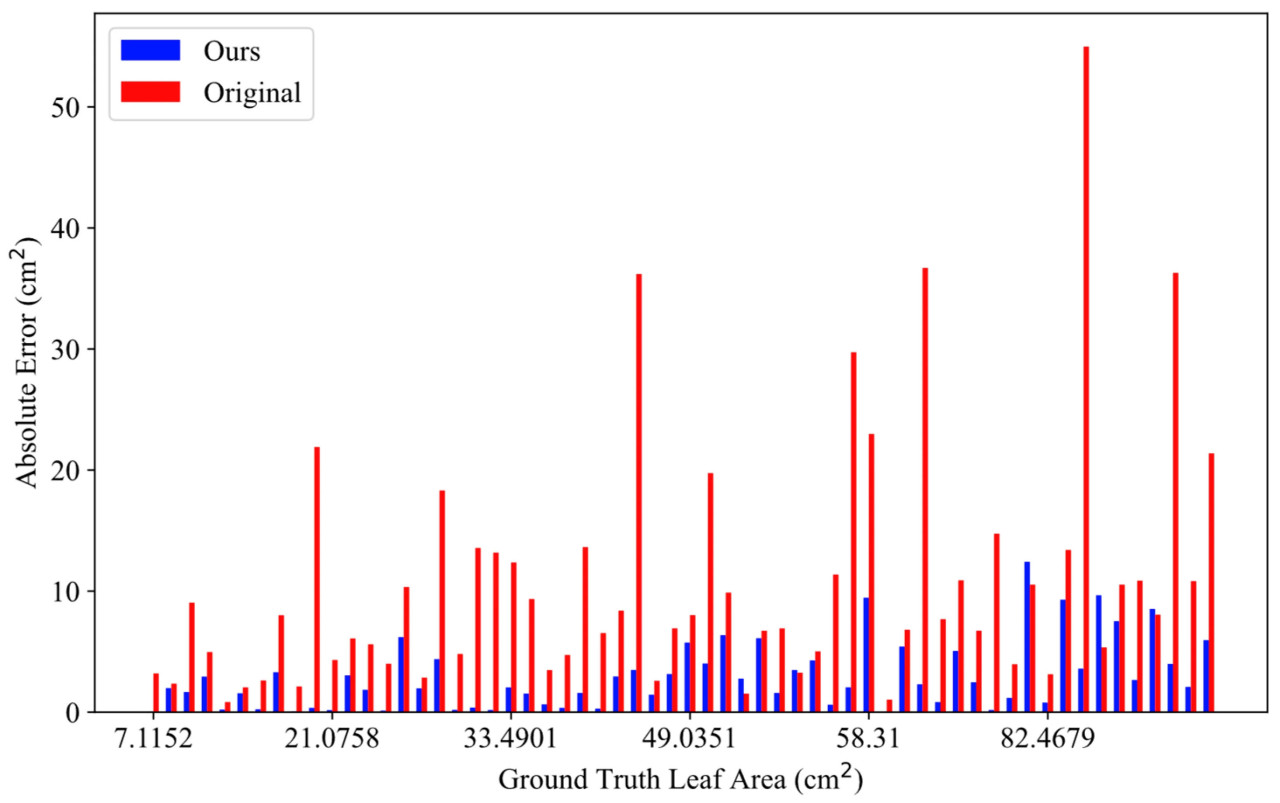

Чтобы учесть различия в размерах, была использована абсолютная процентная ошибка (APE) для нормализации AE. Как показано на Рисунке 18, более крупные листья демонстрировали относительно меньшие APEs, тогда как меньшие листья имели более высокие APEs. Это расхождение возникает в основном потому, что меньшие области труднее точно воспринимать RGB-D камере, что приводит к внесению летающих пикселей. Хотя метод восстановления глубины смягчил некоторые из этих проблем, он не мог полностью удалить летающие пиксели, не ставя под угрозу действительную глубинную информацию, тем самым увеличивая относительные ошибки для меньших листьев.

Рисунок 18. График абсолютной процентной ошибки измеренной площади листа.

В сумме, предложенный метод эффективно преодолевает ключевые ограничения Azure Kinect DK, обеспечивая надежную и адаптивную производительность для фенотипирования на уровне органов, такого как измерение площади листа кукурузы, даже при различных размерах листьев и морфологической сложности.

4. Выводы

Учитывая потребность в высокопроизводительном, на уровне органов 3D фенотипировании для сельскохозяйственных культур, особенно в отношении измерения площади листа, это исследование проанализировало общие ограничения хорошо известной потребительской RGB-D камеры, Azure Kinect DK, включая рассогласование RGB–depth и сниженную чувствительность к тонким листовым структурам, что приводит к недостаточному качеству данных для фенотипического анализа. Чтобы устранить эти ограничения, исследование предложило новый подход к оптимизации для Azure Kinect DK, состоящий из следующих компонентов: (1) был разработан унифицированный протокол повторной калибровки для повышения качества совмещения RGB-D, обеспечивая более точное наложение между RGB и depth данными; (2) был предложен метод восстановления глубины, управляемый семантической информацией, основанный на структуре извлечения семантической информации YOLOv11-SAM2, методе идентификации пустых и летающих пикселей и алгоритме восстановления глубины на основе фильтра пикселей; и (3) было разработано применение измерения площади листа кукурузы в поле с использованием Azure Kinect DK и подхода оптимизации. Метод в итоге достиг точности, близкой к лабораторному уровню, с MAPE 6.549%, RMSE 4.114 см², MAE 2.980 см² и R2 0.976 на 60 образцах листьев кукурузы. Применение может быть расширено на целые растения и имеет потенциал для измерения других типов сельскохозяйственных культур.

Этот метод эффективно использует синергию между depth данными и высокоразрешающими RGB данными, предоставляемыми Azure Kinect, применяя маски на уровне пикселей для руководства восстановлением карты глубины. Сосредоточив операции на уровне изображения, а не занимаясь вычислительно интенсивным семантическим анализом и шумоподавлением на 3D облаках точек, подход повышает как эффективность, так и точность, представляя жизнеспособное решение для высокопроизводительного фенотипического анализа с использованием Azure Kinect DK. Хотя предложенный метод оптимизации продемонстрировал надежную производительность в фенотипировании листьев кукурузы, его применимость к другим культурам или более сложным сценариям, таким как плотные пологи и перекрывающиеся листья, заслуживает дальнейшего исследования. Будущая работа могла бы исследовать адаптации для решения таких проблем, включая слияние данных с нескольких ракурсов или нескольких устройств для комплексного пространственного анализа и интеграцию методов глубокого обучения для улучшения точности и надежности. Однако критически важно, чтобы будущие разработки учитывали операционные ограничения в полевых условиях и поддерживали вычислительную эффективность, чтобы гарантировать практическую применимость в различных сельскохозяйственных контекстах.

Ссылки

1. Wang, X.; Hua, J.; Kang, M.; Wang, H.; Reffye, P. Functional–Structural Plant Model “GreenLab”: A State-of-the-Art Review. Plant Phenomics 2024, 6, 0118. [Google Scholar] [CrossRef] [PubMed]

2. Zhou, L.; Zhang, H.; Bian, L.; Tian, Y.; Zhou, H. Phenotyping of Drought-Stressed Poplar Saplings Using Exemplar-Based Data Generation and Leaf-Level Structural Analysis. Plant Phenomics 2024, 6, 0205. [Google Scholar] [CrossRef]

3. Fang, H.; Baret, F.; Plummer, S.; Schaepman-Strub, G. An Overview of Global Leaf Area Index (LAI): Methods, Products, Validation, and Applications. Rev. Geophys. 2019, 57, 739–799. [Google Scholar] [CrossRef]

4. Haghshenas, A.; Emam, Y. Accelerating leaf area measurement using a volumetric approach. Plant Methods 2022, 18, 61. [Google Scholar] [CrossRef] [PubMed]

5. Ji, X.; Zhou, Z.; Gouda, M.; Zhang, W.; He, Y.; Ye, G.; Li, X. A novel labor-free method for isolating crop leaf pixels from RGB imagery: Generating labels via a topological strategy. Comput. Electron. Agric. 2024, 218, 108631. [Google Scholar] [CrossRef]

6. Yang, T.; Zhou, S.; Xu, A.; Ye, J.; Yin, J. An Approach for Plant Leaf Image Segmentation Based on YOLOV8 and the Improved DEEPLABV3+. Plants 2023, 12, 3438. [Google Scholar] [CrossRef]

7. Su, Z.; Zhou, G.; Song, L.; Lu, X.; Zhao, R.; Zhou, X. Three-Dimensional Reconstruction of Leaves Based on Laser Point Cloud Data. In Proceedings of the 2021 IEEE International Geoscience and Remote Sensing Symposium IGARSS, Brussels, Belgium, 11–16 July 2021; pp. 6688–6691. [Google Scholar]

8. Wen, W.; Wu, S.; Lu, X.; Liu, X.; Gu, S.; Guo, X. Accurate and semantic 3D reconstruction of maize leaves. Comput. Electron. Agric. 2024, 217, 108566. [Google Scholar] [CrossRef]

9. Ando, R.; Ozasa, Y.; Guo, W. Robust Surface Reconstruction of Plant Leaves from 3D Point Clouds. Plant Phenomics 2021, 2021, 3184185. [Google Scholar] [CrossRef]

10. Li, Y.; Wen, W.; Miao, T.; Wu, S.; Yu, Z.; Wang, X.; Guo, X.; Zhao, C. Automatic organ-level point cloud segmentation of maize shoots by integrating high-throughput data acquisition and deep learning. Comput. Electron. Agric. 2022, 193, 106702. [Google Scholar] [CrossRef]

11. Huang, T.; Bian, Y.; Niu, Z.; Taha, M.F.; He, Y.; Qiu, Z. Fast neural distance field-based three-dimensional reconstruction method for geometrical parameter extraction of walnut shell from multiview images. Comput. Electron. Agric. 2024, 224, 109189. [Google Scholar] [CrossRef]

12. Zhou, L.; Jin, S.; Wang, J.; Zhang, H.; Shi, M.; Zhou, H. 3D positioning of Camellia oleifera fruit-grabbing points for robotic harvesting. Biosyst. Eng. 2024, 246, 110–121. [Google Scholar] [CrossRef]

13. Andújar, D.; Ribeiro, A.; Fernández-Quintanilla, C.; Dorado, J. Using depth cameras to extract structural parameters to assess the growth state and yield of cauliflower crops. Comput. Electron. Agric. 2016, 122, 67–73. [Google Scholar] [CrossRef]

14. Sun, G.; Wang, X. Three-Dimensional Point Cloud Reconstruction and Morphology Measurement Method for Greenhouse Plants Based on the Kinect Sensor Self-Calibration. Agronomy 2019, 9, 596. [Google Scholar] [CrossRef]

15. Hu, Y.; Wang, L.; Xiang, L.; Wu, Q.; Jiang, H. Automatic Non-Destructive Growth Measurement of Leafy Vegetables Based on Kinect. Sensors 2018, 18, 806. [Google Scholar] [CrossRef]

16. Wu, G.; Zhu, Q.; Huang, M.; Guo, Y.; Qin, J. Automatic recognition of juicy peaches on trees based on 3D contour features and colour data. Biosyst. Eng. 2019, 188, 1–13. [Google Scholar] [CrossRef]

17. Yang, T.; Ye, J.; Zhou, S.; Xu, A.; Yin, J. 3D reconstruction method for tree seedlings based on point cloud self-registration. Comput. Electron. Agric. 2022, 200, 107210. [Google Scholar] [CrossRef]

18. Zhu, T.; Ma, X.; Guan, H.; Wu, X.; Wang, F.; Yang, C.; Jiang, Q. A calculation method of phenotypic traits based on three-dimensional reconstruction of tomato canopy. Comput. Electron. Agric. 2023, 204, 107515. [Google Scholar] [CrossRef]

19. Ma, X.; Wei, B.; Guan, H.; Cheng, Y.; Zhuo, Z. A method for calculating and simulating phenotype of soybean based on 3D reconstruction. Eur. J. Agron. 2024, 154, 127070. [Google Scholar] [CrossRef]

20. Servi, M.; Profili, A.; Furferi, R.; Volpe, Y. Comparative Evaluation of Intel RealSense D415, D435i, D455, and Microsoft Azure Kinect DK Sensors for 3D Vision Applications. IEEE Access 2024, 12, 111311–111321. [Google Scholar] [CrossRef]

21. Xie, P.; Ma, Z.; Du, R.; Yang, X.; Jiang, Y.; Cen, H. An unmanned ground vehicle phenotyping-based method to generate three-dimensional multispectral point clouds for deciphering spatial heterogeneity in plant traits. Mol. Plant 2024, 17, 1624–1638. [Google Scholar] [CrossRef] [PubMed]

22. Miranda, J.C.; Arnó, J.; Gené-Mola, J.; Lordan, J.; Asín, L.; Gregorio, E. Assessing automatic data processing algorithms for RGB-D cameras to predict fruit size and weight in apples. Comput. Electron. Agric. 2023, 214, 108302. [Google Scholar] [CrossRef]

23. Otoya, P.E.L.; Gardini, S.R.P. Real-Time Non-Invasive Leaf Area Measurement Method using Depth Images. In Proceedings of the 2020 IEEE ANDESCON, Quito, Ecuador, 13–16 October 2020; pp. 1–6. [Google Scholar]

24. Qiu, R.; Zhang, M.; He, Y. Field estimation of maize plant height at jointing stage using an RGB-D camera. Crop J. 2022, 10, 1274–1283. [Google Scholar] [CrossRef]

25. Song, P.; Li, Z.; Yang, M.; Shao, Y.; Pu, Z.; Yang, W.; Zhai, R. Dynamic detection of three-dimensional crop phenotypes based on a consumer-grade RGB-D camera. Front. Plant Sci. 2023, 14, 1097725. [Google Scholar] [CrossRef] [PubMed]

26. Boukhana, M.; Ravaglia, J.; Hétroy-Wheeler, F.; De Solan, B. Geometric models for plant leaf area estimation from 3D point clouds: A comparative study. Graph. Vis. Comput. 2022, 7, 200057. [Google Scholar] [CrossRef]

27. Chen, Q.; Huang, S.; Liu, S.; Zhong, M.; Zhang, G.; Song, L.; Zhang, X.; Zhang, J.; Wu, K.; Ye, Z.; et al. Multi-view 3D reconstruction of seedling using 2D image contour. Biosyst. Eng. 2024, 243, 130–147. [Google Scholar] [CrossRef]

28. Ma, Z.; Sun, D.; Xu, H.; Zhu, Y.; He, Y.; Cen, H. Optimization of 3D Point Clouds of Oilseed Rape Plants Based on Time-of-Flight Cameras. Sensors 2021, 21, 664. [Google Scholar] [CrossRef] [PubMed]

29. Li, Y.; Si, S.; Liu, X.; Zou, L.; Wu, W.; Liu, X.; Zhang, L. Three-dimensional reconstruction of cotton plant with internal canopy occluded structure recovery. Comput. Electron. Agric. 2023, 215, 108370. [Google Scholar] [CrossRef]

30. Chen, H.; Liu, S.; Wang, C.; Wang, C.; Gong, K.; Li, Y.; Lan, Y. Point Cloud Completion of Plant Leaves under Occlusion Conditions Based on Deep Learning. Plant Phenomics 2023, 5, 0117. [Google Scholar] [CrossRef]

31. Yang, R.S.; Chan, Y.H.; Gong, R.; Nguyen, M.; Strozzi, A.G.; Delmas, P.; Gimel’farb, G.; Ababou, R. Multi-Kinect scene reconstruction: Calibration and depth inconsistencies. In Proceedings of the 2013 28th International Conference on Image and Vision Computing New Zealand (IVCNZ 2013), Wellington, New Zealand, 27–29 November 2013; pp. 47–52. [Google Scholar]

32. Wang, Z.; Song, X.; Wang, S.; Xiao, J.; Zhong, R.; Hu, R. Filling Kinect depth holes via position-guided matrix completion. Neurocomputing 2016, 215, 48–52. [Google Scholar] [CrossRef]

33. Paredes, A.L.; Song, Q.; Conde, M.H. Performance Evaluation of State-of-the-Art High-Resolution Time-of-Flight Cameras. IEEE Sens. J. 2023, 23, 13711–13727. [Google Scholar] [CrossRef]

34. Tölgyessy, M.; Dekan, M.; Chovanec, Ľ.; Hubinský, P. Evaluation of the Azure Kinect and Its Comparison to Kinect V1 and Kinect V2. Sensors 2021, 21, 413. [Google Scholar] [CrossRef] [PubMed]

35. Lachat, E.; Macher, H.; Landes, T.; Grussenmeyer, P. Assessment and Calibration of a RGB-D Camera (Kinect v2 Sensor) Towards a Potential Use for Close-Range 3D Modeling. Remote Sens. 2015, 7, 13070–13097. [Google Scholar] [CrossRef]

36. Wei, F.; Xu, G.; Wu, Q.; Kuang, J.; Tian, P.; Qin, P.; Li, Z. Azure Kinect Calibration and Parameter Recommendation in Different Scenarios. IEEE Sens. J. 2022, 22, 9733–9742. [Google Scholar] [CrossRef]

37. Singh, D.; Jain, N.; Jain, P.; Kayal, P.; Kumawat, S.; Batra, N. PlantDoc: A Dataset for Visual Plant Disease Detection. In Proceedings of the CoDS COMAD 2020, Hyderabad, India, 5–7 January 2020; pp. 249–253. [Google Scholar]

38. Ravi, N.; Gabeur, V.; Hu, Y.-T.; Hu, R.; Ryali, C.; Ma, T.; Khedr, H.; Rädle, R.; Rolland, C.; Gustafson, L.; et al. SAM 2: Segment Anything in Images and Videos. arXiv 2024, arXiv:2408.00714. [Google Scholar]

39. Ku, J.; Harakeh, A.; Waslander, S.L. In Defense of Classical Image Processing: Fast Depth Completion on the CPU. In Proceedings of the 2018 15th Conference on Computer and Robot Vision (CRV), Toronto, ON, Canada, 8–10 May 2018; pp. 16–22. [Google Scholar]

Niu Z, Huang T, Xu C, Sun X, Taha MF, He Y, Qiu Z. A Novel Approach to Optimize Key Limitations of Azure Kinect DK for Efficient and Precise Leaf Area Measurement. Agriculture. 2025; 15(2):173. https://doi.org/10.3390/agriculture15020173

Перевод статьи «A Novel Approach to Optimize Key Limitations of Azure Kinect DK for Efficient and Precise Leaf Area Measurement» авторов Niu Z, Huang T, Xu C, Sun X, Taha MF, He Y, Qiu Z., оригинал доступен по ссылке. Лицензия: CC BY. Изменения: переведено на русский язык

Комментарии (0)